一种用于双时相遥感影像语义变化检测的多任务CNN-Transformer网络

发布日期 2024.10.28 期刊IEEE TGRS

核心团队: 华东交通大学

0 摘要

翻译

双时相遥感语义变化检测(SCD)旨在识别并分类同一地理区域在不同时间拍摄的两幅遥感(RS)影像中的变化。高性能的语义变化检测方法通常采用多任务网络同时处理二值变化检测(BCD)和语义分割(SS)。尽管语义变化检测研究已取得显著进展,但构建能充分挖掘二值变化检测与语义分割相关性的多任务网络仍面临挑战。为此,本文提出一种名为多任务 CNN-Transformer 网络(MCTNet)的新方法,专为双时相遥感影像语义变化检测设计。该孪生网络通过三个子网络同时处理语义分割和二值变化检测任务:两个用于语义分割,一个用于二值变化检测。其流程为:首先利用多尺度卷积神经网络(CNN)从输入影像中提取局部特征并将其转换为特征令牌;随后,采用编码 – 解码结构的 Transformer 模块捕捉这些视觉令牌间的长距离依赖关系;最后,提取的特征传入多任务头以生成预测结果。为确保二值变化检测结果不受输入影像对顺序的影响,本文引入时空特征学习机制,使模型能够获取二值变化检测所需的时间对称表示。在 WHU-CD、SECOND 和 HRSCD 数据集上的大量实验验证表明,MCTNet 在语义分割和二值变化检测任务中均具备高效性和有效性。本文的源代码将后续发布于 GitHub¹。

1、多任务分别指:双时相遥感语义变化检测SCD和语义分割(SS)

1 引言

翻译

双时相遥感语义变化检测(SCD)旨在识别变化发生的位置并分类变化类型。与仅判断目标区域是否存在变化的二值变化检测(BCD)不同,语义变化检测通过提供变化前后详细的土地覆盖图(LCMs),提供更全面的语义信息。语义变化检测广泛应用于自然灾害评估、环境监测、农业调查和资源管理等多个领域。不同时间拍摄的高质量卫星影像极大地推动了变化检测技术的发展,但同时也对更智能的变化分析方法提出了更高需求。

深度学习彻底革新了遥感影像变化检测(CD)技术。尽管现有研究主要集中于二值变化检测,但遥感影像语义变化检测的研究相对不足。从计算机视觉角度来看,二值变化检测属于二值语义分割任务,用于识别影像中的变化区域;而语义变化检测更为复杂,需要生成二值变化图和两幅时序土地覆盖图。由于输出结果和底层假设存在根本差异,基于深度学习的现有二值变化检测模型并不适用于语义变化检测:二值变化检测模型仅有一个输出分支,而语义变化检测模型需要三个输出分支;此外,二值变化检测模型假设二值变化图不受输入影像对顺序的影响,而语义变化检测中的两幅土地覆盖图与输入双时相影像存在严格的一一对应关系。

为解决语义变化检测的挑战,研究人员提出了两类模型:单任务算法 [1,2] 和多任务算法 [3,4]。单任务语义变化检测算法通常将变化检测任务分解为两个独立阶段:影像语义分割和二值变化检测。然而,这种方法严重依赖初始语义分割的准确性,因为误差会传递到二值变化检测阶段;此外,语义分割模型的训练未能充分考虑不同时期影像间的时间上下文关系。相比之下,多任务语义变化检测算法通过单个网络联合建模语义分割和二值变化检测。

多任务学习(MTL)具有显著优势,但应用于语义变化检测时仍面临挑战:如何整合不同任务的特征而不产生干扰或冗余,是一项复杂的工作。与语义分割不同,高性能的二值变化检测必须不受输入影像顺序的影响。多任务头在多任务学习模型中起着关键作用,它指导每个任务的学习过程,利用所有任务的共享信息提高效率和性能,但任务间对共享信息的竞争可能导致性能下降。此外,在语义变化检测的多任务学习中,平衡同质性特征和异质性特征也具有挑战性:同质性特征关注不同时间影像间的相似性,而异质性特征捕捉它们的独特特征。两者的平衡至关重要 —— 过度强调同质性可能会遗漏细微变化,而过度关注异质性则会增加对噪声的敏感性。因此,需精心设计多任务学习框架以缓解这些挑战,确保两个任务均达到最佳性能。

本文提出一种多任务 CNN-Transformer 网络(MCTNet),该网络充分挖掘二值变化检测与语义分割的相关性,使两个任务相互促进,实现高性能语义变化检测。本研究基于我们之前提出的二值变化检测模型 AMTNet [5],尽管两者均以 CNN-Transformer 结构为基础,但在网络架构上存在显著差异:MCTNet 未采用特征交换技术和通道注意力机制;其次,MCTNet 设计了类 UNet [6] 的多任务头;最后,MCTNet 整合了时空特征学习(SFL)模块,以捕捉二值变化检测的对称时间特征。

本文的主要贡献如下:

- 设计了一种多任务 CNN-Transformer 网络,专门用于高效挖掘和利用语义分割与二值变化检测的相关性,旨在同时提升两个任务的整体性能。

- 为语义分割和二值变化检测设计了类 UNet [6] 的多任务头。这些任务头有效利用从 Transformer 块提取的多尺度特征,使模型能够适应并专门处理每个特定任务。

- 为学习时间对称特征,整合了时空特征学习模块以增强二值变化检测的特征表示。时空特征学习模块使二值变化检测不受输入影像对顺序的影响,从而无论输入数据的时间顺序如何,模型都能有效捕捉变化。

本文其余部分结构如下:第二部分概述相关工作,第三部分详细阐述所提方法,第四部分呈现并讨论实验结果,最后第五部分总结全文并指出未来研究方向。

2 相关工作

2.1 基于深度学习的二值变化检测

翻译

上下文信息对于遥感影像变化检测至关重要。研究人员设计了一系列方法来建模上下文并将其融入卷积神经网络架构。单分支网络通常采用差分、拼接或加法等简单融合技术在影像层面聚合特征,但这些方法无法捕捉所有相关上下文信息,尤其是对于不规则或多尺度变化。孪生网络结构通过单尺度或多尺度融合方式融合两幅影像的特征:单尺度融合 [7] 结合两个时间分支的高层特征图;而多尺度融合 [8-10] 通过模型层级逐步整合不同抽象级别的信息,从底层特征构建到高层特征表示。多尺度融合更适合检测遥感影像中不规则和多尺度的变化目标,但计算成本更高,若融合不当可能导致特征混淆。因此,采用合适的融合方法并建模上下文关系对于提高变化检测准确性至关重要。

Transformer 模型在计算机视觉领域表现出极高的有效性,在众多基准测试中取得了最先进(SOTA)结果。其优势在于建模长距离依赖关系,这是许多计算机视觉任务的关键能力。在遥感领域,Transformer 架构在影像时间序列分类 [11,12]、场景分类 [13,14]、高光谱影像分类 [15,16] 和变化检测 [8,17] 等任务中受到越来越多的关注。Transformer 处理影像块或令牌,通过组件间的交互有效识别重要区域。

在变化检测方面,BIT [18] 将 Transformer 模块与特征差分网络相结合,以捕捉上下文关系;PSTNet [19] 通过迭代采样和优化特征,逐步识别变化区域;Liu 等人 [17] 在 MSCANet 中利用 CNN 骨干网络提取层次化特征图,然后通过 Transformer 聚合语义信息;Wang 等人 [8] 在 MTCNet 中采用多尺度 Transformer 获取多分辨率表示;Changer [20] 从两幅输入影像中提取多级特征图,然后通过架构的两个分支间的特征交换整合两幅时序影像的表示,改进变化建模;AMTNet [5] 利用 CNN 和 Transformer 提取特征,通过多尺度处理捕捉不同层级的信息,并结合注意力机制聚焦相关区域。

尽管 Transformer 结构在遥感变化检测任务中表现出色,但其实在变化检测中的应用仍处于早期阶段,仍有改进空间。

2.2 基于机器学习的语义变化检测

翻译

语义变化检测技术已从依赖手工特征提取发展到利用深度学习进行表示学习。早期语义变化检测方法依赖纹理和颜色等手工特征,这些方法在复杂场景中准确检测变化的能力有限。早期直观算法 [21] 通过两幅不同时间的影像获取土地覆盖转移统计信息;一些直接分类方法 [22,23] 将每种变化类型视为独立类别,并对多时序影像进行堆叠分类。尽管实现简单,但这些技术依赖包含所有可能土地覆盖变化的多时序标记数据,这限制了它们的适用性。为解决这一限制,Bruzzone 等人设计了一种复合分类方法 [1,2],通过迭代半监督估计转移概率来建模两幅遥感影像间的时间关系,该方法无需为每种可能的变化类型准备专门的训练数据。

过去十年,深度学习的快速发展催生了更强大的语义变化检测方法。通常,基于深度学习的语义变化检测网络包括三个子网络:两个用于单幅影像的语义分割,一个用于两者间的二值变化检测。例如,Daudt 等人 [24] 发布了一个语义变化检测数据集,并基于全 CNN 提出了四种基本语义变化检测策略,采用相同的编码 – 解码架构;Liu 等人 [25] 在 DTCDSCN 架构中使用双注意力模块,通过通道和空间注意力提高特征区分能力;Peng 等人 [26] 设计了孪生 UNet 架构,捕捉多尺度信息并通过通道和空间注意力改进特征;Zheng 等人 [27] 设计了深度孪生分类后融合网络(PCFN);Niu 等人 [4] 设计了对称多任务网络(SMNet),利用预激活残差块和转换块构建骨干网络,并通过多内容融合模块减去提取的对应层次特征,突出变化相关特征;Tian 等人 [28] 提出了时间无关变化区域提议网络(TCRPN),通过探索单时序影像中变化区域的显著性,突出时空特征中的变化区域,提高对变化的响应。尽管取得了这些进展,但纯 CNN 网络捕捉全局上下文信息的能力仍有改进空间。

为建模遥感影像中远距离区域的长距离依赖关系,研究人员提出了多种基于 Transformer 的语义变化检测算法 [29-33]。Shen 等人 [29] 在解码器中引入全局通道注意力模块和多尺度特征融合,以改进特征表示;Ding 等人 [3] 提出孪生模型 Bi-SRNet,通过深度变化检测单元整合语义时间特征,增强网络推断双时相语义关系的能力,并提出语义一致性损失函数以提高变化检测结果的语义一致性;Zheng 等人 [31] 提出 ChangeMask,一种编码 – Transformer – 解码模型,利用 Transformer 捕捉全局和时间上下文,通过时间对称 Transformer 设计解决 CNN 的局限性;Cui 等人 [32] 提出 MTSCD,共享编码器层用于特征提取,并为两个任务设计特定任务解码器分支;Li 等人 [33] 提出一种聚焦解码器设计的多任务网络架构,强调解码器特征的重要性;Ding 等人 [34] 采用时空联合建模框架捕捉时间变化,整合空间和时间线索以精确检测土地覆盖变化。尽管基于 Transformer 的语义变化检测算法已取得显著进展,但仍需进一步深入研究,尤其是在多尺度特征提取和多任务学习领域。

3 所提方法

翻译

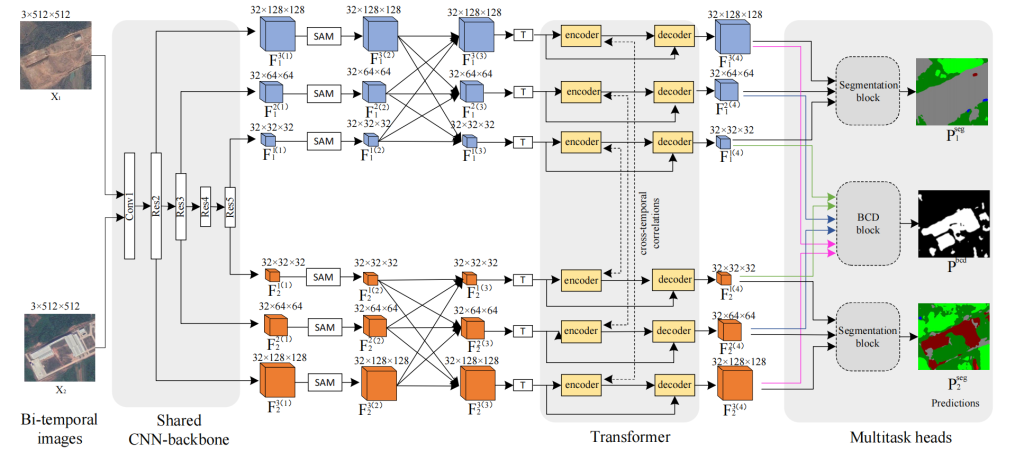

本文提出一种用于联合语义分割和二值变化检测的孪生 CNN-Transformer 网络,如图 1 所示。该网络包括三个子网络:两个专门用于语义分割,一个用于二值变化检测。该方法首先利用多尺度 CNN 骨干网络从输入影像对中提取局部特征,捕捉不同空间分辨率的视觉信息;然后将这些多尺度特征转换为特征令牌序列,输入 Transformer 模块;Transformer 采用编码 – 解码结构,建模视觉令牌间的长距离依赖关系;随后特征通过多任务头生成两个任务的预测结果。对于二值变化检测任务,本文通过整合时空特征学习模块增强特征表示,该模块捕捉时间对称特征,提高变化检测准确性。

图1.具有共享CNN主干的Siamese多任务CNN-Transformer网络(MCTNet)概述。MCTNet有效地集成了Transformers、多尺度特征融合和多任务学习。它由多尺度CNN编码器、Transformer块和多任务头组成。SAM和T分别表示空间注意力模块和标记化缩写。

3.1 多尺度CNN特征提取

翻译

多尺度特征提取对于捕捉不同空间分辨率的信息至关重要,使模型能够提取细粒度细节和更广泛的上下文信息。这种能力使模型能够识别土地覆盖和土地利用模式中的细微变化,这些变化在单一空间尺度下可能难以察觉。通过跨多尺度分析特征,模型增强了区分能力,有助于区分不同土地覆盖类别,并实现更准确的语义变化检测。

如图 1 所示,MCTNet 利用 ResNet [35] 作为骨干 CNN,从输入影像中提取多尺度特征图。ResNet 骨干网络包括一个 7×7 卷积层和四个残差块,其中 Res3 和 Res4 执行 2 倍下采样。值得注意的是,双时相孪生网络的两个 CNN 骨干网络共享权重。本文通过空间注意力模块(SAM)[5] 将空间位置信息嵌入这些特征图,该模块能够选择性地聚焦输入影像中的信息区域,同时抑制无关或噪声区域。随后,通过采样和加法运算融合多尺度特征。

具体来说,设 W 和 H 分别表示输入影像的宽度和高度。给定大小为 3×H×W 的影像对(X₁,X₂),基于 CNN 的骨干网络从每幅影像中提取三个不同尺度的特征图;然后这些多尺度特征图通过空间注意力模块;最后,对于每个时间分支,特征图 Fᵢʲ⁽²⁾(∀i∈{1,2},∀j∈{1,2,3})与同一时间分支的其他两个特征融合,融合通过采样和逐元素加法运算实现。该特征融合过程的输出为每个输入特征图 Fᵢʲ⁽²⁾对应的特征 Fᵢʲ⁽³⁾。

3.2 Transformer令牌化

翻译

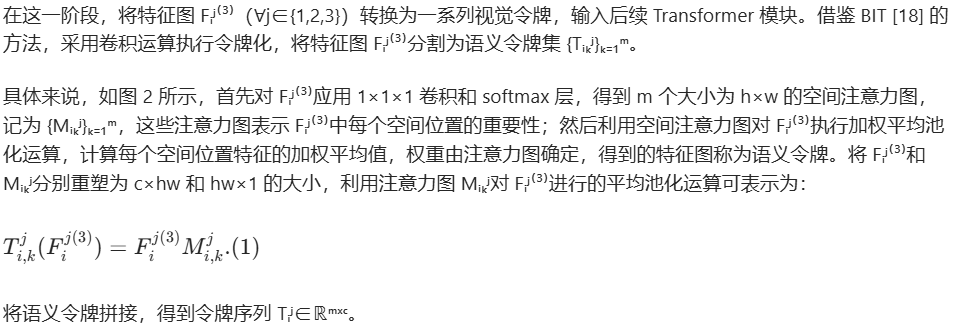

在这一阶段,将特征图 Fᵢʲ⁽³⁾(∀j∈{1,2,3})转换为一系列视觉令牌,输入后续 Transformer 模块。借鉴 BIT [18] 的方法,采用卷积运算执行令牌化,将特征图 Fᵢʲ⁽³⁾分割为语义令牌集 {Tᵢₖʲ}ₖ₌₁ᵐ。

具体来说,如图 2 所示,首先对 Fᵢʲ⁽³⁾应用 1×1×1 卷积和 softmax 层,得到 m 个大小为 h×w 的空间注意力图,记为 {Mᵢₖʲ}ₖ₌₁ᵐ,这些注意力图表示 Fᵢʲ⁽³⁾中每个空间位置的重要性;然后利用空间注意力图对 Fᵢʲ⁽³⁾执行加权平均池化运算,计算每个空间位置特征的加权平均值,权重由注意力图确定,得到的特征图称为语义令牌。将 Fᵢʲ⁽³⁾和 Mᵢₖʲ分别重塑为 c×hw 和 hw×1 的大小,利用注意力图 Mᵢₖʲ对 Fᵢʲ⁽³⁾进行的平均池化运算可表示为:\(T_{i,k}^{j}(F_{i}^{j(3)})=F_{i}^{j(3)}M_{i,k}^{j}. (1)\)

将语义令牌拼接,得到令牌序列 Tᵢʲ∈ℝᵐˣᶜ。

图2.令牌化过程和加权平均池化说明

3.3 Transformer编码器

翻译

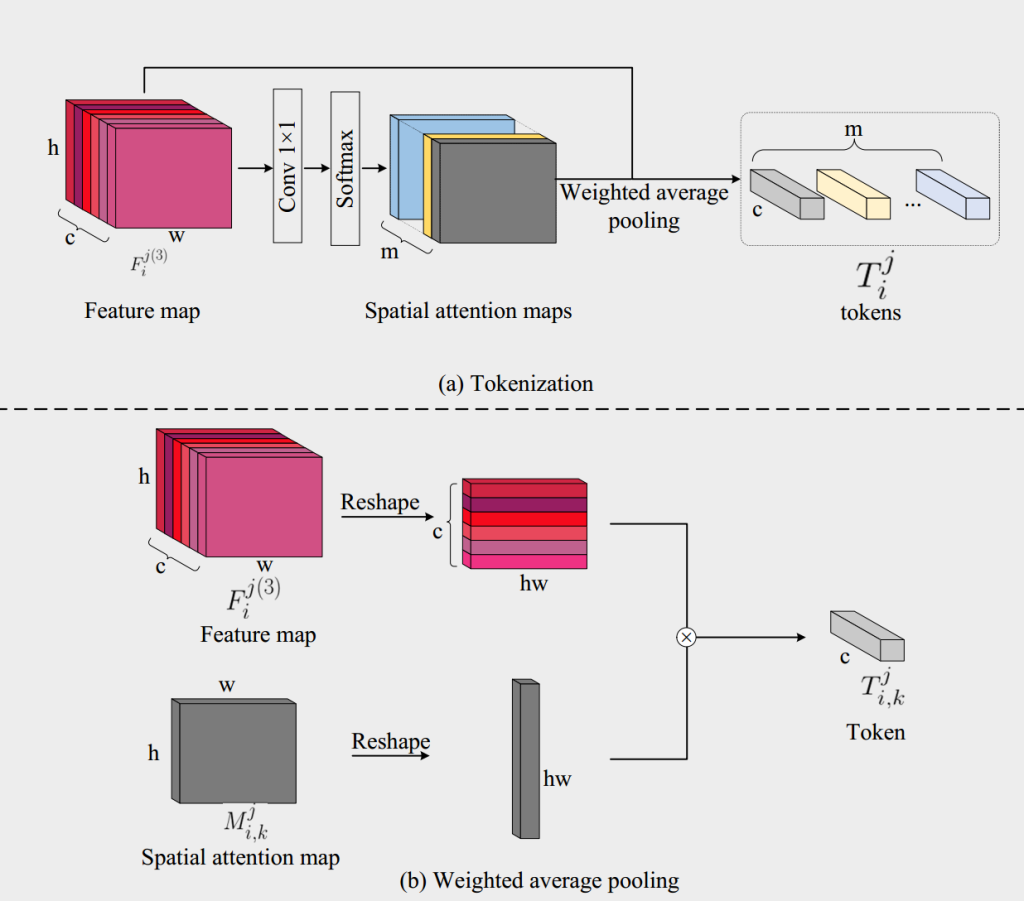

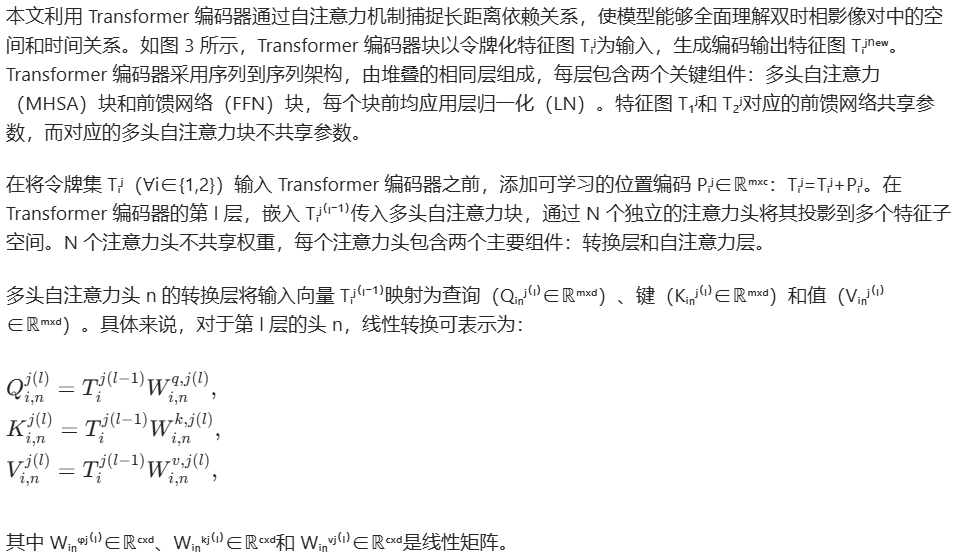

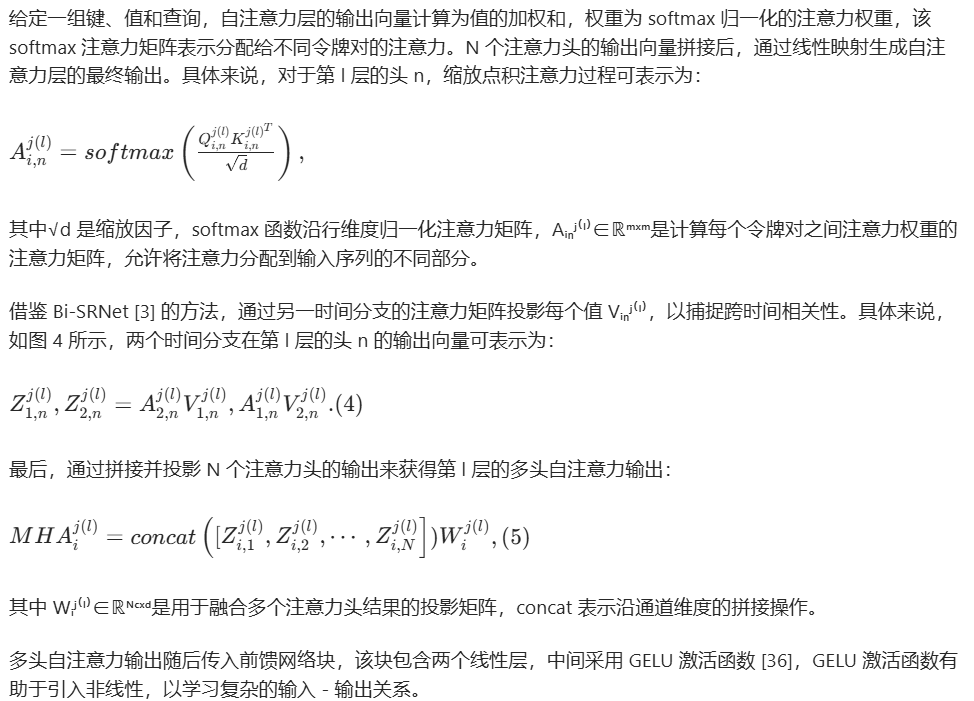

本文利用 Transformer 编码器通过自注意力机制捕捉长距离依赖关系,使模型能够全面理解双时相影像对中的空间和时间关系。如图 3 所示,Transformer 编码器块以令牌化特征图 Tᵢʲ为输入,生成编码输出特征图 Tᵢʲⁿᵉʷ。Transformer 编码器采用序列到序列架构,由堆叠的相同层组成,每层包含两个关键组件:多头自注意力(MHSA)块和前馈网络(FFN)块,每个块前均应用层归一化(LN)。特征图 T₁ʲ和 T₂ʲ对应的前馈网络共享参数,而对应的多头自注意力块不共享参数。

在将令牌集 Tᵢʲ(∀i∈{1,2})输入 Transformer 编码器之前,添加可学习的位置编码 Pᵢʲ∈ℝᵐˣᶜ:Tᵢʲ=Tᵢʲ+Pᵢʲ。在 Transformer 编码器的第 l 层,嵌入 Tᵢʲ⁽ˡ⁻¹⁾传入多头自注意力块,通过 N 个独立的注意力头将其投影到多个特征子空间。N 个注意力头不共享权重,每个注意力头包含两个主要组件:转换层和自注意力层。

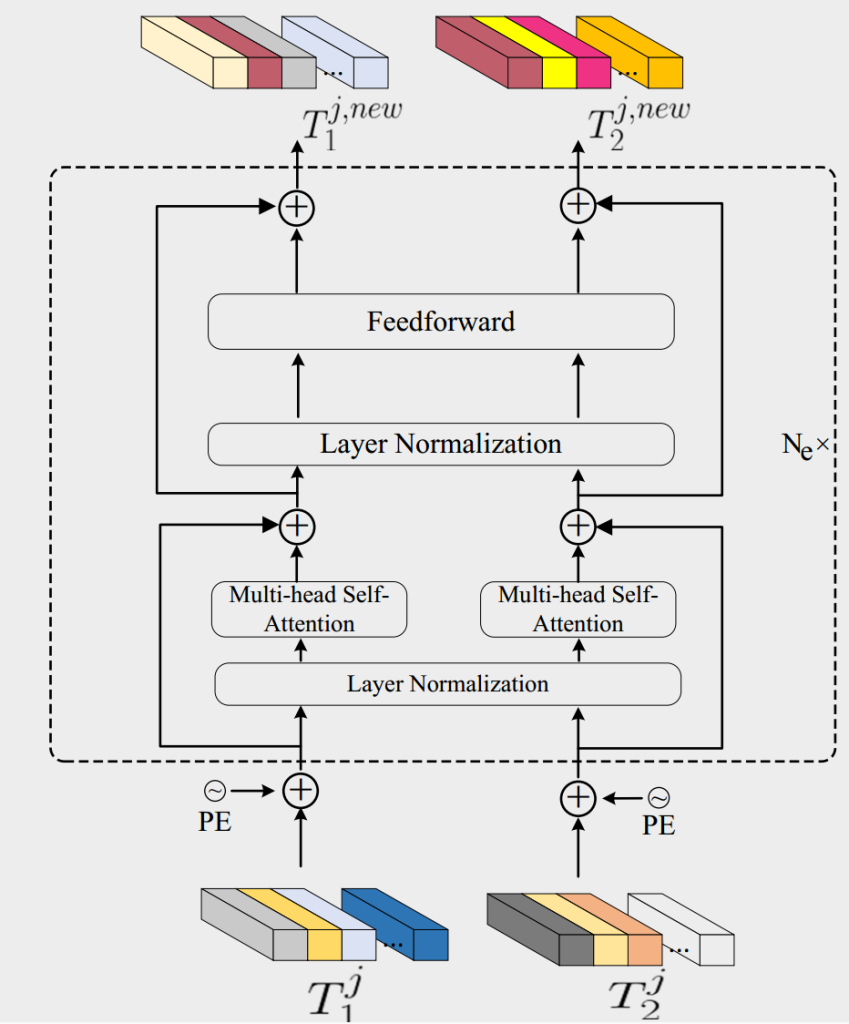

多头自注意力头 n 的转换层将输入向量 Tᵢʲ⁽ˡ⁻¹⁾映射为查询(Qᵢₙʲ⁽ˡ⁾∈ℝᵐˣᵈ)、键(Kᵢₙʲ⁽ˡ⁾∈ℝᵐˣᵈ)和值(Vᵢₙʲ⁽ˡ⁾∈ℝᵐˣᵈ)。具体来说,对于第 l 层的头 n,线性转换可表示为:\(\begin{aligned} & Q_{i, n}^{j(l)}=T_{i}^{j(l-1)} W_{i, n}^{q, j(l)}, \\ & K_{i, n}^{j(l)}=T_{i}^{j(l-1)} W_{i, n}^{k, j(l)}, \\ & V_{i, n}^{j(l)}=T_{i}^{j(l-1)} W_{i, n}^{v, j(l)}, \end{aligned}\)其中 Wᵢₙᵠʲ⁽ˡ⁾∈ℝᶜˣᵈ、Wᵢₙᵏʲ⁽ˡ⁾∈ℝᶜˣᵈ和 Wᵢₙᵛʲ⁽ˡ⁾∈ℝᶜˣᵈ是线性矩阵。

给定一组键、值和查询,自注意力层的输出向量计算为值的加权和,权重为 softmax 归一化的注意力权重,该 softmax 注意力矩阵表示分配给不同令牌对的注意力。N 个注意力头的输出向量拼接后,通过线性映射生成自注意力层的最终输出。具体来说,对于第 l 层的头 n,缩放点积注意力过程可表示为:\(A_{i, n}^{j(l)}=softmax\left(\frac{Q_{i, n}^{j(l)} K_{i, n}^{j(l)^{T}}}{\sqrt{d}}\right),\)其中√d 是缩放因子,softmax 函数沿行维度归一化注意力矩阵,Aᵢₙʲ⁽ˡ⁾∈ℝᵐˣᵐ是计算每个令牌对之间注意力权重的注意力矩阵,允许将注意力分配到输入序列的不同部分。

借鉴 Bi-SRNet [3] 的方法,通过另一时间分支的注意力矩阵投影每个值 Vᵢₙʲ⁽ˡ⁾,以捕捉跨时间相关性。具体来说,如图 4 所示,两个时间分支在第 l 层的头 n 的输出向量可表示为:\(Z_{1,n}^{j(l)},Z_{2,n}^{j(l)}=A_{2,n}^{j(l)}V_{1,n}^{j(l)},A_{1,n}^{j(l)}V_{2,n}^{j(l)}. (4)\)

最后,通过拼接并投影 N 个注意力头的输出来获得第 l 层的多头自注意力输出:\(M H A_{i}^{j(l)}=concat\left([Z_{i, 1}^{j(l)}, Z_{i, 2}^{j(l)}, \cdots, Z_{i, N}^{j(l)}\right] ) W_{i}^{j(l)}, (5)\)其中 Wᵢʲ⁽ˡ⁾∈ℝᴺᶜˣᵈ是用于融合多个注意力头结果的投影矩阵,concat 表示沿通道维度的拼接操作。

多头自注意力输出随后传入前馈网络块,该块包含两个线性层,中间采用 GELU 激活函数 [36],GELU 激活函数有助于引入非线性,以学习复杂的输入 – 输出关系。

图3. Transformer编码器块的图示。Ne表示相同层的数量。PE代表位置编码。

图4. Transformer架构中的注意力层概述。(a)多头自注意力块。(B)缩放点生产注意力的示例。如需更清晰的细节视图,请放大。

3.4 Transformer解码器

翻译

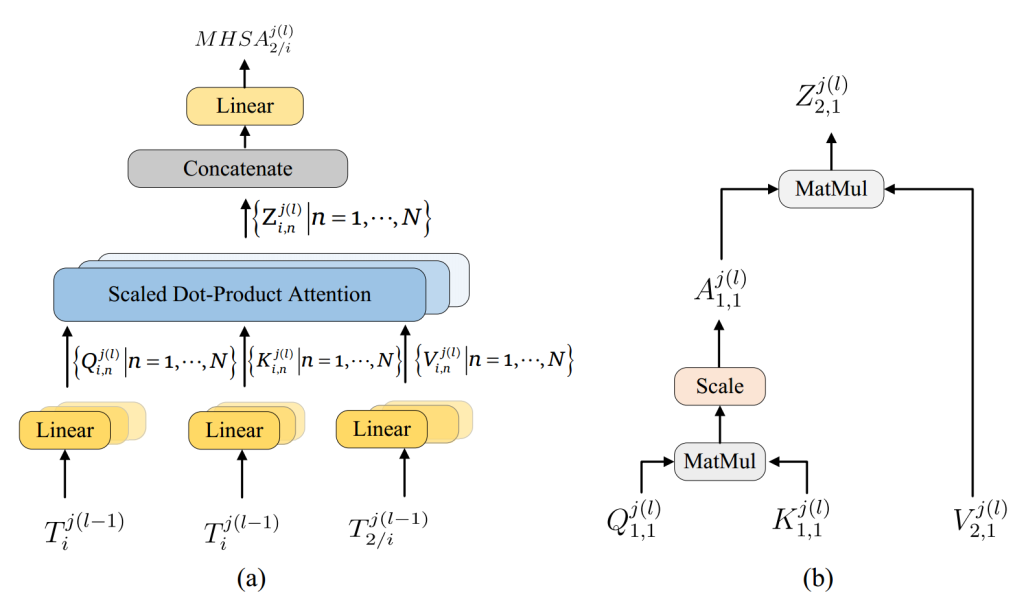

解码器块以编码器的输出为输入,在像素空间中重建像素级特征。如图 1 所示,令牌解码器以卷积特征 Fᵢʲ⁽³⁾和令牌编码器的输出 Tᵢʲⁿᵉʷ为输入。在输入解码器之前,向 Fᵢʲ⁽³⁾添加可训练的位置编码。与编码器类似,解码器也采用序列到序列架构,由堆叠的相同层组成,但解码器采用不同的输入特征映射方式:具体来说,解码器将 Fᵢʲ⁽³⁾映射为查询,并将 Tᵢʲⁿᵉʷ映射为键和值。特征 Fᵢʲ⁽³⁾经过 Transformer 模块处理后,得到特征 Fᵢʲ⁽⁴⁾。

图5. Transformer解码器过程的图示。同时输入特征F j(3)i和3D令牌嵌入T j,new i,从而产生输出特征F j(4)i。Nd表示相同层的数量。

3.5 多任务头和总损失

3.5.1 多任务头

翻译

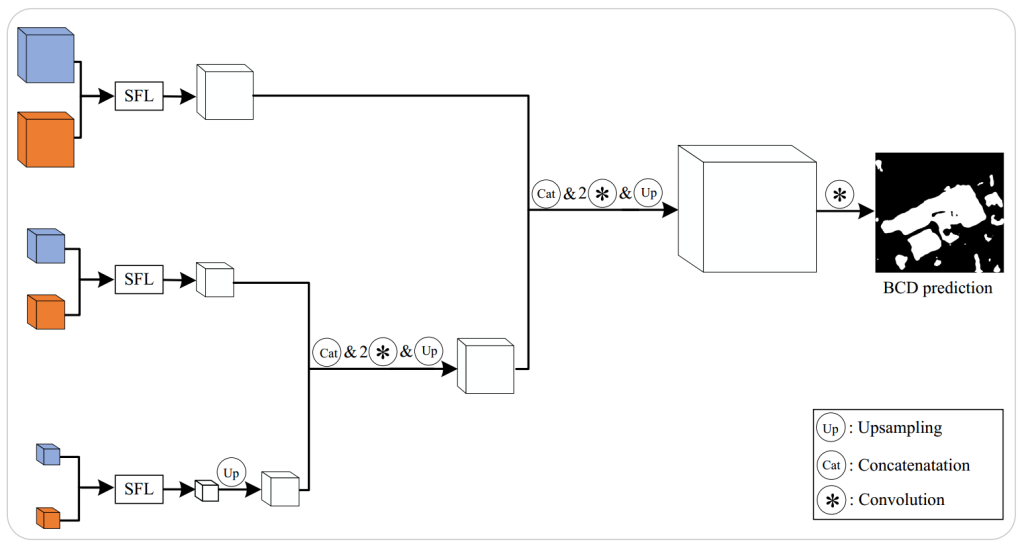

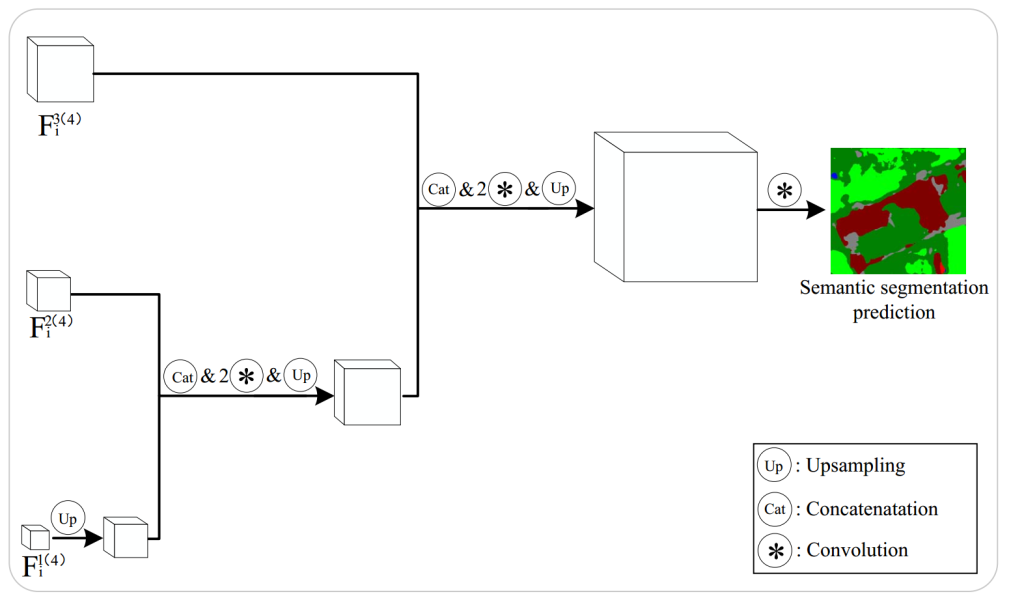

多任务头使模型能够利用不同任务间的共享表示,提高两个任务的性能。语义分割和二值变化检测均为像素级分类任务,为简化模型,两者采用相同的网络架构,仅进行少量修改:两个语义分割头共享权重,而二值变化检测头具有独立权重。如图 6 和图 7 所示,采用的架构是类 UNet [6] 网络,包含三个 2 倍上采样块,每个上采样块采用最近邻上采样,其中两个上采样块前应用两个 3×3 卷积层。除时空特征学习模块外,语义分割头和二值变化检测头的主要区别在于输出通道数:二值变化检测头有两个通道(对应变化和未变化区域),而语义分割头的通道数等于预定义的语义类别数。

图6. BCD磁头示意图。

图7.SS封头示意图

3.5.2 时空特征学习模块

翻译

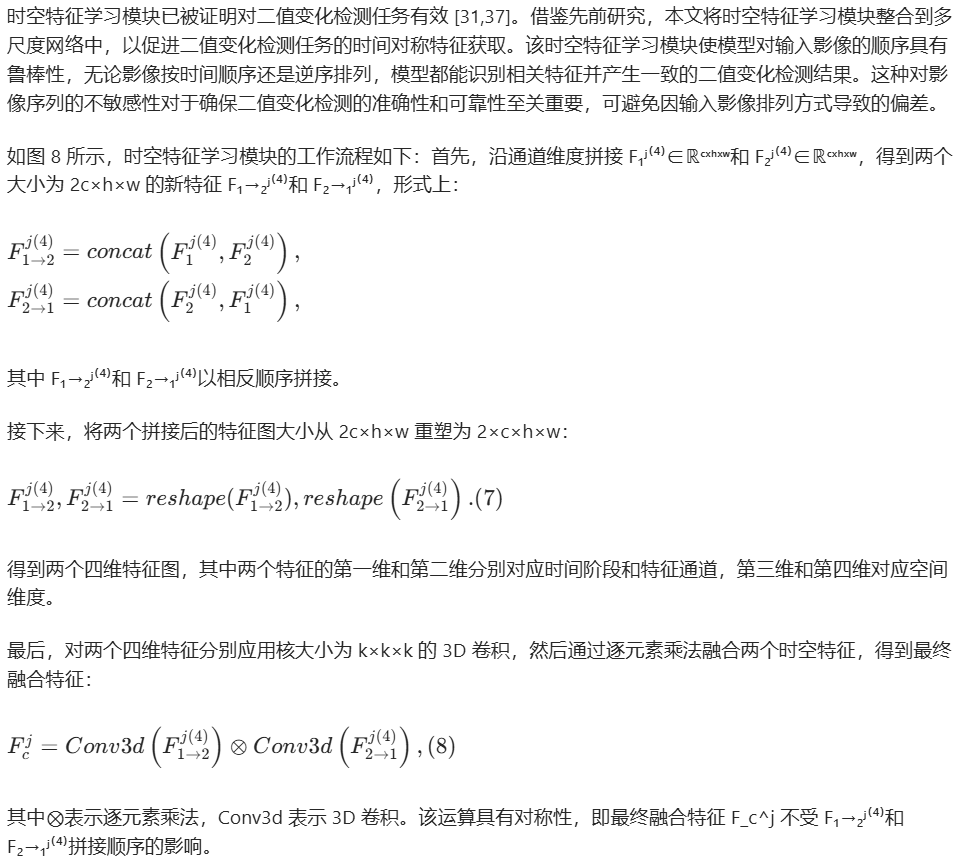

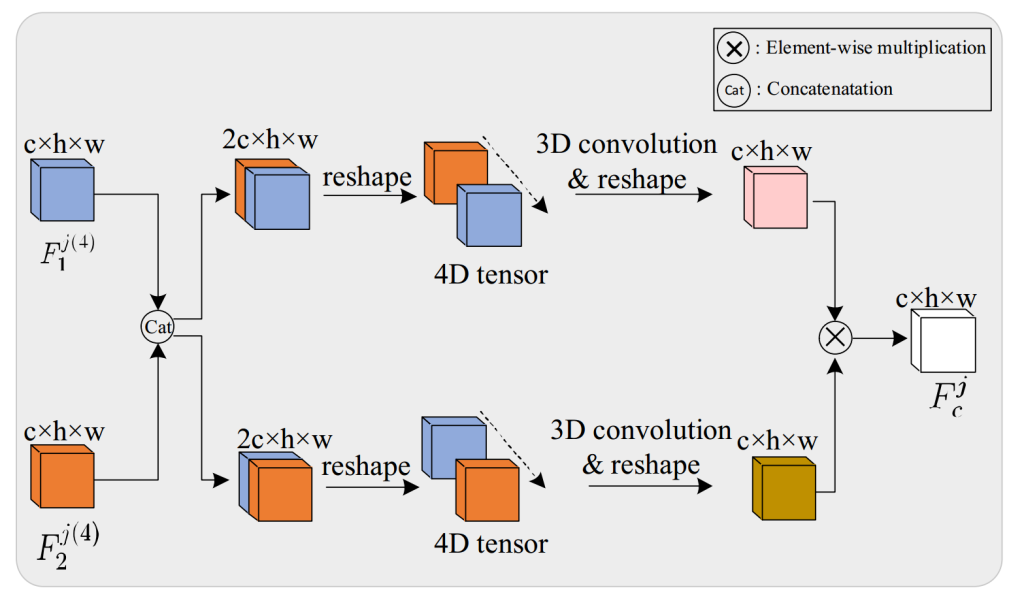

时空特征学习模块已被证明对二值变化检测任务有效 [31,37]。借鉴先前研究,本文将时空特征学习模块整合到多尺度网络中,以促进二值变化检测任务的时间对称特征获取。该时空特征学习模块使模型对输入影像的顺序具有鲁棒性,无论影像按时间顺序还是逆序排列,模型都能识别相关特征并产生一致的二值变化检测结果。这种对影像序列的不敏感性对于确保二值变化检测的准确性和可靠性至关重要,可避免因输入影像排列方式导致的偏差。

如图 8 所示,时空特征学习模块的工作流程如下:首先,沿通道维度拼接 F₁ʲ⁽⁴⁾∈ℝᶜˣʰˣʷ和 F₂ʲ⁽⁴⁾∈ℝᶜˣʰˣʷ,得到两个大小为 2c×h×w 的新特征 F₁→₂ʲ⁽⁴⁾和 F₂→₁ʲ⁽⁴⁾,形式上:\(\begin{aligned} & F_{1 \to 2}^{j(4)}=concat\left(F_{1}^{j(4)}, F_{2}^{j(4)}\right), \\ & F_{2 \to 1}^{j(4)}=concat\left(F_{2}^{j(4)}, F_{1}^{j(4)}\right), \end{aligned}\)其中 F₁→₂ʲ⁽⁴⁾和 F₂→₁ʲ⁽⁴⁾以相反顺序拼接。

接下来,将两个拼接后的特征图大小从 2c×h×w 重塑为 2×c×h×w:\(F_{1 \to 2}^{j(4)},F_{2 \to 1}^{j(4)}=reshape(F_{1\to 2}^{j(4)}), reshape\left(F_{2\to 1}^{j(4)}\right) . (7)\)

得到两个四维特征图,其中两个特征的第一维和第二维分别对应时间阶段和特征通道,第三维和第四维对应空间维度。

最后,对两个四维特征分别应用核大小为 k×k×k 的 3D 卷积,然后通过逐元素乘法融合两个时空特征,得到最终融合特征:\(F_{c}^{j}=Conv 3 d\left(F_{1 \to 2}^{j(4)}\right) \otimes Conv 3 d\left(F_{2 \to 1}^{j(4)}\right), (8)\)其中⊗表示逐元素乘法,Conv3d 表示 3D 卷积。该运算具有对称性,即最终融合特征 F_c^j 不受 F₁→₂ʲ⁽⁴⁾和 F₂→₁ʲ⁽⁴⁾拼接顺序的影响。

图8. BCD任务的SFL模块图示

3.5.3 总损失

翻译

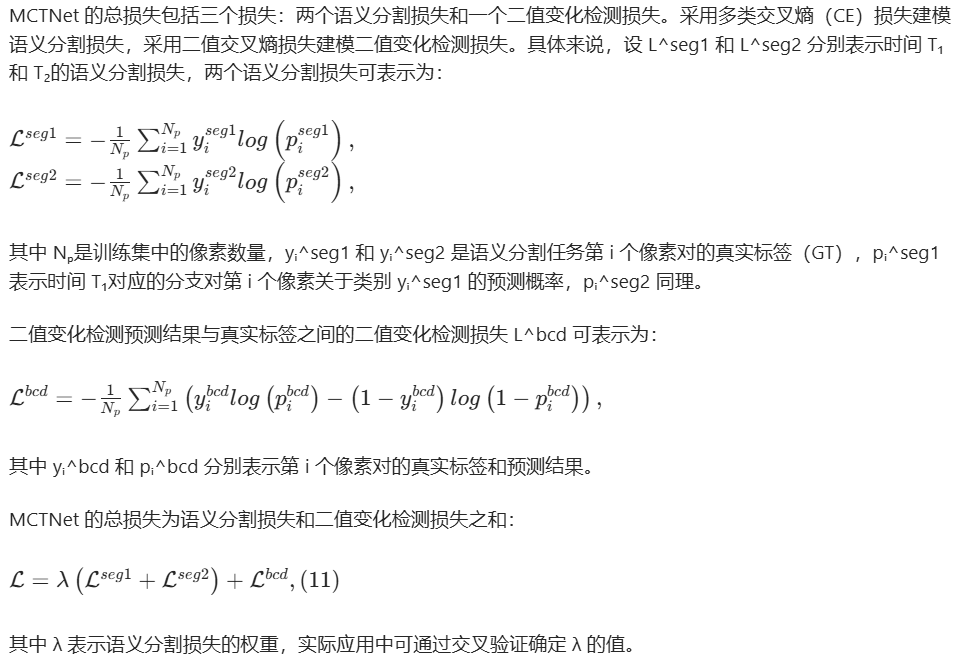

MCTNet 的总损失包括三个损失:两个语义分割损失和一个二值变化检测损失。采用多类交叉熵(CE)损失建模语义分割损失,采用二值交叉熵损失建模二值变化检测损失。具体来说,设 L^seg1 和 L^seg2 分别表示时间 T₁和 T₂的语义分割损失,两个语义分割损失可表示为:\(\mathcal{L}^{seg 1}=-\frac{1}{N_{p}} \sum_{i=1}^{N_{p}} y_{i}^{seg 1} log \left(p_{i}^{seg 1}\right), \\ \mathcal{L}^{seg 2}=-\frac{1}{N_{p}} \sum_{i=1}^{N_{p}} y_{i}^{seg 2} log \left(p_{i}^{seg 2}\right),\)其中 Nₚ是训练集中的像素数量,yᵢ^seg1 和 yᵢ^seg2 是语义分割任务第 i 个像素对的真实标签(GT),pᵢ^seg1 表示时间 T₁对应的分支对第 i 个像素关于类别 yᵢ^seg1 的预测概率,pᵢ^seg2 同理。

二值变化检测预测结果与真实标签之间的二值变化检测损失 L^bcd 可表示为:\(\mathcal{L}^{bcd}=-\frac{1}{N_{p}} \sum_{i=1}^{N_{p}}\left(y_{i}^{bcd} log \left(p_{i}^{bcd}\right)-\left(1-y_{i}^{bcd}\right) log \left(1-p_{i}^{bcd}\right)\right),\)其中 yᵢ^bcd 和 pᵢ^bcd 分别表示第 i 个像素对的真实标签和预测结果。

MCTNet 的总损失为语义分割损失和二值变化检测损失之和:\(\mathcal{L}=\lambda\left(\mathcal{L}^{seg 1}+\mathcal{L}^{seg 2}\right)+\mathcal{L}^{bcd }, (11)\)其中 λ 表示语义分割损失的权重,实际应用中可通过交叉验证确定 λ 的值。

4 实验

4.1 实验设置

4.1.1 数据集

翻译

本文在三个语义变化检测基准数据集上进行了全面实验:WHU-CD [38]、SECOND [39] 和 HRSCD [24]。

HRSCD:包含 291 对 RGB 航空影像,空间分辨率为 0.5 米,大小为 10000×10000 像素。每对影像均附有相应的土地覆盖标注,详细分为六个类别:无信息、人工表面、农业区、森林、湿地和水体。这些影像精心采集自法国雷恩和卡昂的城市和农村地区。本文对原始影像采用不重叠裁剪方法,仅当变化区域比例超过 10% 时才进行裁剪,最终得到 2373 对 512×512 像素的样本用于模型训练和评估。训练数据集中排除标注为 “无信息” 的像素,确保变化检测算法仅在其余五个类别上进行评估。数据集按 4:1 的训练 – 测试比例分为 1900 对训练影像和 473 对测试影像。

WHU-CD:包含新西兰克赖斯特彻奇 2012 年和 2016 年拍摄的两幅 32507×15354 像素的航空影像,空间分辨率为 0.2 米 / 像素。该数据集包含建筑物标签和 2012-2016 年间的建筑物变化标签。本文将两幅影像分割为不重叠的 256×256 像素块,用于模型训练和评估,数据集包含 4461 个训练块、1487 个验证块和 1486 个测试块。

SECOND:包含 4462 对来自不同传感器的遥感影像,其中 2968 对影像有公开标注。每幅 512×512 像素的影像空间分辨率为 0.3-5 米,覆盖杭州、成都和上海地区。数据集提供六种土地覆盖类别的像素级标注,包括非植被地面、树木、低植被、水体、建筑物和运动场,并包含 37 种潜在的土地覆盖变化类型(36 种跨类变化和未变化区域)。数据集按 4:1 的训练 – 测试比例分为 2375 对训练影像和 593 对测试影像。

4.1.2 评价指标

翻译

本文在二值变化检测和语义变化检测任务上,将 MCTNet 与多种基准算法进行了比较分析。借鉴 AMTNet [5] 的设置,二值变化检测采用四种常用评估指标:精确率、召回率、交并比(IoU)和 F1 分数;语义分割采用相同指标评估单个类别的性能,并比较所有类别的平均性能;为全面评估语义分割性能,还包括总体准确率(OA)、平均精确率(AP)和 Kappa 系数。

4.2 对比算法

翻译

本文将所提方法与近期最先进的变化检测算法进行了比较,包括基于 CNN 和基于 Transformer 的方法。纯基于 CNN 的对比算法包括 DTCDSCN [25]、DSIFN/IFN [40]、MFPNet [41] 和 SNUNet [42];基于 Transformer 的对比算法包括 BIT [18]、MSCANet [17]、Bi-SRNet [3]、ChangeFormer [43] 和 AMTNet [5]。其中,DTCDSCN 和 Bi-SRNet 是多任务网络,其他为单任务网络。所有对比算法均有公开实现。

4.2.1 实现细节

翻译

本文在 PyTorch 中实现了 MCTNet 和基准模型,使用 RTX 3090 GPU 进行训练和评估。标准化输入影像大小:WHU-CD 为 256×256 像素,SECOND 和 HRSCD 为 512×512 像素,批次大小为 8。采用 AdamW 优化器 [44],初始学习率为 1e-4,权重衰减为 0.01。为公平比较,MCTNet 与基准模型在二值变化检测和语义分割任务中均采用标准交叉熵损失。Transformer 模块包含 4 个编码器和 4 个解码器;时空特征学习阶段,3D 卷积核大小设为 3×3×3;训练过程采用随机旋转和翻转进行数据增强;令牌长度 l=4;模型训练 100 个 epoch。使用 ResNet-50 骨干网络时,WHU-CD 的训练时间约为 2.6 小时,SECOND 为 4.8 小时,HRSCD 为 3.8 小时。测试过程不使用数据增强。通过交叉验证确定损失权重 λ:WHU-CD 为 0.5,SECOND 为 0.01,HRSCD 为 0.1。

4.3 对比结果

4.3.1 二值变化检测对比结果

翻译

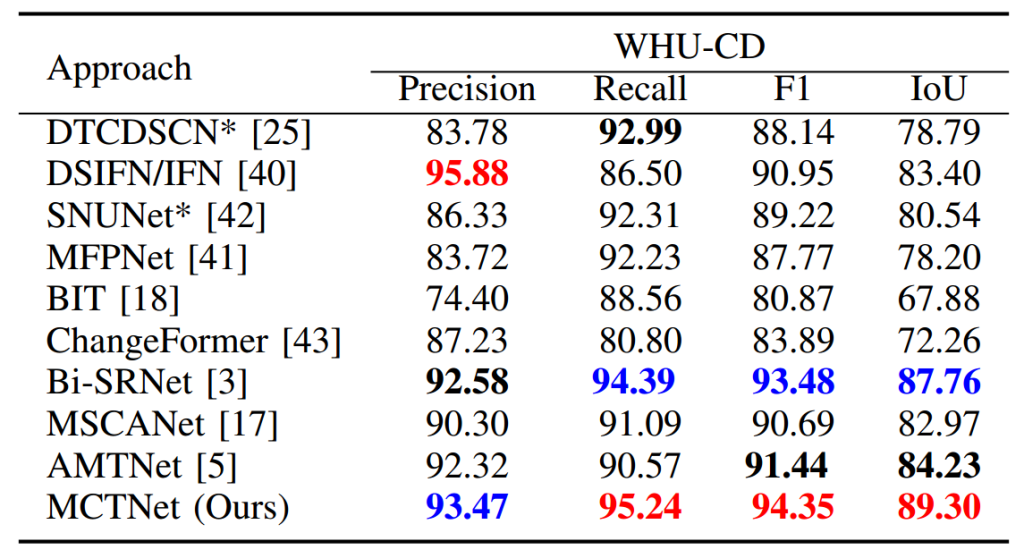

WHU-CD:如表 1 所示,MCTNet 在该数据集上取得了新的最先进结果,具体而言,MCTNet 的召回率最高(95.24%)、F1 分数最佳(94.35%)、交并比最高(89.30%),精确率排名第二(93.47%)。排名第二的模型是 Bi-SRNet,其精确率为 92.58%、召回率为 94.39%、F1 分数为 93.48%、交并比为 87.76%,整体表现优异。与 Bi-SRNet 相比,MCTNet 的精确率提高了 0.89%,召回率提高了 0.85%,F1 分数提高了 0.87%,交并比提高了 1.54%。单任务孪生 CNN-Transformer 网络 AMTNet 排名第三。MCTNet 和 Bi-SRNet 的性能提升可能归功于多任务架构。值得注意的是,精确率和召回率存在权衡关系(提高召回率可能降低精确率,反之亦然)。例如,DSIFN/IFN 的精确率最高,但召回率不高。如表 1 所示,对比算法的性能已非常高,提升空间有限。

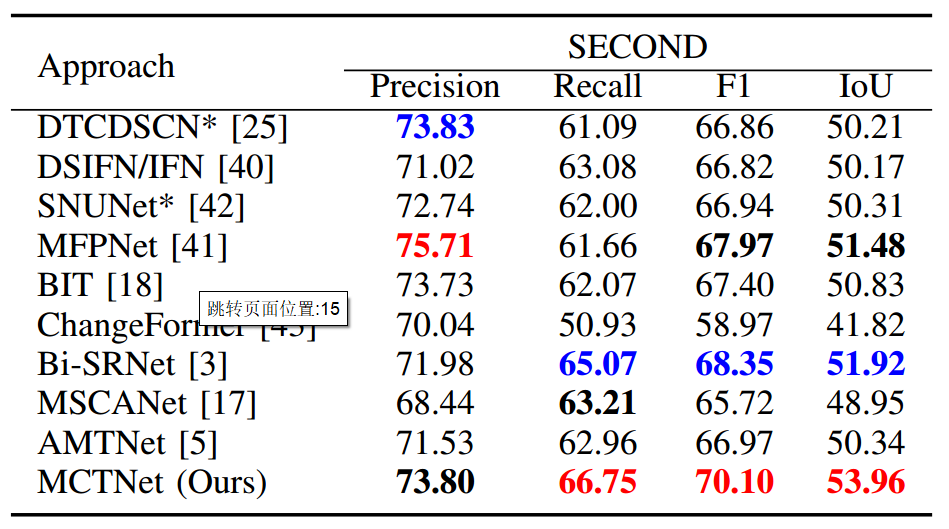

SECOND:如表 2 所示,MCTNet 在二值变化检测任务中取得了最佳整体结果,召回率为 66.75%、F1 分数为 70.10%、交并比为 53.96%。排名第二的是 Bi-SRNet,其精确率为 65.07%、召回率为 68.35%、F1 分数为 66.67%、交并比为 51.92%。与 Bi-SRNet 相比,MCTNet 的精确率提高了 1.82%,召回率提高了 1.68%,F1 分数提高了 1.75%,交并比提高了 2.04%。纯 CNN 模型 MFPNet 在该数据集上排名第三,其优异性能归功于其复杂的架构,该架构整合了多尺度特征和注意力模块。

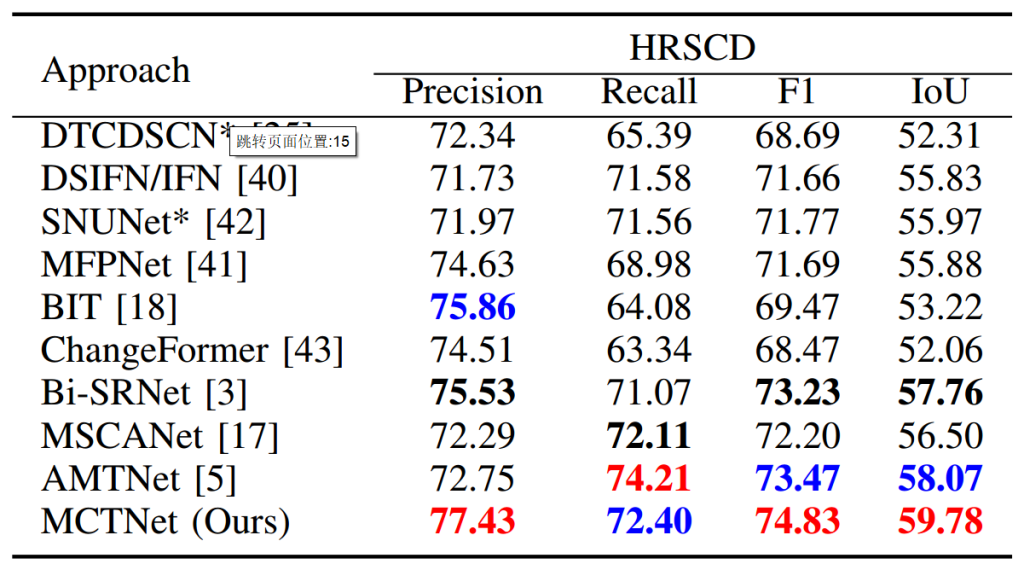

HRSCD:如表 3 所示,MCTNet 在 HRSCD 数据集的二值变化检测任务中表现优异,取得了最佳整体结果,精确率为 77.43%、召回率为 72.40%、F1 分数为 74.83%、交并比为 59.78%。CNN-Transformer 网络 AMTNet 排名第二,其精确率为 72.75%、召回率为 74.21%、F1 分数为 73.47%、交并比为 58.07%,其强大性能归功于其复杂的架构,该架构整合了卷积网络、Transformer、多尺度和注意力机制,能有效捕捉空间依赖关系。与 AMTNet 相比,MCTNet 的精确率提高了 4.68%,F1 分数提高了 1.36%,交并比提高了 1.71%。排名第三的是 Bi-SRNet,其精确率为 75.53%、召回率为 71.07%、F1 分数为 73.23%、交并比为 57.76%,表现同样出色。

注:标有 “*” 的结果是先前方法的非官方重新实现;颜色规则:红色最佳、蓝色次佳、黑色加深第三佳。

表 1 WHU-CD 数据集二值变化检测任务对比结果(%)

表 2 SECOND 数据集二值变化检测任务对比结果(%)

表 3 HRSCD 数据集二值变化检测任务对比结果(%)

4.3.2 语义分割性能对比

翻译

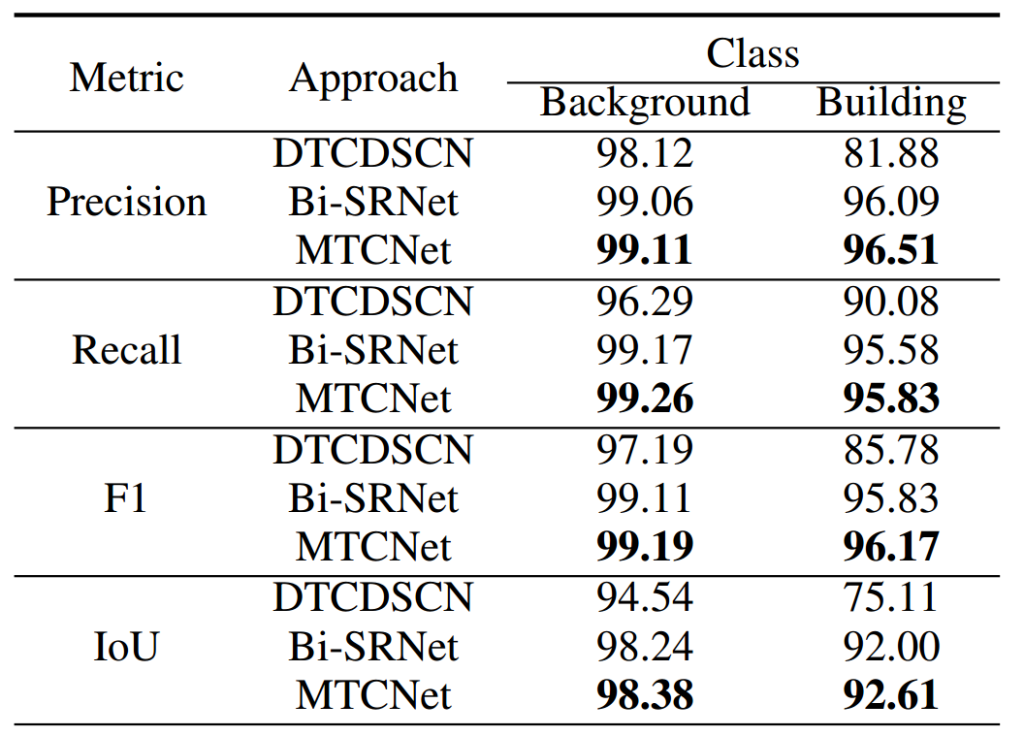

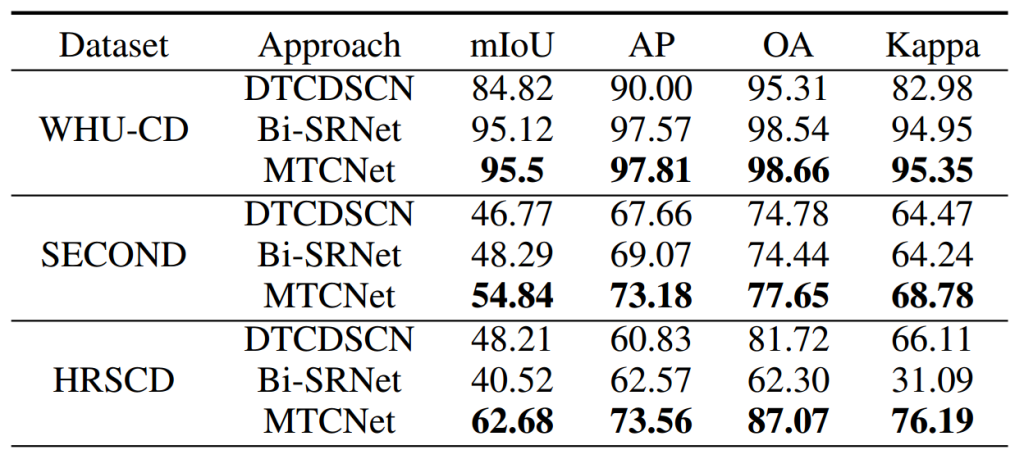

WHU-CD:该数据集仅包含两个语义类别:背景和建筑物。如表 4 所示,MCTNet 在该数据集的两个类别上均取得了最佳语义分割性能,Bi-SRNet 和 DTCDSCN 分别排名第二和第三。MCTNet 与 Bi-SRNet 的性能差距较小;纯 CNN 模型 DTCDSCN 的 F1 分数和交并比明显低于两个 CNN-Transformer 混合网络。MCTNet 的精确率为 96.51%、召回率为 95.83%、F1 分数为 96.17%、交并比为 92.61%。Bi-SRNet 和 MCTNet 在该数据集上的交并比均超过 90%,表明性能已接近饱和。此外,表 5 显示,MCTNet 在 WHU-CD 数据集上的所有语义变化检测方法中取得了最优的语义分割结果,体现在平均交并比、平均精确率、总体准确率和 Kappa 系数等指标上。

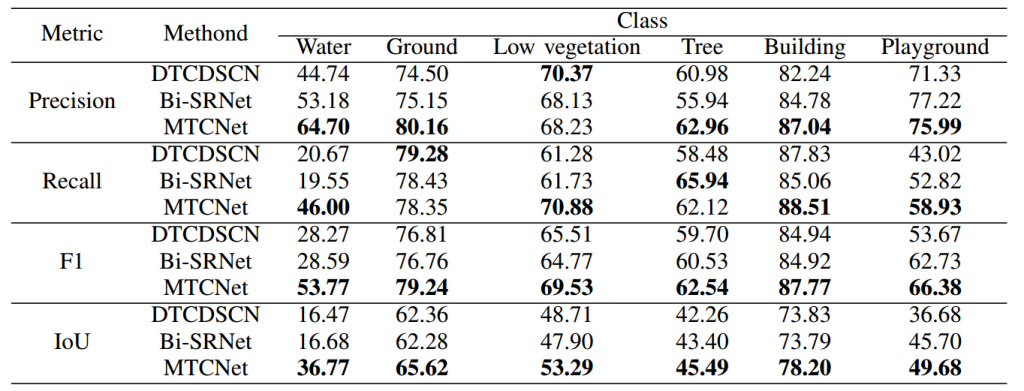

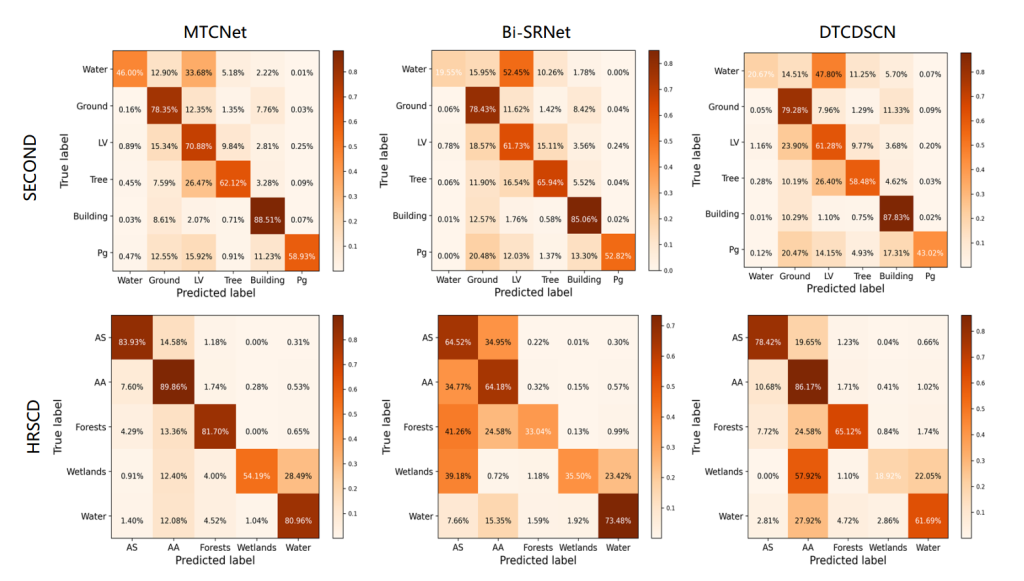

SECOND:与 WHU-CD 相比,SECOND 数据集包含六个不同类别,语义分割难度更高,且存在严重的类别不平衡问题(超过 80% 的样本属于地面、低植被和建筑物类别)。表 6 对比了三种语义变化检测方法在每个类别的性能,MCTNet 在精确率、召回率、F1 分数和交并比方面表现出最优的整体性能,尤其是在水体类别上,MCTNet 优于 Bi-SRNet 和 DTCDSCN。三种语义变化检测模型在地面、低植被和建筑物类别的四个评估指标上均表现出较强的识别能力。从图 9 可以看出,水体和树木有时会被误分类为低植被,运动场会被误分类为建筑物。尽管 MCTNet 在 SECOND 数据集上取得了最先进的性能,但仍需进一步改进,尤其是在稀有类别的召回率方面(如水体、低植被和树木)。

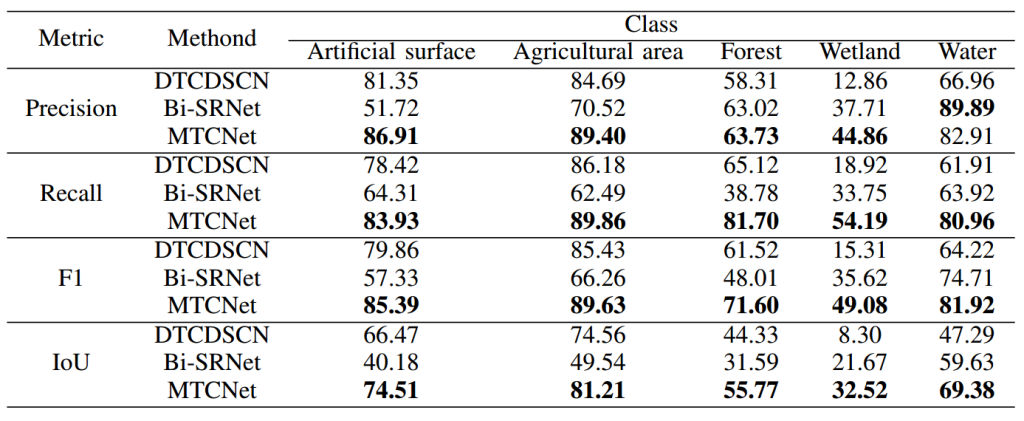

HRSCD:如表 7 所示,除水体类别的精确率外,MCTNet 在 HRSCD 数据集的所有类别上的四个评估指标均优于其他对比方法,尤其是湿地类别,本文算法的性能明显优于其他两种算法。从图 9 可以看出,Bi-SRNet 倾向于将森林误分类为人工表面或农业区,还倾向于将湿地误分类为人工表面;DTCDSCN 倾向于将湿地误分类为农业区。表 5 显示,MCTNet 在 HRSCD 数据集上的所有语义变化检测方法中取得了最优的语义分割结果,体现在平均交并比、平均精确率、总体准确率和 Kappa 系数等四个指标上。

表 4 WHU-CD 数据集语义分割对比结果(%)

表 5 语义分割对比结果(%)

表 6 SECOND 数据集语义分割任务对比结果(%)

表 7 HRSCD 数据集语义分割任务对比结果(%)

图 9 三种语义变化检测(SCD)算法在 SECOND 和 HRSCD 数据集上语义分割(SS)任务的混淆矩阵

4.3.3 可视化对比

翻译

图 10 直观对比了三个语义变化检测基准数据集上的二值变化检测结果。在图 10 中,红色和绿色像素越少,结果越好。二值变化检测的目标是最大化白色和黑色像素数量(反映对真实类别的更准确分割),同时最小化红色和绿色像素数量(代表错误预测)。图 10 显示,MCTNet 优于对比算法。大多数对比算法难以精确识别不同大小的不规则形状建筑物中的变化,而 MCTNet 仍能清晰勾勒出建筑物边界。

图 11 通过随机选择的样本直观评估了语义变化检测任务。所提 MCTNet 和 Bi-SRNet 在 WHU-CD 数据集上表现出色,能力相当;面对 SECOND 和 HRSCD 数据集时,MCTNet 优于 DTCDSCN 和 Bi-SRNet,能够精确识别和分类变化类型。与表 5、表 6 和表 7 的观察结果一致,MCTNet 模型在水体分割方面显著优于其他两种语义变化检测方法。

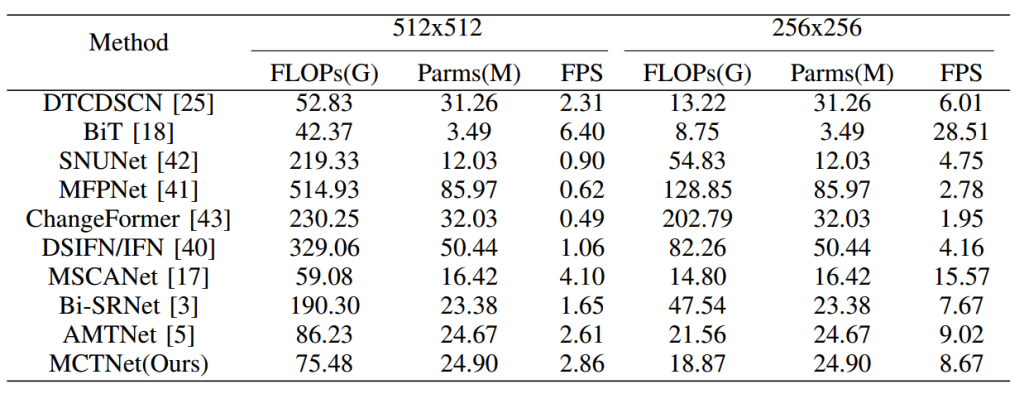

表 8 不同输入大小的效率对比分析

4.3.4 模型效率

翻译

本文评估了模型效率的三个关键指标:浮点运算量(FLOPs)、参数数量(Params)和帧率(FPS)。表 8 总结了输入大小为 256×256 像素和 512×512 像素时的这些指标。由于其复杂的多尺度设计,MFPNet 的浮点运算量和参数数量最高;在基于 Transformer 的网络中,ChangeFormer 由于其层次化 Transformer 编码器,计算复杂度和参数数量最高。输入影像大小为 512×512 像素时,MCTNet 的浮点运算量为 75.48 G,参数数量为 24.90 M;输入大小减小到 256×256 像素时,浮点运算量降至 18.87 G,参数数量仍为 24.90 M。在处理速度方面,MCTNet 优于多任务模型 DTCDSCN 和 Bi-SRNet。表 8 表明,MCTNet 在保持较低浮点运算量和参数数量的同时,取得了最先进的语义变化检测性能,且处理速度未受到显著影响。

4.3.5 讨论

翻译

实验结果揭示了三个关键观察结果:(1)在所有三个变化检测数据集上,基于 Transformer 的语义变化检测网络在变化检测任务上均优于二值变化检测网络,土地覆盖类别信息的整合提升了性能,这些语义变化检测网络通过多任务学习利用任务间的相关性,提高了整体性能;(2)与最先进的语义变化检测网络 DTCDSCN 和 Bi-SRNet 相比,本文方法表现出更优异的有效性;(3)本文语义变化检测网络表现出强大的性能和高效率。

4.4 不同模型设置的影响

本节研究了各种模型配置的影响,包括编码器和解码器数量、时空特征学习模块中的卷积核大小、语义分割损失权重 λ 以及语义分割损失类型。

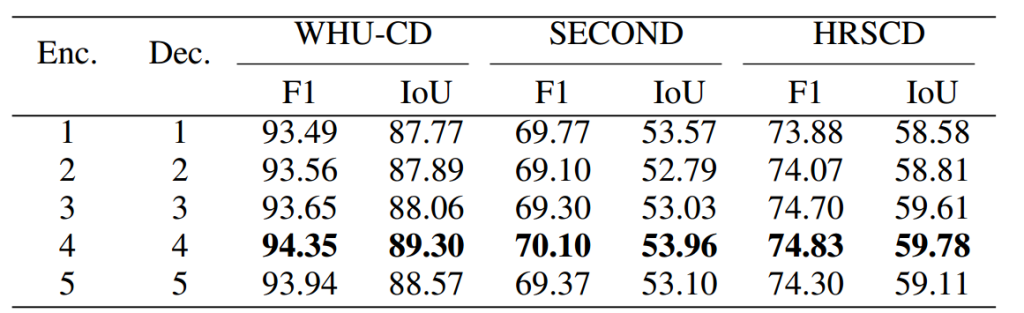

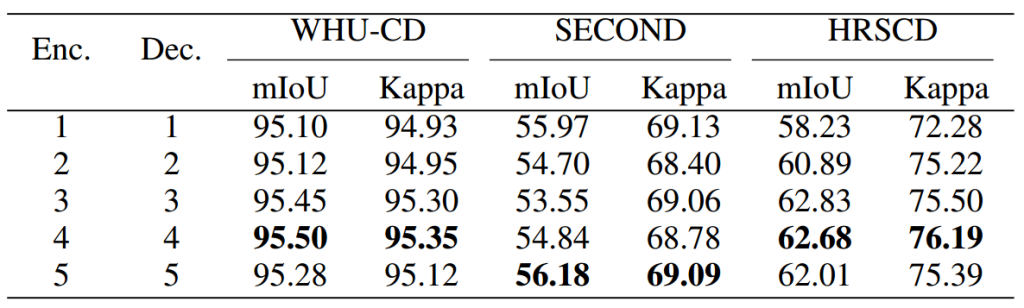

4.4.1 不同编码器-解码器配置的模型性能

翻译

表 9 和表 10 对比了不同编码器和解码器数量下 MCTNet 的性能。实验表明,仅使用一个编码器 – 解码器对即可在两个任务上取得稳健结果;随着编码器和解码器数量的增加,性能总体呈提升趋势,两个任务均在四个编码器和四个解码器时达到峰值。这些实验结果表明,四个编码器和四个解码器的设置在模型有效性和计算效率之间实现了最佳平衡;超过四个编码器和解码器后,性能提升有限,而计算需求增加,因此得不偿失。

表 9 编码器和解码器数量对二值变化检测的影响(%)

表 10 编码器和解码器数量对语义分割任务的影响(%)

4.4.2 时空特征学习模块中卷积核大小的影响

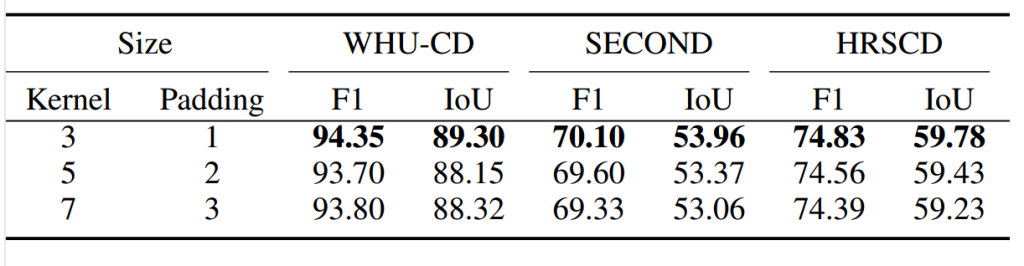

翻译

本文评估了时空特征学习模块中卷积核大小(3×3 至 7×7)的影响,详情如表 11 所示。模型在所有测试配置下均表现良好,但在核大小为 3、填充大小为 1 时取得最佳结果。

表 11 时空特征学习模块中卷积核大小对二值变化检测的影响(%)

表 12 时空特征学习模块中卷积核大小对语义分割任务的影响(%)

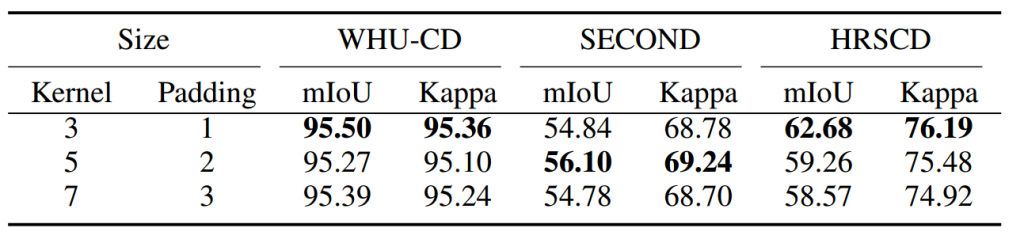

4.4.3 语义分割对二值变化检测的影响

翻译

表 13 展示了不同 λ 值下二值变化检测的性能,突出了语义分割对二值变化检测结果的重要影响。在 WHU-CD 数据集上,当 λ 设为 0.5 时,模型在二值变化检测任务上取得最佳性能,表明为该数据集分配适度的分割损失权重是最优的;在类别不平衡且语义类别更多的更具挑战性的 SECOND 和 HRSCD 数据集上,当 λ 取较小值(0.01 或 0.1)时,模型表现最佳。与 WHU-CD 相比,SECOND 数据集上的语义分割预测可靠性较低。因此,表 13 的结果还表明,在多任务框架中,如果语义分割任务的性能不佳,其增强二值变化检测任务性能的能力将受到影响。

表 13 不同 λ 值下语义分割对二值变化检测的影响(%)

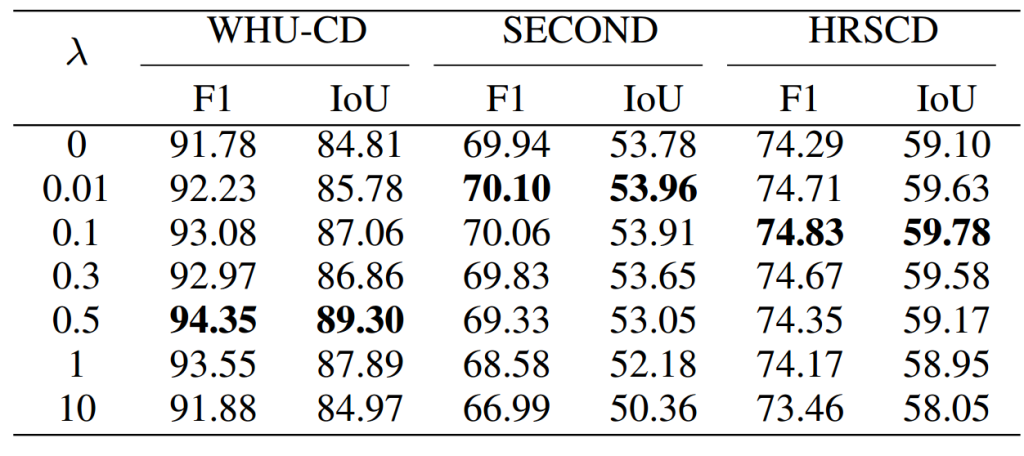

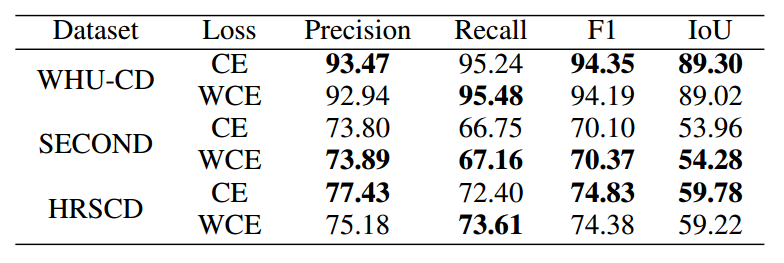

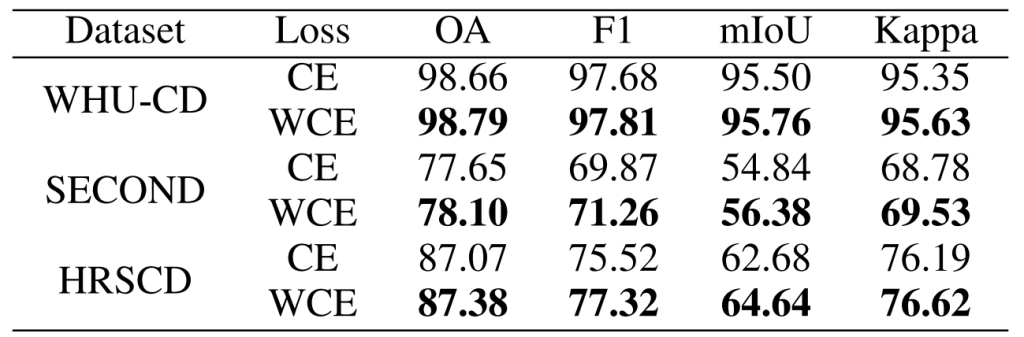

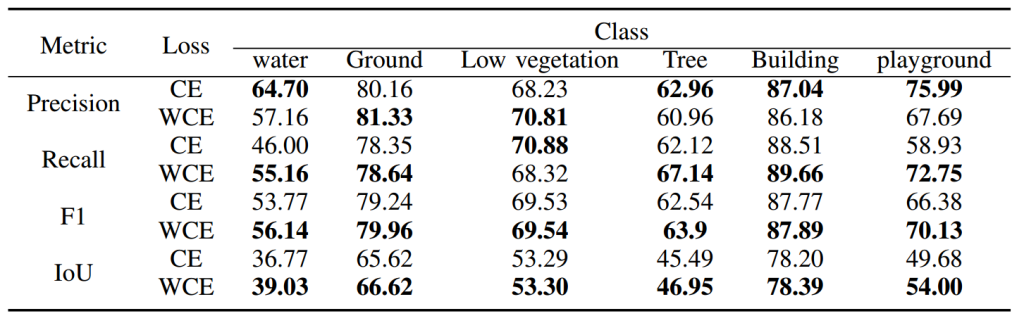

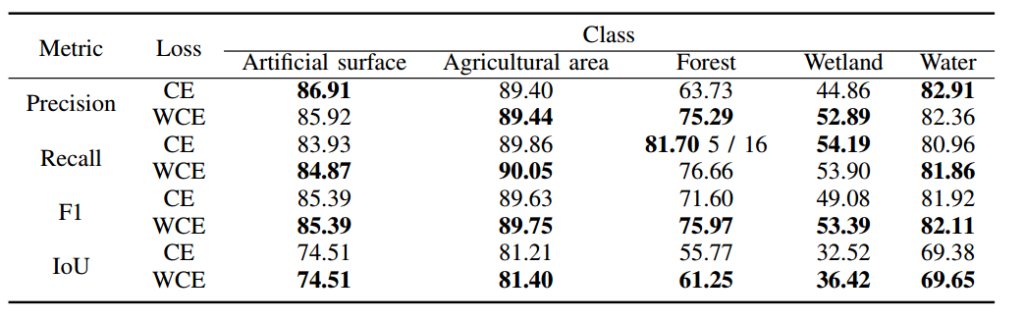

4.4.4 分割损失类型的影响

翻译

本文进行了对比研究,评估不同损失函数的影响。具体来说,通过整合从训练数据中计算的类别比例先验,将语义分割任务的标准交叉熵损失替换为加权交叉熵(WCE)[45,46]。加权交叉熵损失允许模型为稀有类别分配更高的重要性,从而提高其准确分类语义变化的能力。

表 14 至表 17 展示了使用不同损失函数的二值变化检测和语义分割结果。表 14 显示,使用加权交叉熵损失并未显著改善模型的二值变化检测性能;然而,表 15 表明,在类别分布不平衡的 SECOND 和 HRSCD 数据集上,加权交叉熵损失可以在一定程度上提高语义分割性能;在 WHU-CD 数据集上,加权交叉熵损失对语义分割任务的影响较小,这可能是因为该数据集仅包含建筑物和非建筑物两个类别,使用交叉熵损失时语义分割任务的性能已饱和。如表格 16 和表格 17 所示,在语义分割任务中使用加权交叉熵损失显著提高了 SECOND 数据集上稀有类别(如水体和运动场)的召回率;在 HRSCD 数据集上,森林和湿地等类别的 F1 分数和交并比指标得到了改善。这些结果突出了加权交叉熵损失在改善不平衡数据集上语义分割性能的有效性。

表 14 使用不同语义分割损失的二值变化检测结果(%)

表 15 使用不同损失函数的语义分割结果(%)

表 16 SECOND 数据集上使用不同损失函数的类别级语义分割结果(%)

表 17 HRSCD 数据集上使用不同损失函数的类别级语义分割结果(%)

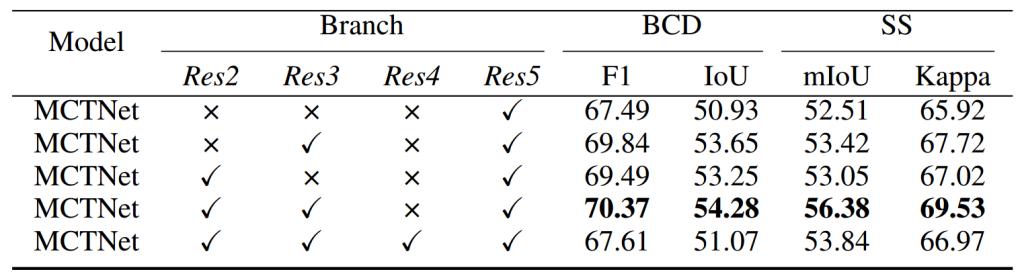

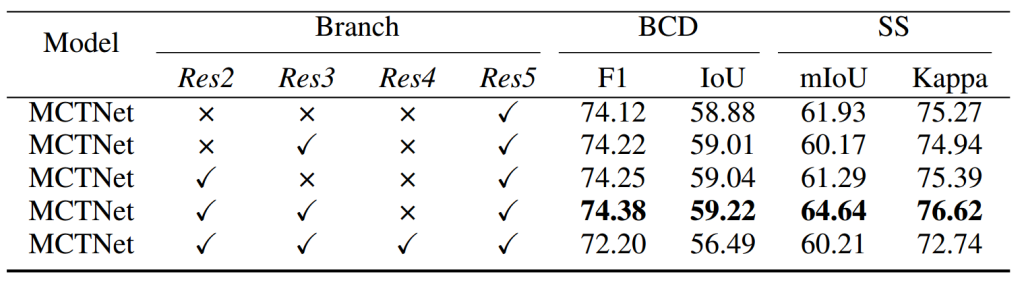

4.4.5 特征尺度数量的影响

翻译

为评估从骨干网络提取的特征尺度数量的影响,本文从四个不同尺度的残差块中提取多尺度特征图(Res4 和 Res5 输出特征尺度相同,对于 Res4 的输出特征,在多尺度特征融合阶段将其整合到从其他残差块提取的特征中)。如表 18 和表 19 所示,当利用从残差块 Res2、Res3 和 Res5 提取的三个特征尺度时,模型性能达到峰值。若尺度数量过少,模型可能难以充分表示不同粒度级别的特征,从而可能影响其检测遥感影像中细微变化的能力;而从 Res4 提取特征并将其与其他残差模块的输出特征融合,不仅未提升模型性能,反而导致性能下降。使用所有四个残差模块提取的特征图时性能下降,可能归因于以下因素:首先,额外的特征图可能引入冗余或噪声,削弱有效变化检测所需的判别信息;其次,这些特征图的整合过程可能并非最优,导致不同尺度间产生干扰或信号冲突。

表 18 特征尺度数量对 SECOND 数据集的影响

表 19 特征尺度数量对 HRSCD 数据集的影响

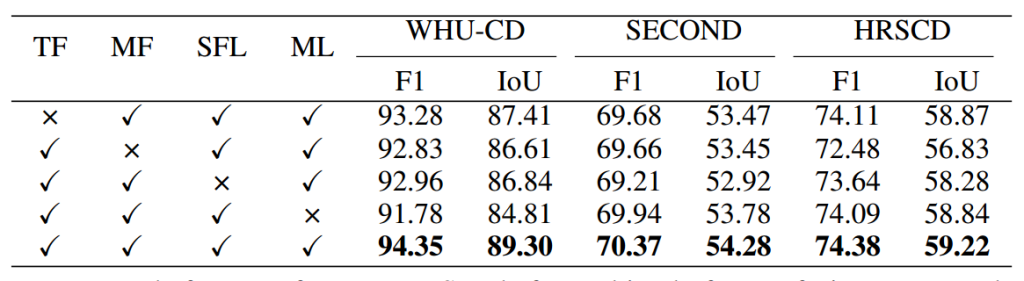

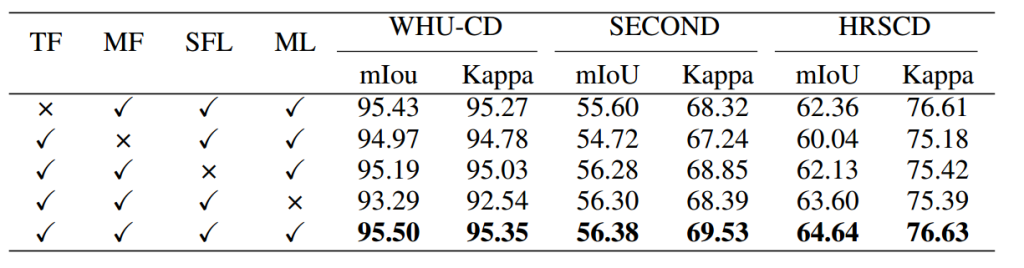

表 20 二值变化检测任务的消融结果(%)

表 21 语义分割任务的消融结果(%)

4.5 消融实验

翻译

为评估 MCTNet 中四个关键组件(Transformer 模块、多尺度特征融合、时空特征学习模块和多任务学习)的影响,本文进行了消融实验。语义分割任务在 WHU-CD 数据集上使用交叉熵损失,在 SECOND 和 HRSCD 数据集上使用加权交叉熵损失。

为评估每个模块的重要性,本文开展了一系列实验:移除网络架构中的单个组件并评估其性能。具体而言,通过移除 Transformer 模块来评估其作用;通过在 Fᵢʲ⁽²⁾到 Fᵢʲ⁽³⁾的过程中去除多尺度特征融合策略,以评估该策略的重要性;对于时空特征学习模块,将其移除后直接沿通道维度拼接特征图 F₁ʲ⁽⁴⁾和 F₂ʲ⁽⁴⁾,并确保二值变化检测头和语义分割头除输入和输出通道维度外保持相同结构;最后,为衡量多任务学习的有效性,在输出层仅保留一种任务头。

表 20 展示了二值变化检测任务的消融结果。在 WHU-CD 数据集上,Transformer 模块、多尺度机制、时空特征学习模块和多任务学习分别使 F1 分数提高了 1.07%、1.52%、1.39% 和 2.57%,使交并比提高了 1.89%、2.69%、2.46% 和 4.49%。在 SECOND 和 HRSCD 数据集上,这四个关键组件均在一定程度上提高了交并比和 F1 分数,但多任务学习对 SECOND 和 HRSCD 数据集的影响较小,这可能是由于语义分割性能较低所致。表 21 展示了语义分割任务的消融结果:在 WHU-CD 数据集的所有配置下,模型均表现出高性能,移除任何组件的影响都很小(性能已饱和);而移除多尺度特征融合后性能出现下降,这表明多尺度特征融合有助于模型理解和处理不同尺度的影像。

5 结论

翻译

本文提出了一种用于双时相遥感影像语义变化检测的多任务 CNN-Transformer 网络(MCTNet)。MCTNet 在三分支框架中结合了语义分割和二值变化检测任务。在 WHU-CD、SECOND 和 HRSCD 数据集上的大量实验表明,MCTNet 在语义变化检测中具有有效性和高效性。消融实验突显了 Transformer 模块、多尺度特征融合、时空特征学习模块和多任务学习在提升模型性能中的重要性。

本文认识到,使用在自然影像上预训练的 ResNet 骨干网络可能会限制性能,因为它无法充分捕捉遥感数据的特征。未来的研究将探索使用在遥感影像上训练的基础模型(如 Segment Anything Model [47])作为骨干网络;同时,将应用半监督域自适应技术,利用有标签的源数据、有限的有标签目标数据和大量无标签目标数据,提高在目标域上的性能。这些改进旨在增强遥感应用中语义变化检测方法的有效性和鲁棒性。