VcT:用于遥感图像变化检测的视觉变化Transformer

期刊IEEE TGRS 发布日期2023.10.24

主要研究团队 安徽大学

0 摘要

翻译

给定两幅遥感图像,视觉变化检测任务的目标是检测出它们之间的显著变化区域。现有的视觉变化检测器通常采用卷积神经网络(CNN)或变换器进行特征表示学习,并专注于学习图像之间变化区域的有效表示。虽然通过增强变化区域的特征可以获得良好的性能,但是,这些工作仍然受到限制,主要是由于忽视了挖掘不变的背景上下文信息。众所周知,变化检测的一个主要挑战是如何获得涉及不同变化(例如空间变化和阳光强度)的两个图像的一致表示。在本工作中,我们证明,仔细挖掘共同的背景信息提供了一个重要的线索,以学习一致的表示为两个图像,从而显然有利于视觉变化检测问题。基于这一观察,我们提出了一种新的视觉变化Transformer(VcT)模型来解决视觉变化检测问题。具体来说,首先使用共享骨干网络来提取给定图像对的特征图。然后,该方法将特征图的每个像素作为一个图节点,提出了一种基于结构化信息的粗糙变化图预测模型,利用聚类算法从变化图中挖掘出Top-K个可靠的特征,并对特征进行细化,然后,通过首先利用自/交叉注意(CA)方案并且然后经由锚点主要注意(阿帕)学习模块与原始特征交互来增强这些可靠的标记。最后,提出了预测头以获得更准确的变化图。

在多个基准数据集上的大量实验验证了我们提出的VcT模型的有效性。源代码和预训练模型可在https://github.com/EventAHU/VcT_Remote_Sensing_Change_Detection上获得。

索引术语-图形神经网络(GNN)、可靠令牌挖掘(RTM)、遥感、自我关注和Transformer、视觉变化检测

1、视觉变化检测任务的目标是检测两幅遥感图像之间的显著变化区域,面临的主要挑战是:如何获得涉及不同变化的两个图像的一致表示。

2、(动机)采用卷积神经网络的现有的视觉变化检测器由于忽视了挖掘不变的背景上下文信息,导致模型工作性能受到限制。

3、 (成果)提出一种新的视觉变化Transformer(VcT)模型

- 提出全新VcT框架,突破传统方法局限构建了“以挖掘不变背景信息”为核心的检测框架,首次将不变背景的可靠特征作为学习图像一致表示的关键线索。该框架通过共享骨干网络(改进的ResNet-18)提取特征、图神经网络*(GNN)建模结构化信息、自/交叉注意力(CA)增强特征、锚点-主注意力(APA)融合特征,最终实现更精准的变化图预测,有效解决了传统方法忽视背景信息的问题。

- 创新可靠性特征挖掘RTM模块设计了自动化的RTM模块,通过GNN生成粗糙变化图–>筛选Top-K最小置信度特征(对应不变区域)–>K-means聚类细化 的两阶段策略,自动挖掘两幅图像中的可靠背景特征。相较于传统Transformer方法依赖人工设定特征的方式,RTM模块提升了特征选择的效率与准确率,为后续一致表示学习提供了高质量输入。

- 实验验证在LEVIR-CD、WHU-CD、DSIFN-CD三大遥感变化检测基准数据集上,VcT模型相较于10种主流方法进行实验,验证VcT设计的可行性。

4、代码已开源

1 引言

翻译

遥感图像变化检测旨在从给定的两幅图像(如长时间间隔拍摄的光学、多光谱、红外及合成孔径雷达(SAR)图像)中,找出像素级的变化区域 [1]。它是模式识别与计算机视觉领域最重要的研究方向之一,已在众多领域得到广泛应用 [2-5]。尽管该领域已取得显著进展,但由于以下两方面问题,遥感图像变化检测仍是一项具有挑战性的艰巨任务。其一,不同遥感系统的时间、空间、光谱及辐射分辨率存在差异,这使得不同图像间的比较与分析难度极大;其二,光照强度、大气条件、土壤湿度等环境因素会导致图像质量下降,受这些因素影响,同一物体可能呈现出不同的光谱特征。近年来,随着技术的进步和应用需求的增长,卫星传感器的性能大幅提升,这使得我们能够获取更多数量的超高分辨率光学遥感图像,因此,光学遥感图像已成为变化检测的首选数据源。

越来越多的研究者投身于该研究领域,并提出了许多基于卷积神经网络(CNN)的模型 [6-10]。随后,为进一步扩大卷积层的感受野(RF),研究者们提出了多种方案,包括卷积层堆叠 [6,7]、空洞卷积 [9] 以及注意力机制 [6,8]。注意力机制的本质是为感兴趣的信息分配更高权重,从而抑制无用的背景信息。具体而言,现有模型可分为三类,即基于空间注意力的方法 [11,12]、基于通道注意力的方法 [11,12] 以及基于自注意力的模型 [6,13]。然而,现有方法通常要么在每幅图像上单独进行注意力学习,要么仅在空间 / 通道维度利用注意力机制融合双时相模态信息,因此,由于使用局部卷积滤波器,这些方法的性能仍存在局限性。

近年来,自注意力机制和 Transformer 因其在全局范围特征学习与建模方面的强大能力,受到了越来越多的关注 [10]。在自然语言处理和计算机视觉任务中,该方法均占据主导地位。目前也有部分最新算法将 Transformer 应用于遥感图像变化检测问题 [14-16]。具体来说,Chen 等人 [14] 将 CNN 特征表示为语义标记,并尝试利用 Transformer 编码器(TE)学习上下文信息,随后通过 Transformer 解码器(TD)网络将学习到的特征嵌入像素空间;Bandara 和 Patel [15] 提出一种包含分层 TE 和多层感知器(MLP)解码器的孪生网络架构,该架构无需 CNN 骨干网络即可实现良好性能;Zhang 等人 [16] 基于 Swin Transformer 网络,设计了一种用于遥感图像变化检测的完整 Transformer 网络。尽管这些模型的性能优于基于 CNN 的模型,但我们认为现有模型仍存在问题。总体而言,现有方法主要聚焦于增强两幅图像中变化区域的表示,却忽略了不变背景区域。因此,不变区域中不明显的变化可能会被放大,导致检测器将差异较大的不变区域误判为变化区域。众所周知,视觉变化检测问题的一个主要挑战是如何为输入的两幅图像获取一致的表示。这启发我们思考:如何利用不变信息抑制无关的杂乱变化,使最终检测结果更可靠?

在本文中,我们证实,挖掘不变背景标记能为学习两幅图像的一致表示提供重要线索,进而显著促进视觉变化检测问题的解决。基于这一发现,我们提出一种新型视觉变化 Transformer(VcT)框架,用于解决视觉变化检测问题。具体而言,我们首先采用共享骨干网络(选用改进的 ResNet18 [17])提取两幅图像的特征图;接着,将特征图的每个像素视为一个图节点,并利用图神经网络(GNN)对结构化信息进行建模,以实现粗糙变化图预测;之后,从粗糙变化图中筛选出 Top-K 个可靠标记,并通过 K 均值聚类算法 [18] 对其进行细化;为进一步增强局部和全局关联,我们提出自注意力操作对聚类后的特征进行编码,并将其分为两组,分别对应两幅图像,再通过交叉注意力(CA)模块进行特征交互学习;最后,引入一种新的锚点 – 主注意力(APA)模块,实现新生成标记与骨干网络特征之间的增强融合,并利用解码器模块输出最终的变化图。从图 1 中可视化的概率图可以看出,所提 VcT 模型能有效降低无关变化带来的不良影响。

综上所述,本文的贡献主要体现在以下三个方面:

- 与以往常采用视觉 Transformer(ViT)作为骨干网络提取特征表示的方法不同,我们提出一种名为 VcT 的新型遥感变化检测框架。该框架通过捕捉两幅图像中可靠标记间的依赖关系,有效利用了图像内和图像间的线索。

- 我们提出一种新型特征标记选择模块,即可靠标记挖掘(RTM)模块。该模块利用 GNN 从两幅图像中一致地识别出可靠背景标记。与以往基于 Transformer 的视觉变化检测方法依赖人工设定标记不同,我们的方法通过设计的 RTM 模块实现了标记选择的自动化,提升了检测过程的效率和准确性。

- 在多个广泛使用的遥感变化检测基准数据集上开展了大量实验,验证了所提 VcT 模型的有效性。

本文的结构安排如下:第二节简要介绍遥感图像变化检测和 Transformer 网络的相关工作;第三节详细阐述所提出的基于 RTM 的遥感图像变化检测 Transformer 框架;第四节通过大量实验验证所提模块的有效性;第四节 F 部分分析模型的局限性并提出未来可能的研究方向;最后,第五节对全文进行总结。

1、现有方法主要聚焦于增强两幅图像中变化区域的表示,忽略了不变背景区域。不变区域中不明显的变化可能会被放大,导致检测器将差异较大的不变区域误判为变化区域。

2、视觉变化检测问题的主要挑战是如何为输入的两幅图像获取一致的表示,如何利用不变信息抑制无关的杂乱变化,使最终检测结果更可靠是本文论文聚焦的问题。

一致表示,即对于两幅不同时相的图像,同一未变化的区域的特征要尽量保持一致。

2 相关工作

本节简要介绍遥感图像变化检测和 Transformer 网络的相关工作。关于这两方面的更多信息,可参考综述文献 [19,20]。

2.1 遥感图像变化检测

翻译

遥感图像变化检测可分为两类,即传统方法和基于深度学习的方法。传统方法包括代数算法 [21,22]、分类方法 [23] 以及变换方法 [24,25]。这类方法的主要缺点是鲁棒性不足,且通常依赖于分类的准确性。Lu 等人 [26] 提出一种基于马尔可夫随机场的变化检测方法(CDMRF),该方法将归一化植被指数、主成分分析、独立成分分析和马尔可夫随机场相结合,用于滑坡变化检测;Pu 等人 [27] 通过直接的多时相图像分类进行入侵物种变化检测,他们对比了人工神经网络和线性判别分析(LDA)两种分类器的性能,发现人工神经网络的表现优于 LDA [27]。传统变化检测方法主要依赖人工特征提取 [28-31],虽然这些方法通常具有较高的可解释性,但普遍依赖人工提取特征。

现有的遥感图像最优变化检测器均基于深度神经网络开发。第一类检测器采用两阶段方法:先对图像进行分类,再通过比较分类结果得到最终的变化区域 [32-34]。然而,这种方法存在一个缺点,即需要获取额外的分类标签和语义标签,成本较高。例如,部分研究者 [32,34] 先对每幅图像单独进行分割以获取语义标签,然后将同一区域的不一致标签视为变化区域。尽管这些方法看似直观,但对语义标签的需求增加了数据标注的成本。

第二类方法为单阶段方法,该方法效率更高,能够通过融合双时相信息直接生成变化结果。这类单阶段模型 [35,36] 可通过融合双时相信息直接预测变化区域,效率更高。基于补丁(patch)级别的算法将变化检测转化为相似性检测问题:先将双时相图像分割成多个补丁,再对每个补丁中心进行预测。Daudt 等人 [37] 将 CNN 应用于城市变化检测,对每个补丁进行分类;Rahman 等人 [38] 提出一种基于补丁的孪生神经网络,旨在检测物体的结构变化;Wang 等人 [39] 提出一种基于深度孪生卷积网络的方法,探究补丁大小对检测精度的影响。

与基于补丁级别的方法相比,基于像素级别的变化检测算法更有效,能够直接生成像素级的变化图。具体而言,Fang 等人 [40] 提出一种基于双学习的孪生框架(DLSF),该框架突出变化区域的像素级差异,进而聚焦于检测变化区域;Daudt 等人 [35] 提出两种全卷积网络的孪生扩展模型,能够从头开始学习像素级变化以实现变化检测。除上述基于 CNN 的模型外,还有部分研究基于生成对抗网络(GAN)和图卷积网络(GCN)展开。例如,Liu 等人 [41] 提出一种名为 SDACD 的有监督域自适应框架,用于跨域变化检测,该框架利用 GAN 对图像进行跨域风格转换,通过循环一致性约束以生成式方式有效缩小域差距;Noh 等人 [42] 提出图像重建损失,仅使用单幅未标记图像作为训练输入,通过 GAN 生成另一幅图像,网络将重建损失值作为检测标准;Ismail 和 Awad [43] 提出一种新型图结构(BLDNet),并利用 GCN 从非平稳邻域和局部模式中学习关联和表示。此外,还有部分研究基于注意力机制展开,将在第二节 B 部分进行介绍。

2.2 Transformer网络

翻译

Transformer 网络的核心组件是自注意力机制,该机制能很好地对输入标记的长距离关联进行建模 [44]。它最初被提出用于解决自然语言处理领域的翻译任务,与广泛使用的基于循环神经网络(RNN)的模型相比,性能有显著提升。受自注意力机制和 Transformer 成功的启发,部分研究者也尝试将该模型迁移到计算机视觉任务中。例如,Lee 等人 [45] 提出集合 Transformer(Set Transformer),设计了一种新型注意力机制,用于对输入集合中元素间的交互进行建模;Jiang 等人 [46] 提出一种新型高效锚点匹配 Transformer(AMatFormer),该模型对部分锚点特征进行自注意力 / 交叉注意力操作,并将这些锚点特征作为信息瓶颈,为所有原始特征学习表示。目前已提出许多具有代表性的 Transformer 模型,用于骨干网络特征提取(如 ViT [47]、Swin Transformer [48]),并广泛应用于分割 [48,49]、检测与跟踪 [50-53]、生成领域 [54,55] 等众多下游任务。此外,还有不少研究者采用 Transformer 网络进行多模态特征学习(如 RGB、语言、音频、事件流等)[56,57]。这些研究充分证明了 Transformer 对各种数据输入的有效性和泛化能力。

也有部分研究者将 Transformer 模型应用于视觉变化检测任务 [11,12,14,15,58-64]。引入注意力机制进行上下文建模对于识别变化至关重要,而学习全局关联信息能更好地增强特征。例如,Liu 等人 [11] 构建双注意力模块(DAM),利用空间和通道依赖关系改进特征表示;Zhang 等人 [12] 提出一种网络,通过注意力模块将原始图像的多层深度特征与图像差异特征融合;Jiang 等人 [58] 提出一种基于金字塔特征的注意力引导孪生网络;Cheng 等人 [60] 提出一种具有改进可分离性的深度网络(ISNet),该网络通过边际最大化和注意力机制策略对特征进行细化;Chen 等人 [14] 提取带有语义标记的视觉词,利用 Transformer 网络对时空上下文进行建模,并增强感兴趣区域;Bandara 和 Patel [15] 提出一种包含 Transformer 块的孪生网络,该网络通过分层结构高效提供精确变化检测所需的多尺度特征,此外,还构建了一个简单的 MLP 解码器;Xu 等人 [61] 利用遥感数据集对改进的 ViTAE 模型 [59] 进行预训练,并在检测任务中展现出良好性能;Zhang 等人 [62] 提出一种名为跨时相差分(CTD)的新型注意力机制,用于分析多时相图像中的关联变化,同时设计一致性感知块(CPB)以生成所需的变化图;Fu 等人 [63] 提出一种基于自适应频率 Transformer(AFFormer)的差分特征提取网络,该网络从频率角度分离变化目标与环境,为遥感图像变化检测任务提供更丰富、更详细的信息;Ghaderi 等人 [64] 也提出一种 Transformer 孪生网络,称为 SiamixFormer,用于建筑物检测。

与以往相关工作不同,本文提出的 VcT 框架考虑了不变背景信息,并引入一种新型 RTM 模块用于可靠标记选择。基于 RTM 模块,我们开发了一种新型 Transformer 架构,专门对代表不变区域的所选标记间的关联进行建模,而非像以往许多相关工作那样聚焦于增强变化区域。

3 所提方法

本节首先概述所提出的用于遥感图像变化检测的 VcT 框架,然后详细介绍该框架的各个部分,重点阐述输入嵌入、RTM 模块、自注意力 / 交叉注意力交互模块、APA 模块、预测头以及损失函数。

3.1 框架概述

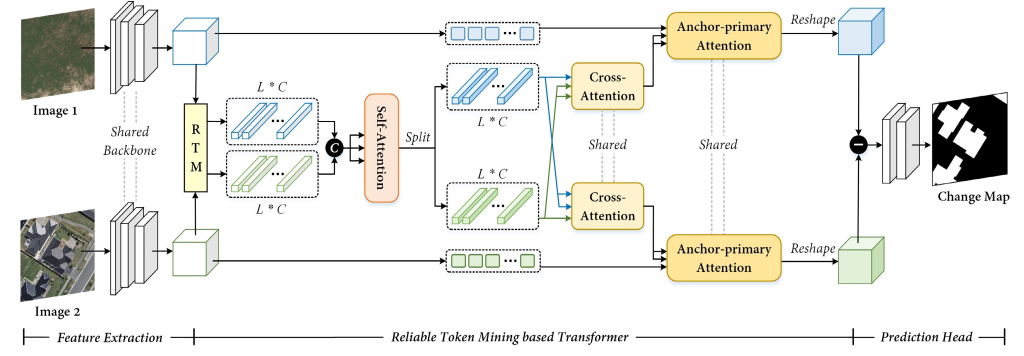

图 2 所提用于遥感图像变化检测的 VcT 框架概述。该框架主要包含四个模块,即共享骨干网络、RTM 模块、自注意力 / 交叉注意力特征增强模块以及 CNN 解码器。给定输入图像,首先采用共享 ResNet18 作为骨干网络进行特征嵌入;然后,提出一种新型 RTM 模块,通过聚类算法挖掘长度为 L 的标记,用于变化检测;接着,利用自注意力和交叉注意力分别进行图像内关联挖掘和图像间关联特征学习;再采用 APA 机制融合所选特征与原始骨干网络特征;最后,对两幅增强后的特征进行差分操作,并通过 CNN 解码器网络将其转换为变化图。

VcT网络模型包括:特征提取、基于可靠性标记挖掘的Transformer、预测头 三个核心部分

输入部分、共享骨架网络提取特征、编码器-解码器结构,编码器部分是基于可靠性标记挖掘的自注意力和交叉注意力模块部分,解码器是锚点-主注意力部分以及预测头输出部分。

- 特征提取输入网络的数据是两幅待检测变化的不同时相的遥感图像image1、image2;通过共享骨干网络(改进的ResNet18)分别提取两幅图像的特征图,得到对应image1的蓝色特征、image2的绿色特征。

- 基于可靠性标记挖掘的Transformer模型的核心创新部分:可靠性标记挖掘RTM模块,对两幅图像的特征图进行处理,通过“图神经网络+Top-K筛选+K均值聚类”,从特征中挖掘出代表不变背景区域的可靠标记(图中“L*C”的标记块),分别得到对应image1的蓝色标记和image2的绿色标记。自注意力:将两幅图像的可靠性标记进行拼接后,通过自注意力模块建模标记间的全局关联,增强特征表示。拆分与交叉注意力:把增强后的标记拆分为对应image1、image2的两组标记,再通过交叉注意力实现两幅图像标记间的信息交互,学习图像间的关联。锚点-主注意力:将交叉注意力输出的标记,与原始骨干网络提取的特征进行融合,进一步细化特征表示,同时通过reshape操作将标记恢复为特征图格式。

- 预测头该部分的处理:经过锚点-注意力与骨干网络提取的特征融合完成后的两幅特征图做差分运算,得到特征级差异图,然后通过卷积网络(图中堆叠的模块)将差异图转换为最终的变化图(change map)实现像素级的变化区域检测。

- ps:交叉注意力与锚点-主注意力模块的参数共享。

翻译

如图 2 所示,所提 VcT 框架主要由四个模块组成:骨干网络、RTM 模块、自注意力 / 交叉注意力 / APA 模块以及 CNN 解码器网络。给定两幅输入图像,首先通过共享骨干网络提取特征描述符(实验中选用改进的 ResNet18 [17]);接着,将这些特征输入 RTM 模块,通过聚类算法获取长度为 L 的标记,用于变化检测;然后,将输出特征拼接后输入自注意力模块,进行图像内关联挖掘,并利用交叉注意力(CA)层实现图像间关联特征学习;之后,采用 APA 模块融合所选特征与原始骨干网络特征;最后,对两幅增强后的特征进行差分操作,并通过 CNN 解码器网络输出变化图。

3.2 网络架构

本节介绍网络的主要组成部分,即输入嵌入模块、RTM 模块、自注意力模块、交叉注意力(CA)模块、APA 模块以及预测头。

3.2.1 输入嵌入

翻译

给定用于变化检测的两幅输入图像\(I_{1} \in \mathbb{R}^{H_{0} \times W_{0} \times 3}\)和\(I_{2} \in \mathbb{R}^{H_{0} \times W_{0} \times 3}\)(其中\(H_{0}\)和\(W_{0}\)分别表示输入图像的高度和宽度),我们选用 ResNet18 [17] 作为共享骨干网络,并对其进行轻微修改,以实现特征嵌入。输出特征图记为\(X_{1} \in \mathbb{R}^{H \times W \times C}\)和\(X_{2} \in \mathbb{R}^{H \times W \times C}\)(其中 C 为特征图的通道数)。众所周知,所使用的 CNN 骨干网络仅能学习局部特征,而现有研究表明,将特征图转换为标记后,基于自注意力的 Transformer 能很好地捕捉全局特征。然而,我们认为并非所有标记都对最终的变化检测结果有益。为解决这一问题,我们提出 RTM 模块用于选择可靠标记,具体介绍如下。

1、对ResNet18进行改进,模型处理的第一步预处理,将原始遥感图像转换成模型能看懂、能计算、能直接处理的数值特征“特征格式”。

2、输入嵌入–>特征图

3.2.2 可靠性标记挖掘(RTM)

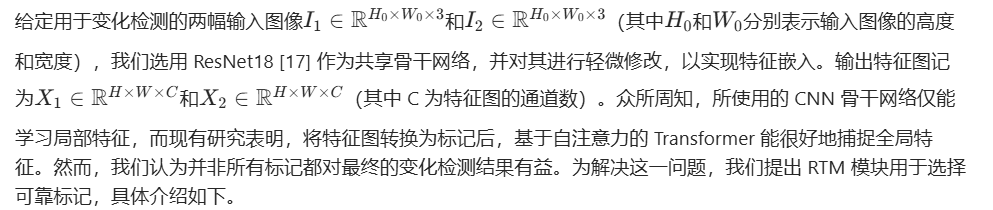

图 3 所提 RTM 模块示意图

RTM的流程:整体流程从底部的特征图输入开始,经过差异计算、图神经网络处理、聚类等步骤,最终生成聚类后的特征标记。

- 输入的特征图为,image1与image2经过共享骨干网络分别提取得到的蓝色特征、绿色特征。

- 模块底部左侧X1与右侧X2特征图,两者通过fabs函数计算得到特征差异图(feature different map),记为X̄。

- 特征差异图X̄输入到GNN(图神经网络)模块,经过N次处理后得到粗略变化图(coarse change map)。

- 粗略变化图分别导向左右两侧流程,左侧通过Top-K最小值选择得到K*C维度的特征,再经过K-means聚类生成L*C维度的特征标记;右侧流程与左侧流程一致,同样通过Top-K Min Selection和K-means聚类生成L*C维度的特征标记,这些标记作为该模块的输出。

fabs函数

通过fabs(绝对值)计算两者的特征差异图,即逐像素计算特征的绝对差值,差值越大代表越可能是变化区域。

图神经网络 GNN

作用:能利用空间关联更好地区域变化区域不变区域:比如某一区域的像素本身差异小,但周围像素差异大,GNN能通过图结构捕捉这种全局关联,避免仅依赖单个像素的局部判断,让粗略变化图的区分更准确,为后续Top-K筛选不变标记提供更可靠的依据。简单来说,GNN是RTM模块里初步识别不变区域的关键工具,帮助模型先粗筛出可能不变的背景,再结合Top-K和K均值做精筛。

原理:图神经网络GNN的核心原理是“用图结构建模数据关联,通过邻居节点信息传播更新自身特征”,简答来说就是让每个节点(比如图像像素、文本单词)“参考邻居的信息”,从而学习到更全面、更具结构化的特征,这和传统CNN只关注局部卷积窗口、Transformer依赖全局自注意力的逻辑完全不同。

Top-K Min Selection(Top-K最小值选择)

作用:从粗略变化图中筛选出最可能属于不变背景的特征。

原理:粗略变化图里的每个数值代表 “该区域是变化区域的概率”—— 数值越小,说明这个区域越可能是 “不变背景”。

计算流程:

- 拿到图神经网络(GNN)输出的粗略变化图,其中每个位置对应一个概率值。

- 找出这个图中数值最小的K个位置(K是预先设定的超参数,论文中提到K=1000)。

- 把这个K个对应的原始特征(来自X1、X2的特征图)提取出来,得到K*C维度的特征集合(C是通道数)。

K-means聚类

作用:把Top-K筛选出的特征进一步压缩、提炼成更具代表性的标记。

原理:K-means是一种无监督聚类算法,能把相似的特征聚成一类,用类中心代表这一类的特征,减少冗余,同时保留核心信息。

计算流程:

- 输入Top-K筛选后的K*C特征集合。

- 用K-means算法把这些特征聚成L类,L是预先设定好的超参数,比如论文中提到L=10,其大小远小于k。

- 取每一类的“中心特征”作为最终的“可靠标记”,得到L*C维度的精炼特征,对应流程图左右两侧的输出。

翻译

在视觉变化检测任务中,需要选择一些可靠标记(理想情况下来自不变区域),以实现两幅图像间的信息交互。为实现这一目标,我们需要确定哪些区域是不变的。因此,我们尝试设计一种不依赖预测头的检测器,以获取粗糙变化图作为先验知识。在具体实现中,我们提出采用图卷积网络(GCN)[65] 模块,并利用 K 均值聚类有效选择一些有效标记。K 均值算法简单高效,且不会增加模型的参数数量。实验结果表明,利用 GCN 获取的粗糙变化图与最终变化图更为接近,准确率更高。

具体而言,如图 3 所示,首先对两幅特征图进行差分运算,并取绝对值,得到特征差异图\(\bar{X}=|X_{1}-X_{2}| \in \mathbb{R}^{H \times W \times C}\);然后,将每个特征点(标记)视为图节点\(v_{i}\),将节点 i 和 j 之间的空间关联视为边\(e_{i,j}=(v_{i},v_{j}) \in E\),构建无向加权图\(G=\{V,E\}\);基于此图结构,标记选择任务可转化为图 G 中的节点选择问题。我们利用 GCN 对该图的结构化信息进行学习,获取图节点的可靠置信度,用于节点选择。具体来说,首先计算邻接矩阵\(A \in \mathbb{R}^{HW \times HW}\),该矩阵用于衡量图中节点对之间的交互作用,计算公式如下:

\(A_{i,j}= \begin{cases} \bar{x}_{i} \cdot \bar{x}_{j}, & \text{若} \ v_{i},v_{j} \ \text{相邻} \\ 0, & \text{其他情况} \end{cases}\)

其中\(\bar{x}_{i}\)和\(\bar{x}_{j} \in \bar{X}\)分别为节点\(v_{i}\)和\(v_{j}\)的特征描述符。通过 GCN 模块可对结构化信息进行建模和传播,GCN 每一层 l 的计算可表示为:

\(H^{(l+1)}=\sigma \left( \tilde{D}^{-\frac{1}{2}}(I+A)\tilde{D}^{-\frac{1}{2}} \right) H^{(l)}W^{(l)} \quad (2)\)

其中 I 为单位矩阵,\(\tilde{D}\)为对角矩阵,且\(\tilde{D}_{ii}=\sum_{j} \tilde{A}_{ij}\),\(\tilde{A}=A+I\);\(W^{(l)}\)表示可学习参数。需要注意的是,第一层的初始 H 设置为\(H^{(1)}=\bar{X}\)(重塑为\(\bar{X} \in \mathbb{R}^{HW \times C}\))。经过 GCN 层处理后,最终输出\(P=H^{(L)} \in \mathbb{R}^{H \times W \times 1}\)与\(\bar{X}\)具有相同的空间分辨率,P 中的每个元素对应粗糙变化置信度。P 可视为一维粗糙概率图或粗糙变化图,其可视化结果将在第四节 E 部分展示。显然,特征点的数值越大,该区域为变化区域的概率就越高。为选择高置信度的特征标记,我们记录这些特征标记在 P 中的位置坐标,并选取数值最小的 Top-K 个特征标记;通过置信度图 P,确定双分支对应的所选 K 个特征\(F_{1} \in \mathbb{R}^{K \times C}\)和\(F_{2} \in \mathbb{R}^{K \times C}\)。可靠标记来自原始特征图中代表不变区域的特征,两幅特征图从同一区域构建两组标记。为进一步减少标记数量,最终对\(F_{1}\)和\(F_{2}\)采用 K 均值算法 [18],得到 L(\(L \ll K\))个类中心锚点标记,分别作为双分支的\(T_{1}\)和\(T_{2} \in \mathbb{R}^{L \times C}\)(其中 L 为每组标记的长度,C 为通道维度)。

讨论:在从 Top-K 标记筛选到 L 个标记的过程中,一种更简单直观的方法是在获取数值最小的 Top-K 个标记后,直接从中选择 L 个标记。然而,不变区域的面积往往远大于变化区域,这种简单的标记选择策略可能并非最优,因为所选标记可能来自局部区域,而非多样的全局区域。相比之下,我们提出的两阶段选择方法,通过第一阶段的大规模选择和第二阶段的特征聚类,能够实现多样且准确的标记选择。

3.2.3 自注意力模块

翻译

通过上述 RTM 模块得到锚点标记\(T_{1}\)和\(T_{2}\)后,将它们拼接起来,得到\(T \in \mathbb{R}^{2L \times C}=T_{1} \| T_{2}\)(其中 “||” 表示拼接操作),并将其输入自注意力模块。由于自注意力模块中亲和矩阵的计算,该模块能够增强全局特征表示,并对 T 中不同标记间的关联进行建模。具体而言,我们采用预训练 ViT [47] 中的标准 Transformer 块来实现这一目标,该 Transformer 块主要包含位置嵌入(PE)、预归一化残差单元(PreNorm)[47]、多头自注意力(MSA)以及 MLP 块。在将标记 T 输入模块之前,首先通过可学习矩阵\(W^{q} \in \mathbb{R}^{C \times d}\)、\(W^{k} \in \mathbb{R}^{C \times d}\)和\(W^{v} \in \mathbb{R}^{C \times d}\)(其中 d 为 K、Q、V 的通道维度),将其转换为查询 Q、键 K 和值 V。然后,在每个注意力头中计算自注意力,公式如下:

\(SA(Q,K,V)=Softmax\left( \frac{QK^{T}}{\sqrt{d_{k}}} \right) V \quad (3)\)

通过拼接多个不同自注意力模块的学习结果,得到多头自注意力(MSA)。经过残差连接和归一化操作后,将 MSA 的输出输入 MLP 块。在我们的实现中,MLP 块包含两个线性层,激活函数采用广泛使用的高斯误差线性单元(GELU)[66]。可将 MSA 的输出分为两部分,即\(T_{1}^{*}\)和\(T_{2}^{*}\),用于后续的交叉注意力(CA)模块(将在下文介绍)。

1、由于自注意力模块中亲和矩阵的计算,该模块能够增强全局特征表示,并对T中不同标记间的关联进行建模。

2、使用预训练ViT中的标准Transformer块来实现,该Transformer块主要包括位置嵌入、预归一化残差单元、多头注意力以及多层感知机。

3.2.4 交叉注意力(CA)模块

1、用于双锚点标记输入间的图像间的关联学习,实现两幅图像间的信息交互。

翻译

上述自注意力模块用于捕捉给定特征的图像内关联,本节将介绍交叉注意力(CA)模块,用于双锚点标记输入间的图像间关联学习,以实现两幅图像间的信息交互。与自注意力(SA)模块不同,首先按如下方式获取查询 Q、键 K 和值 V:

\(Q=T_{1}^{*}, \ K=T_{2}^{*}, \ V=T_{2}^{*} \quad (4)\)

因此,交叉注意力(CA)的计算过程可表示为:

\(CA(Q,K,V)=Softmax\left( \frac{QK^{T}}{\sqrt{d_{k}}} \right) V\)

通过交叉注意力(CA)模块,得到两幅图像对应的两组标记\(\tilde{T}_{1} \in \mathbb{R}^{L \times C}\)和\(\tilde{T}_{2} \in \mathbb{R}^{L \times C}\),并将其输入后续的 APA 模块,以实现最终的变化检测。

3.2.5 锚点-主注意力(APA)

1、通过在像素级空间对特征进行细化,得到最终的特征图。

翻译

本节采用孪生锚点 – 主注意力(APA),通过在像素级空间对特征进行细化,得到最终的特征图。APA 块的结构与上述 Transformer 块类似,但不含位置嵌入(PE)块,这与文献 [45,46] 中的建议一致。APA 块主要包含预归一化(PreNorm)、多头锚点 – 主注意力(MAPA)以及 MLP 块。具体而言,在 APA 中,键 K 和值 V 从标记\(\tilde{T}_{1}\)或\(\tilde{T}_{2}\)中获取,而查询 Q 从原始特征图中获取。形式上,APA 的计算可表示为:

\(\begin{aligned} \tilde{X}_{i} &= APA(Q,K,V) \\ &= APA\left( X_{i}W^{q}, \tilde{T}_{i}W^{k}, \tilde{T}_{i}W^{v} \right) \end{aligned}\)

\(APA(Q,K,V)=Softmax\left( \frac{QK^{T}}{\sqrt{d_{k}}} \right) V\)

其中\(i=\{1,2\}\),\(W^{q}\)、\(W^{k}\)、\(W^{v} \in \mathbb{R}^{C \times d}\)为可学习参数。

3.2.6 预测头

1、将APA模块输出的特征向量使用reshape重塑为二维特征图,然后设计预测头,将这些特征转化为最终的变化图。

2、预测头:对二维特征图进行差分运算,生成特征级差异图,随后将其上采样至原始尺寸,并输入卷积神经网络得到预测图。

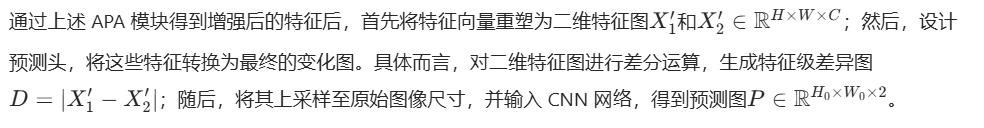

翻译

通过上述 APA 模块得到增强后的特征后,首先将特征向量重塑为二维特征图\(X_{1}’\)和\(X_{2}’ \in \mathbb{R}^{H \times W \times C}\);然后,设计预测头,将这些特征转换为最终的变化图。具体而言,对二维特征图进行差分运算,生成特征级差异图\(D=|X_{1}’-X_{2}’|\);随后,将其上采样至原始图像尺寸,并输入 CNN 网络,得到预测图\(P \in \mathbb{R}^{H_{0} \times W_{0} \times 2}\)。

3.3 损失函数

1、将变化检测视为二分类问题,使用交叉熵损失函数训练VcT模型。

2、VcT模型输出的是二维变化图,第一维表示不变区域的概率/置信度,第二维表示变化区域的概率/置信度。

翻译

将变化检测视为二分类问题,采用交叉熵损失函数训练所提 VcT 方法。需要注意的是,我们的模型输出二维变化图,其中第一维表示不变区域的概率 / 置信度,第二维表示变化区域的概率 / 置信度。将 ground truth 从单通道扩展为双通道,并对每个像素进行独热编码,得到\(G \in \mathbb{R}^{H_{0} \times W_{0} \times 2}\)。损失计算基于模型输出与 ground truth 独热编码,公式如下:

\(L_{bce}(\mathcal{G},\mathcal{P})=-\frac{1}{H_{0} \times W_{0}} \sum_{i=1}^{H_{0} \times W_{0}} \mathcal{G}(i)log\mathcal{P}(i)\)

其中\(\mathcal{G}\)表示真实 ground truth 值,\(\mathcal{P}\)表示预测值,\(H_{0}\)和\(W_{0}\)分别表示输入图像的高度和宽度。

4 实验

4.1 数据集与评价指标

翻译

实验采用三个广泛使用的高分辨率(HSR)遥感图像数据集,分别为 LEVIR-CD [6]、WHU-CD [67] 和 DSIFN-CD [12],以下简要介绍这些数据集。

- LEVIR-CD[6]:该数据集专为建筑物变化检测设计,包含 637 对超高分辨率(VHR)图像补丁,分辨率为 0.5 米 / 像素,尺寸为 1024×1024 像素,数据来源于谷歌地球。数据集由专家标注,共包含 31333 个独立的建筑物变化样本。将每对图像分割为 256×256 像素的非重叠补丁,数据集进一步划分为训练集、验证集和测试集,分别包含 7120、1024 和 2048 对图像补丁。

- WHU-CD[67]:该数据集记录了 6.3 级地震后受灾区域的变化以及数年后的重建情况,图像分别拍摄于 2012 年和 2016 年,在 20.5 平方公里的区域内包含超过 10000 栋建筑物。该航空数据集经过地理校正,精度达 1.6 像素;每幅图像的空间尺寸为 15354×32507 像素,空间分辨率为 0.2 米。将每幅图像分割为 256×256 像素的非重叠补丁,最终得到训练集、验证集和测试集,分别包含 6096、760 和 760 对图像补丁。

- DSIFN-CD[12]:该数据集用于建筑物变化检测,包含 6 幅覆盖中国六个城市(北京、成都、深圳、重庆、武汉和西安)的大尺寸多时相高分辨率图像。图像从谷歌地球手动采集,裁剪为 394 对子图像,尺寸为 512×512 像素。经过数据增强后,共得到 3940 对双时相图像;剩余图像对裁剪为 48 对,用于模型测试。参考最新的部分变化检测方法,将 512×512 像素的图像分割为 256×256 像素的非重叠补丁,并采用作者默认的训练 / 验证 / 测试集划分方式。最终,数据集的训练集、验证集和测试集分别包含 14400、1360 和 192 对图像补丁。

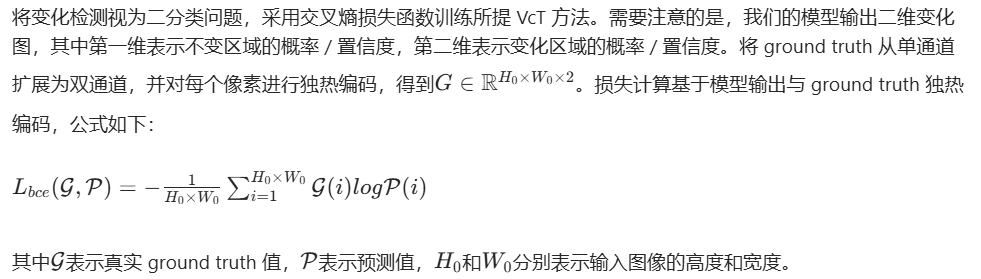

实验采用五个评价指标评估变化检测算法的性能,包括精确率(Precision)、召回率(Recall)、交并比(IoU)和总体准确率(OA)[14],其定义如下:

\(Recall = \frac{TP}{TP+FN} \quad (9)\)

\(OA = \frac{TP+TN}{TP+TN+FN+FP}\)

其中 TP(真阳性)、TN(真阴性)、FP(假阳性)和 FN(假阴性)分别表示真阳性、真阴性、假阳性和假阴性的数量。特别地,F1 分数综合考虑了分类模型的精确率和召回率 [14],我们将其作为变化类别的主要评价指标。

1、使用数据集LEVIR-CD、WHU-CD、DSIFN-CD,其中LEVIR-CD、DSIFN-CD数据集用于建筑物变化检测,WHU-CD数据集用于地震受灾区域的变化以及数年后的重建情况。

2、评价指标使用:精确率、召回率、交并比、总体准确率、F1分数

4.2 实现细节

翻译

所提 VcT 框架采用随机梯度下降(SGD)[71] 优化器进行端到端训练,学习率采用线性策略。模型训练 200 个 epoch,初始学习率为 0.01,批大小(batch size)为 8,权重衰减为 0.0005,动量为 0.99。通过测试不同的参数 K、L 和图神经网络(GNN)层数 N,对 RTM 模块进行微调,最终参数设置为 K=1000、L=10、N=1,同时采用 8 近邻图。在 Transformer 层中,多头自注意力(MSA)和多头锚点 – 主注意力(MAPA)的头数均设置为 8。模型采用 Python 语言基于 PyTorch [72] 工具包实现,并在配备 NVIDIA GeForce RTX 3090 GPU 的服务器上进行训练。

4.3 与最优模型的对比

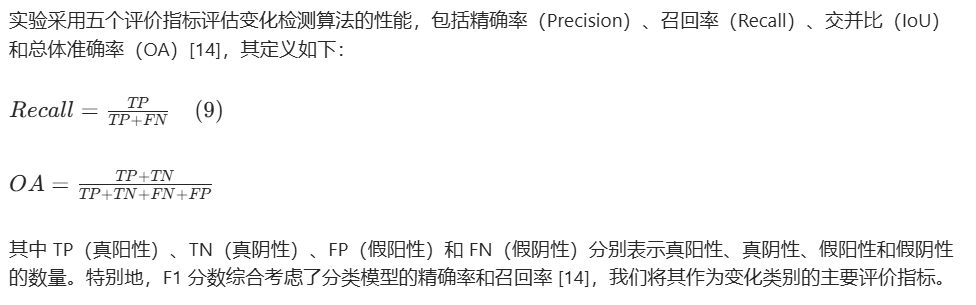

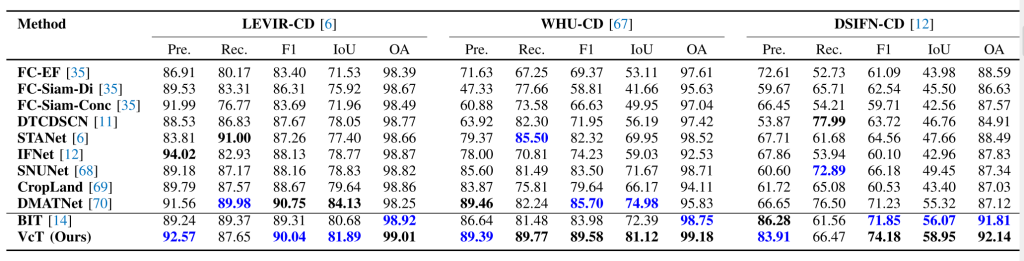

表 1 三种遥感图像变化检测数据集上与其他最优模型的对比结果。最优结果和次优结果分别用红色和蓝色标记。所有分数均以百分比(%)表示。

1、实验内容,对比VcT与主流的九种模型在LEVIR-CD、WHU-CD、DSIFN-CD三个数据集上的性能。

2、在LEVIR-CD数据集上,VcT模型表现全面领先

- F1分数达 90.04%,仅低于最优的DMATNet 90.75%不到1%;

- 总体准确率OA达到最优 99.01%

3、在WHU-CD数据集上,VcT 的优势更显著

- 总体准确率OA、F1分数、交并比IoU、召回率Rec均达到最优

- 精确率为次优,距最优的DMATNet的89.46%仅低不到0.1%

4、在DSIFN-CD数据集上,VcT的综合性能依然突出

- F1分数、IoU、总体准确率均达到最优

翻译

如前几节所述,我们在三个基准数据集上验证了所提方法的性能,并将其与 10 种最优变化检测模型进行对比,这些模型包括 FC-EF [35]、FC-Siam-Di [35]、FC-Siam-Conc [35]、DTCDSCN [11]、STANet [6]、IFNet [12]、SNUNet [68]、BIT [14]、CropLand [69] 和 DMATNet [70]。需要注意的是,前四种方法 [35] 基于纯 CNN 架构,其余六种模型基于 Transformer 架构。表 1 中报告的实验结果基于这些模型的源代码和默认参数实现,下文将对这些数据集的详细结果和分析进行介绍。

- LEVIR-CD 数据集 [6] 结果:由表 1 可知,基线方法 BIT [14] 在精确率、召回率、F1 分数、IoU 和 OA 指标上分别达到 89.24%、89.37%、89.31%、80.68% 和 98.92%;相比之下,所提 VcT 模型在这些指标上分别达到 92.57%、87.65%、90.04%、81.89% 和 99.01%,在大多数指标上均优于 BIT 模型。具体而言,VcT 在精确率、F1 分数、IoU 和 OA 上分别比 BIT 高出 2.76%、1.02%、1.7% 和 0.11%。这些实验结果表明,所提 VcT 框架在遥感图像变化检测任务中具有有效性。显然,所提框架的性能优于 DTCDSCN [11]、STANet [6]、IFNet [12]、SNUNet [68] 等其他基于 Transformer 的变化检测算法,充分证明了所提 VcT 模型的优势和优越性能。

- WHU-CD 数据集 [67] 结果:根据表 1 中报告的 WHU-CD 数据集结果,所提 VcT 模型在精确率 / 召回率 / F1 分数、IoU 和 OA 指标上分别达到 89.39%/89.77%/89.58%、81.12% 和 99.18%;而基线方法 BIT [14] 在这些指标上分别为 86.64%、81.48%、83.98%、72.39% 和 98.75%。VcT 模型的五个评价指标分别比 BIT 高出 2.75%、8.29%、5.6%、8.73% 和 0.43%。同时,我们的模型性能也优于其他变化检测算法。

- DSIFN-CD 数据集 [12] 结果:由表 1 可知,在该数据集上,所提 VcT 模型在多个指标上均优于基线方法 BIT [14]。具体而言,VcT 在召回率、F1 分数、IoU 和 OA 上分别比 BIT 高出 4.91%、2.33%、2.88% 和 0.33%。由于 DSIFN-CD 数据集具有一定挑战性,准确检测变化区域通常较为困难,因此对比方法的召回率普遍较低。尽管如此,所提 VcT 模型的性能仍优于 DTCDSCN [11]、STANet [6]、IFNet [12]、SNUNet [68]、CropLand [69]、DMATNet [70] 等其他基于 Transformer 的变化检测算法。

总体而言,这些实验充分证明了所提 VcT 模型在遥感图像变化检测任务中的有效性和优越性。

4.4 消融试验

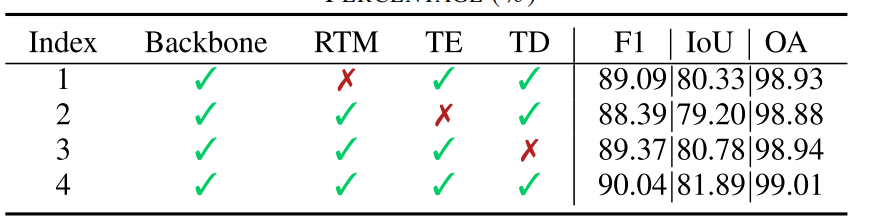

表 2 所提 VcT 模型核心组件在 LEVIR-CD 数据集上的消融实验结果。所有分数均以百分比(%)表示。

1、分别对比使用与不使用RTM、TE(Transformer编码器)、TD(Transformer解码器)进行实验并对比F1分数、交并比IoU、整体准确率OA指标进行对比,经过表中的结果,当三个模块一起使用的时候指标达到最优的一组。

表 3 所提 RTM 模块中 GNN 和 K 均值在 LEVIR-CD 数据集上的消融实验结果。所有分数均以百分比(%)表示。

1、这是在可靠性标记挖掘RTM模块上,验证图神经网络GNN与K均值的必要性,当两者共同使用时,实验指标到达最优的一组。

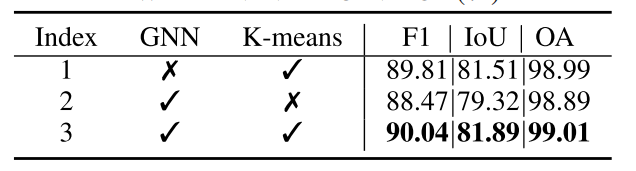

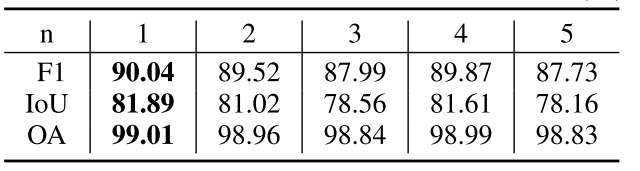

表 4 不同所选标记数量在 LEVIR-CD 数据集上的实验结果。所有分数均以百分比(%)表示。

1、实验验证超参数K,Top-K使用即标记数量大小的比较,当K设置为1000时,F1分数、交并比IoU、总体准确率OA达到最优的一组。

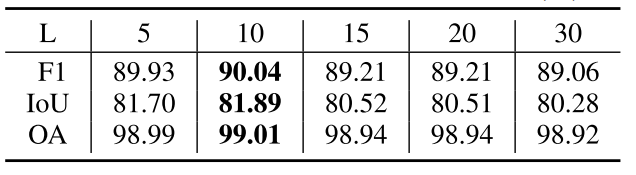

表 5 不同聚类数量在 LEVIR-CD 数据集上的实验结果。所有分数均以百分比(%)表示

1、实验验证超参数L,K-means使用即聚类数量大小的比较,当L设置为10时,F1分数、交并比IoU、总体准确率OA达到最优的一组。

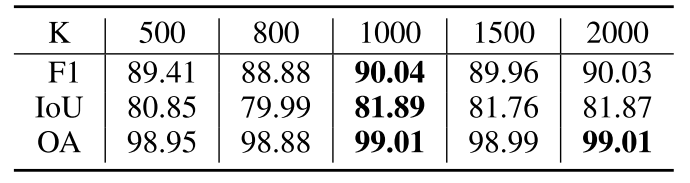

表 6 不同 GNN 层数在 LEVIR-CD 数据集上的实验结果。所有分数均以百分比(%)表示

1、图神经网络GNN层数的设置的实验,当层数设置为一层时,F1分数、交并比IoU、总体准确率OA达到最优的一组。

表 7 不同近邻数在 LEVIR-CD 数据集上的分析结果。所有分数均以百分比(%)表示。

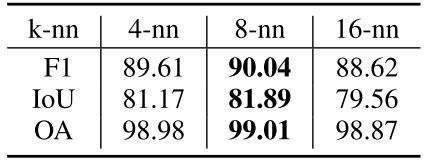

图 4 LEVIR 数据集上所选标记数量、K 均值聚类数量、GNN 层数以及不同近邻数的分析结果。(a)所选标记数量 K;(b)K 均值聚类数量 L;(c)GNN 层数 N;(d)近邻图 K。

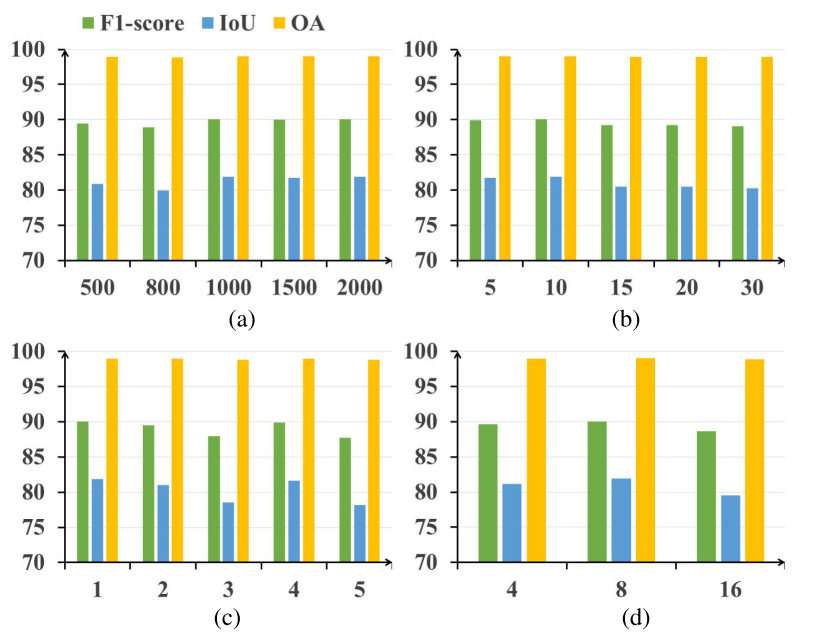

表 8 LEVIR-CD 数据集上的参数与运行效率对比。

1、Params、FLOPS分别是参数量与浮点运算,参数量越小、浮点运算越小,需要的GPU算力越少,运行效率越高。

翻译

本节通过消融实验,深入分析关键贡献部分的作用,包括不同组件分析、所选标记数量、聚类数量、GNN 层数、不同近邻数等。

不同组件分析:所提 VcT 模型包含四个主要模块,即共享骨干网络、RTM 模块、自注意力 / 交叉注意力模块以及 APA 模块。我们将自注意力 / 交叉注意力模块视为 TE,将 APA 模块视为 TD。如表 2 所示,我们通过逐步移除各个组件,在 LEVIR-CD 数据集上验证它们对最终检测结果的影响(从算法 1 到算法 4)。结果表明,当所有组件都使用时,模型性能最佳。具体而言,移除所提 RTM 模块后,VcT 模型的性能下降至 89.09%(F1 分数)、80.33%(IoU)和 98.93%(OA),这验证了 RTM 模块对所提 VcT 框架的有效性和重要性;此外,移除 TE 后,模型性能下降至 88.39%(F1 分数)、79.20%(IoU)和 98.98%(OA);移除 TD 后,模型性能下降至 89.37%(F1 分数)、80.78%(IoU)和 98.94%(OA)。这些结果证明了 Transformer 网络对所提 VcT 框架的有效性。总之,这些实验结果充分表明,每个关键组件都对 VcT 框架的性能有积极贡献。

GNN 和 K 均值消融实验:本节通过分析,帮助读者更好地理解 RTM 模块,并验证 GNN 层数和 K 均值的有效性。如表 3 所示,我们在 LEVIR-CD 数据集上分别移除 GNN 层和 K 均值,验证它们对最终检测结果的影响。结果表明,当所有组件都使用时,模型性能最佳。具体而言,将 RTM 模块中的 GNN 替换为 CNN 后,模型性能下降至 89.81%(F1 分数)、81.51%(IoU)和 98.99%(OA),这验证了 GNN 对所提 RTM 模块的有效性和重要性;此外,移除 K 均值模块后,模型性能下降至 88.47%(F1 分数)、79.32%(IoU)和 98.89%(OA)。这些结果证明了 GNN 和 K 均值在 RTM 模块中的有效性。

所选标记数量的影响:所选标记数量 K 在所提 RTM 模块中起着重要作用。当 K 过大时,变化区域会干扰公共区域的上下文建模;相反,当 K 过小时,公共区域的利用率较低,无法充分利用先验信息。本节通过测试不同的标记数量 K,寻找这两方面的平衡。如图 4(a)和表 4 所示,在 LEVIR 数据集上,将 K 设置为 500 至 2000 之间的不同值进行实验。结果表明,当 K=1000 时,模型取得最佳结果,因此将 K 设置为 1000。

聚类数量的影响:RTM 模块中采用 K 均值聚类算法。本节通过设置不同的聚类数量(如 L={5,10,15,20,30}),验证其对最终结果的影响。如图 4(b)和表 5 所示,结果表明模型性能对该参数不敏感,当聚类数量设置为 10 时,模型取得略好的结果,因此将聚类数量设置为 10。

不同 GNN 层数的影响:众所周知,GNN 层数过深可能会导致过平滑问题。为研究所提 VcT 框架中 GNN 层数的影响,在 LEVIR 数据集上,将 GNN 层数设置为 1 至 5 之间的不同值进行实验。如图 4(c)和表 6 所示,结果表明仅使用 1 层 GNN 时,模型性能最佳。

参数与运行效率:为更好地了解模型效率,本节报告了所提模型与其他五种最优方法的模型参数(Params.)和每秒浮点运算次数(FLOPs)。所有结果均在配备 Intel Xeon Silver 4314 CPU 和 GeForce RTX 3090 GPU 的服务器上测试得到。由表 8 可知,所提 VcT 模型的参数为 3.57M,而 DTCDSCN [11]、STANet [6]、IFNet [12]、SNUNet [68] 和 BIT [14] 的参数分别为 31.26M、16.89M、50.71M、12.03M 和 3.50M;此外,VcT 模型的 FLOPs 为 10.64G,而 DTCDSCN、STANet、IFNet、SNUNet 和 BIT 的 FLOPs 分别为 7.21G、6.58G、41.18G、27.44G 和 10.63G。显然,所提模型的复杂度和效率与基线方法 BIT 相当,且明显优于其他部分对比方法。

4.5 可视化结果

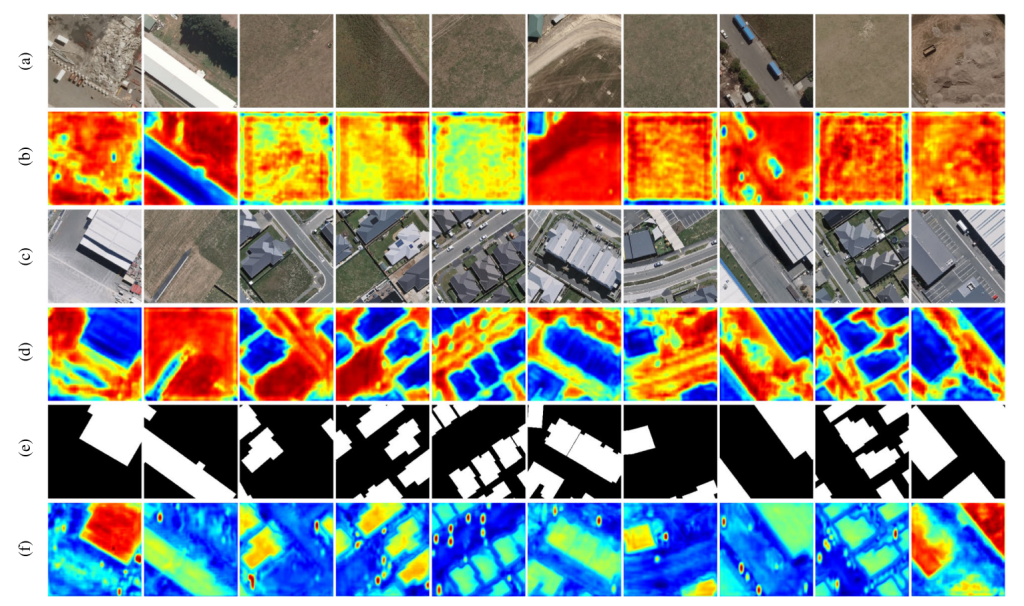

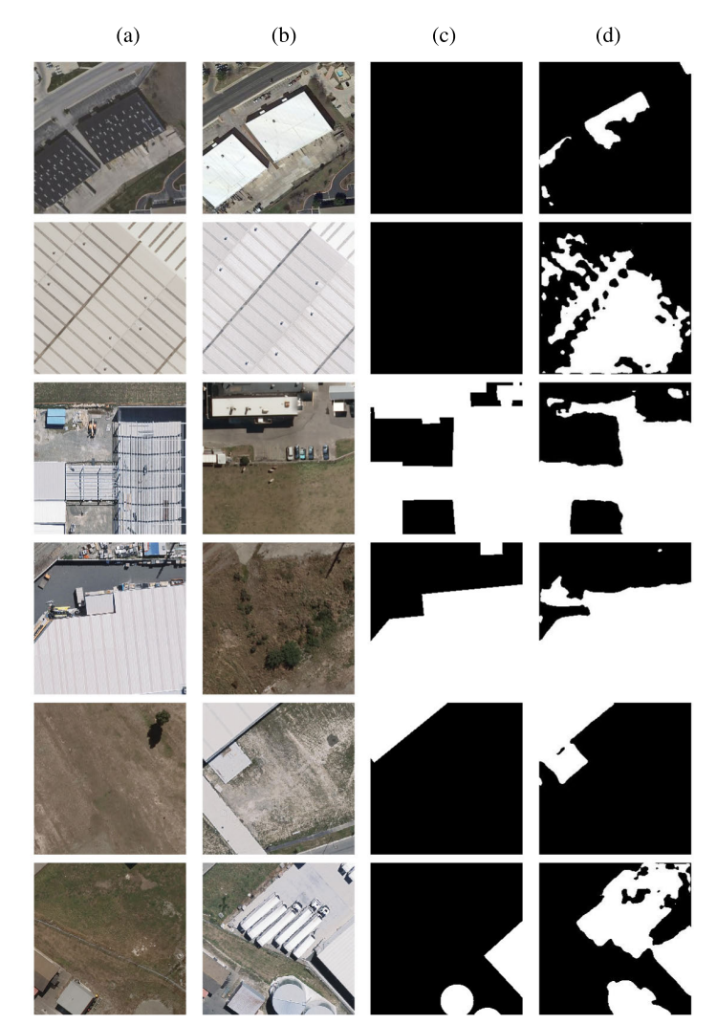

图 5 WHU-CD 测试集上的特征图可视化示例。红色和蓝色分别表示较高和较低的注意力值。(a)图像 A;(b)图像 A 的差异特征图;(c)图像 B;(d)图像 B 的差异特征图;(e)ground truth;(f)差异图像。

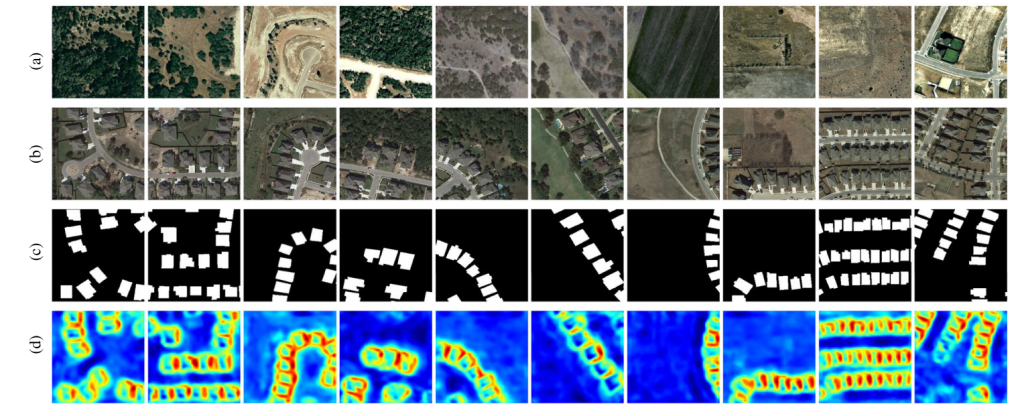

图 6 LEVIR-CD 测试集上代表性粗糙变化图的可视化结果。(a)图像 A;(b)图像 B;(c)ground truth;(d)粗糙变化图。

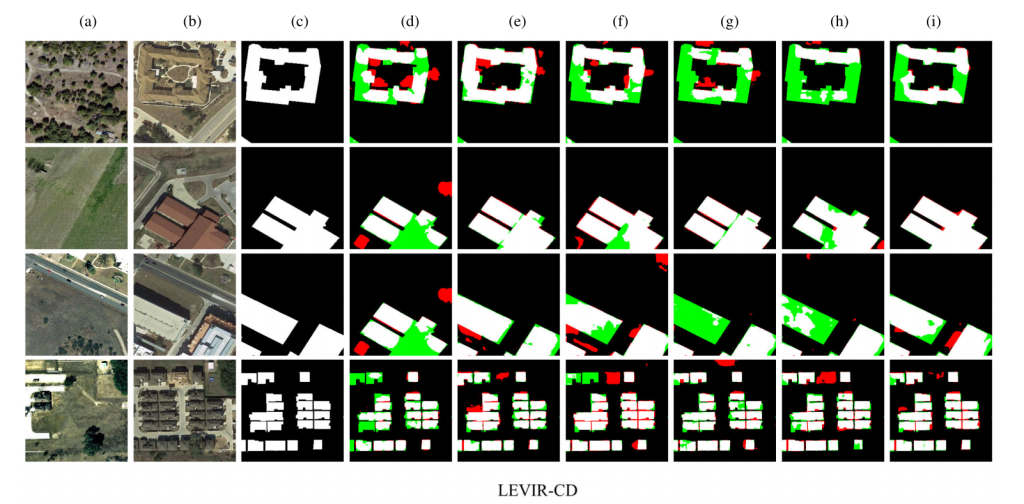

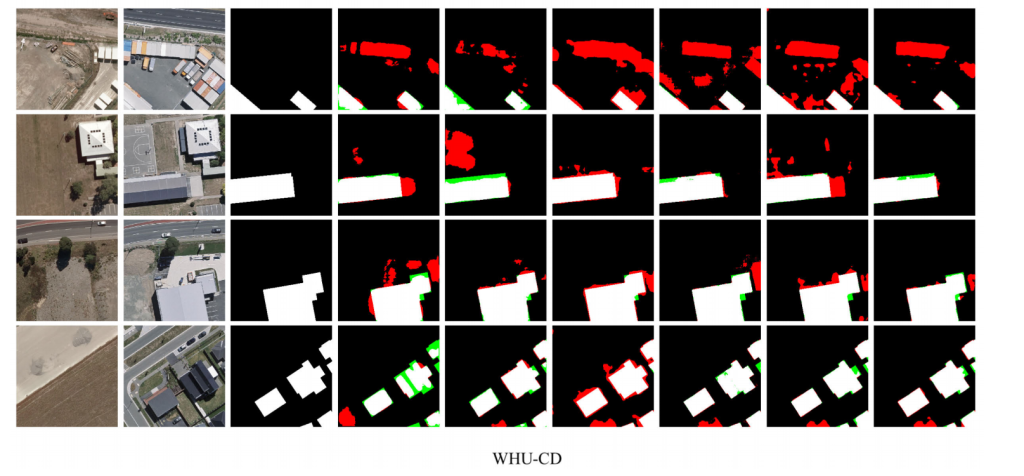

图 7 所提 VcT 模型与其他最优模型的变化检测结果可视化。(a)图像 A;(b)图像 B;(c)ground truth;(d)FC-Siam-Conc;(e)DTCDSCN;(f)STANet;(g)SNUNet;(h)BIT;(i)VcT。

翻译

除上述定量分析外,本节还通过一些直观示例,从定性分析的角度帮助读者更好地理解所提模型。具体而言,对特征图、粗糙变化图和最终检测结果进行了可视化。

特征图:如图 5 所示,给定输入图像 A(a)和图像 B(c),所提 RTM 模块选择公共不变背景区域进行融合。通过图 5(b)和图 5(d)(分别为增强特征图和原始特征图的差异特征图)可以看出,RTM 模块增强了背景表示,并消除了无关变化。因此,采用所提模型能够检测出质量更高的变化图,如图 5(f)所示。

粗糙变化图:如图 6 所示,对部分代表性样本的粗糙变化图进行了可视化。结果表明,所提 RTM 模块能够初步大致捕捉公共不变区域,从而得到更准确的粗糙变化图。

检测结果:除特征图可视化外,还对比展示了所提 VcT 模型与其他最优模型的变化区域检测结果。为便于可视化,采用不同颜色表示 TP(白色)、TN(黑色)、FP(红色)和 FN(绿色)。具体而言,如图 7 所示,(a)-(c)列分别表示输入图像 A、输入图像 B 和 ground truth 图;(d)-(h)列表示其他对比方法的变化检测结果,这些结果明显劣于所提 VcT 模型的检测结果(i 列)。这充分证明了所提 VcT 模型在遥感图像变化检测中的优势。

4.6 局限性分析

图 8 所提 VcT 模型的检测结果局限性示例。(a)图像 A;(b)图像 B;(c)ground truth;(d)VcT 检测结果。

翻译

尽管所提 VcT 模型在现有遥感图像变化检测数据集上取得了良好性能,但仍可从以下方面进行改进:一方面,RTM 模块中的 Top-K 标记选择在常规场景下效果良好,但当变化区域处于极端情况(如变化区域过多或完全无变化区域)时,固定的标记选择策略可能只能得到次优结果。在图 8(第 1-4 行)中可看到一些失败案例,如果能够自适应调整所选标记数量,这些问题可能会得到很好的解决。另一方面,我们发现许多非建筑物区域(如车辆)发生了变化,且检测器确实能够检测到这些区域,但在标注 ground truth 标签时,这些数据集仅关注建筑物变化检测,而忽略了其他类型的变化。直观而言,如果对所有变化都进行标注,所提方法的检测准确率可能会更高,如图 8(第 5-6 行)所示。

此外,在语义信息辅助方面,可利用一些大规模基础模型 [61],例如 Grounding DINO [74] 和分割一切模型(SAM)[75]。例如,在特定建筑物检测数据集的情况下,可利用预训练大规模模型,通过文本提示对建筑物区域进行分割。这种方法能使模型仅关注感兴趣区域内的变化检测,而忽略树木、车辆等无关的临时变化。然而,需要注意的是,遥感图像与自然图像之间可能存在域差距,这可能导致分割结果不理想。因此,在这方面仍需进一步的实验探索,我们将其作为未来的研究方向。

5 结论

翻译

本文提出一种新型遥感图像变化检测框架,即视觉变化 Transformer(VcT)。该框架主要由三个模块组成,即 RTM 模块、Transformer 模块和预测头。两幅输入图像共享骨干网络,以生成初始 CNN 特征;然后,通过构建结构化图和 Top-K 标记选择,生成粗糙变化图,并采用由粗到细的 K 均值聚类方法,挖掘多样且准确的标记;接着,利用 Transformer 层进一步增强标记间的图像内和图像间关联;同时,采用 APA 模块实现增强特征与原始特征之间的交叉融合;最后,利用预测头将特征转换为像素级变化检测图。在三个数据集上开展的大量实验,验证了所提 VcT 模型的有效性和优势。

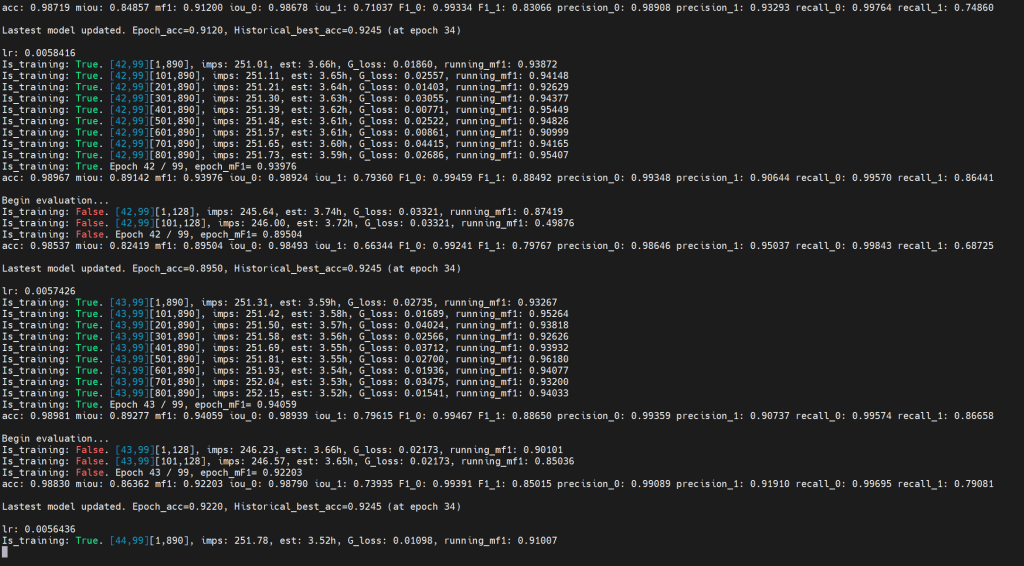

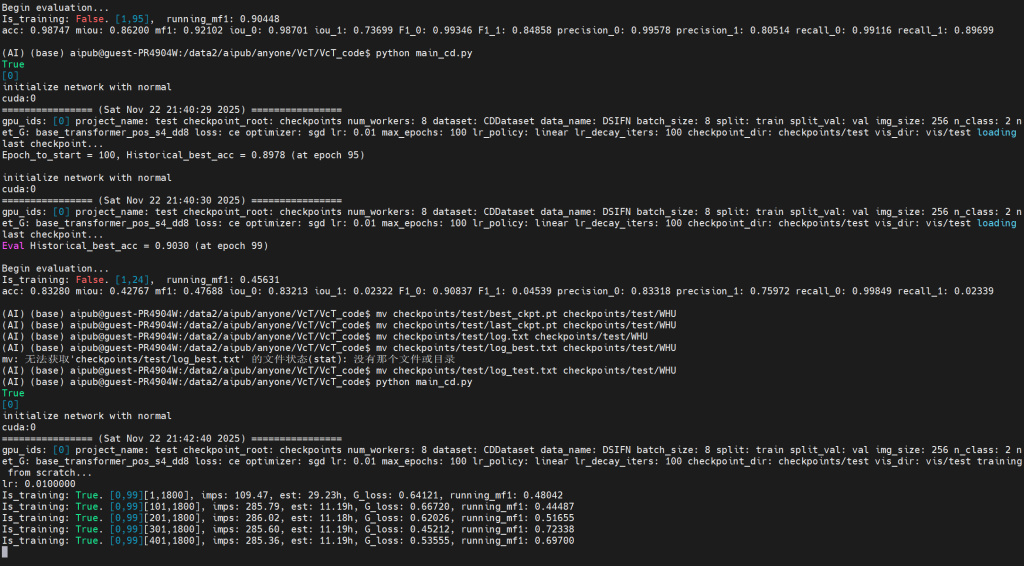

模型训练情况

先后使用LEVIR-CD、DSINF-CD、WHU-CD数据集进行训练

截止2025.11.22 上午11:00:使用LEVIR-CD数据集训练到50轮,发现一个问题,保存模型的时候,是直接将最优的一个模型替换掉次优的,同时保存最后一轮训练的模型(每轮训练结束之后都会覆盖保存),但是好像并没有区分是哪个数据集训练完成后的模型,这一点等我验证完第一个数据集之后再观察一下吧。

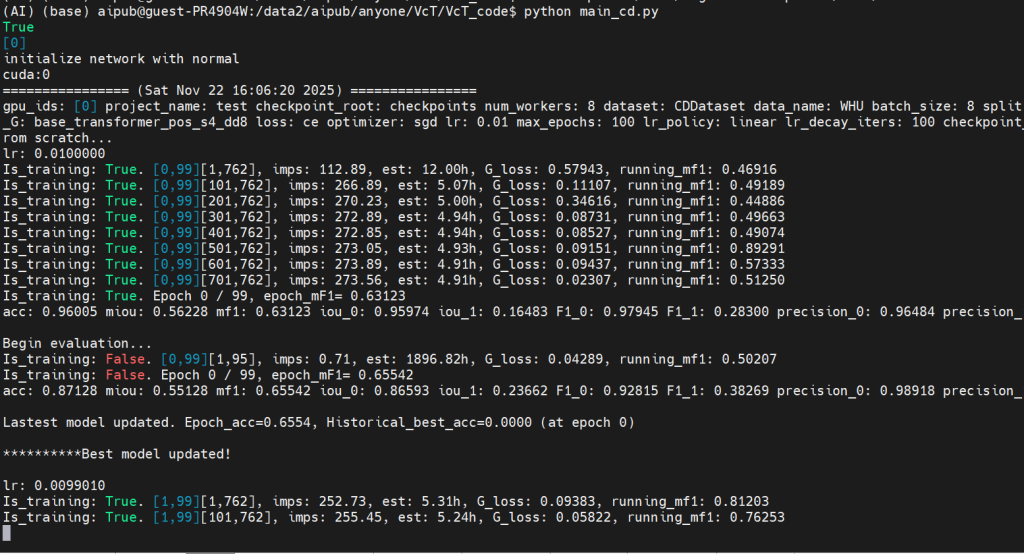

截止2025.11.22 下午15:00使用LEVIR数据集训练完成,训练时间:上午8:30~下午15:00,在验证集上的指标如下:

然后开始用WHU数据集训练

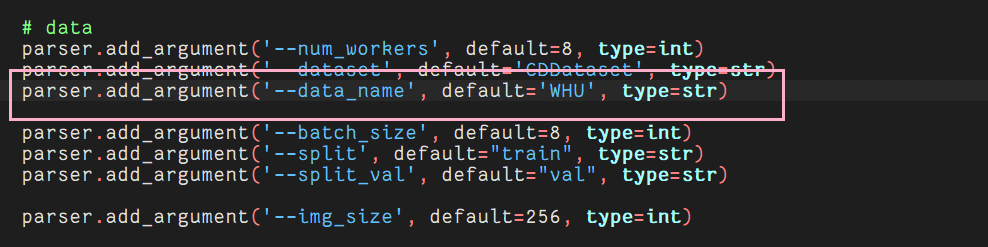

需要注意的是,即前面提到的,源码没有区分具体是哪个数据集训练出的模型,仅在模型训练py文件即main_cd.py文件中修改数据集使用,代码仍会读取保存的模型权重,同时读取到训练的轮次,在权重轮数的基础上继续训练,但当轮数超过96时(上个数据集训练了100轮)会直接跳出训练模式进入模型评估模式,因此若要继续使用不同的数据集进行训练,可以手动将保存的模型文件夹转移到其他文件夹下,如在同一文件夹下创建一个LEVIR文件夹,将各种相关的文件存入其中,如下:

截止2025.11.22 下午16:10,开始使用WHU数据集进行训练

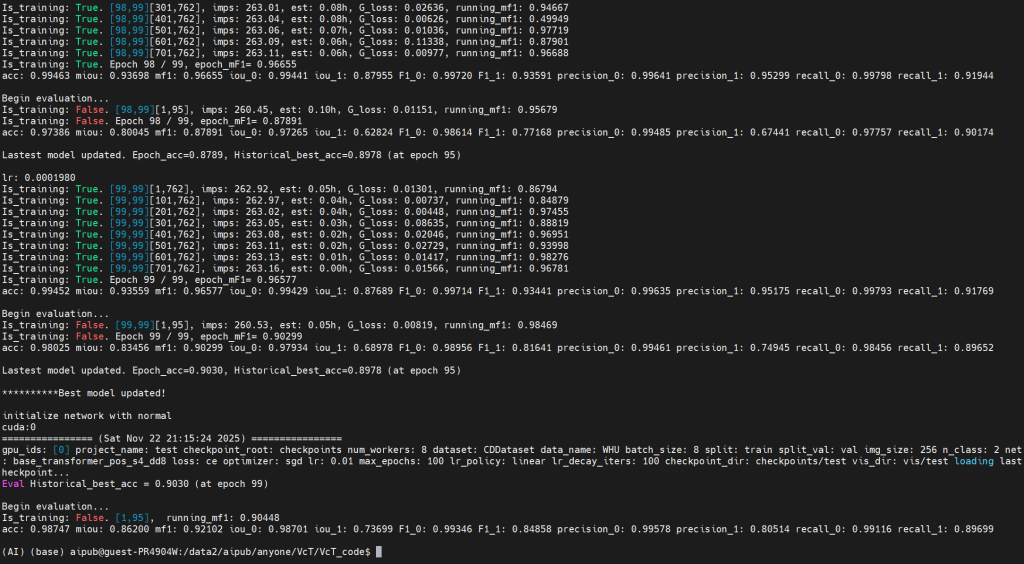

截止2025.11.22 晚上21:36,使用WHU数据集训练VcT完成

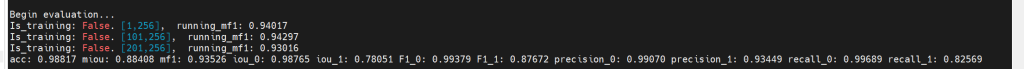

然后调整eval_cd.py文件中data区域的参数设置,在WHU测试集上验证模型的性能。如下验证的性能。

截止2025.11.22 晚22:44开始训练

截止2025.11.23 早上7:56继续从第19轮开始训练

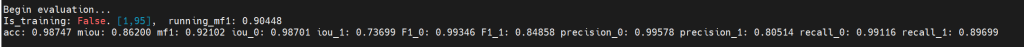

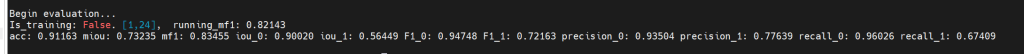

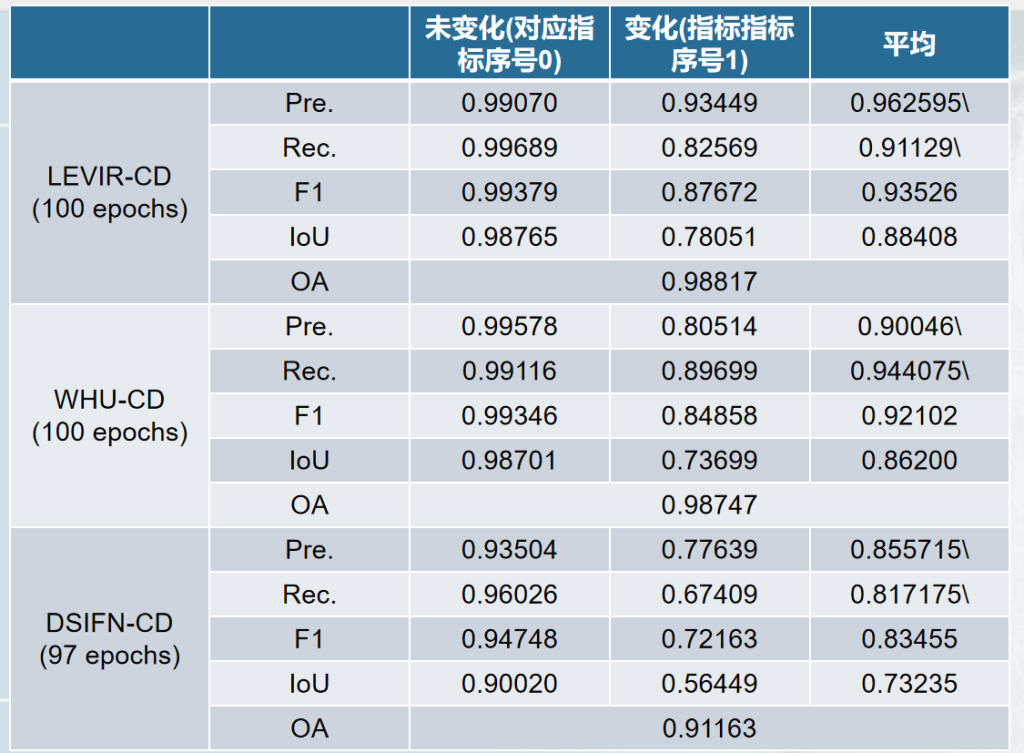

验证的结果

整理在三个数据集验证集上的结果如下:

与实验结果对比,基本都是在三个数据集上,指标整体准确率OA较低,其他指标都高于实验中的结果。

又看了一下对应的GitHub仓库,截止最新更新日期 2024.6.25日 期间没看见对代码文件更新的字样。