MCKTNet:面向遥感图像语义分割的多尺度跨模态知识迁移网络

开源代码发布网址(暂时未发布源码)

发布日期2025.3.4 发布期刊IEEE TGRS

0 摘要

翻译

多模态数据融合能够为遥感图像分割提供有价值且丰富多样的信息。然而,不同模态数据具有不同的特征分布,这使得跨模态特征融合过程中存在冲突与冗余问题。此外,现有多模态融合网络通常采用双分支结构,存在参数数量多、计算成本高的问题。为解决这些问题,本文提出一种用于遥感图像语义分割的多尺度跨模态知识迁移网络(MCKTNet)。首先,采用结合通道离散损失与空间离散损失的跨模态迁移学习方法,促进几何特征与语义特征的跨模态迁移,并通过最小化特征分布差异减少冗余;其次,利用极化跨自注意力机制,在空间和通道维度上建立不同模态特征间的长距离关联,仅需新增少量参数即可实现跨模态特征的互补融合;最后,为精准捕捉目标边缘,提出多尺度边缘感知模块,在像素级优化预测结果中的边缘细节。大量实验表明,该方法有效、稳健且泛化能力强,在多个遥感图像语义分割任务中均达到当前最优性能,且参数数量仅为 1351 万。相关代码将在https://github.com/NUAALISILab/MCKTNet 开源。

1、多模态数据融合能够为遥感图像分割提供有价值且丰富多样的信息。(动机)

- 1)不同模态数据具有不同的特征分布,这使得跨模态特征融合过程中存在冲突与冗余问题。

- 2)现有多模态融合网络通常采用双分支结构,存在参数数量多、计算成本高的问题。

2、(成果)本文提出一种用于遥感图像语义分割的多尺度跨模态知识迁移网络(MCKTNet),关键设计有:

- 1)采用结合通道离散损失与空间离散损失的跨模态迁移学习方法,促进几何特征与语义特征的跨模态迁移,并通过最小化特征分布差异减少冗余

- 2)利用极化跨自注意力机制,在空间和通道维度上建立不同模态特征间的长距离关联,仅需新增少量参数即可实现跨模态特征的互补融合

- 3)为精准捕捉目标边缘,提出多尺度边缘感知模块,在像素级优化预测结果中的边缘细节。

3、(实验结果)大量实验表明,该方法有效、稳健且泛化能力强,在多个遥感图像语义分割任务中均达到当前最优性能,且参数数量仅为 1351 万。

1 引言

翻译

遥感图像语义分割,又称土地覆盖分类,旨在通过像素级定位,将遥感图像中的每个像素划分为指定类别 [1]。该技术在城市规划 [2][3]、智慧城市 [4][5]、地理信息系统构建 [6] 等众多遥感应用中发挥着关键作用。从易用性角度出发,多数方法采用单模态数据进行分割,但由于信息单一,在复杂场景中难以取得理想效果。多模态数据能够从不同视角提供更丰富的信息,在复杂场景和高精度分割任务中展现出显著潜力,为解决遥感图像分割问题提供了新途径。

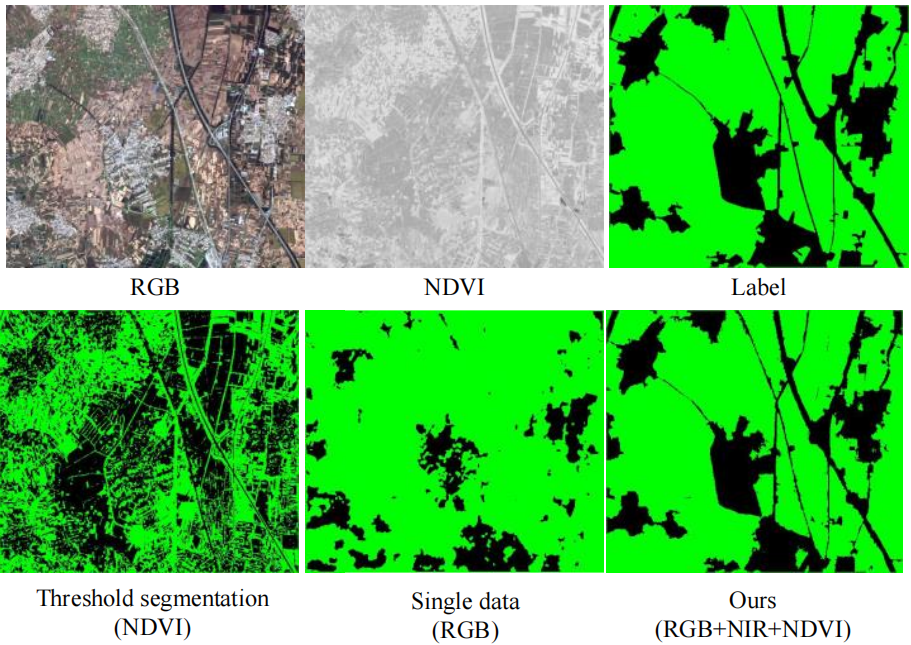

融合多模态数据实现遥感图像语义分割,可充分利用不同数据类型的互补特征,获取更全面、丰富的语义信息,进而提升语义分割的准确性与可靠性 [7]。以图 1 为例,受光照、季节、作物品种等因素影响,多光谱图像中农田区域的特征分布可能存在显著差异,有时甚至与池塘特征高度相似,仅依靠多光谱图像难以有效区分二者。而从归一化植被指数(NDVI)中提取有效特征,并与多光谱图像中的丰富纹理特征相结合,可提升复杂场景下植被检测模型的性能。因此,如何从不同模态中有效提取互补信息,获得比单一数据源更丰富的特征,已成为遥感数据处理领域的新技术挑战。

高效的特征表示有助于提升类别信息的判别能力 [8]。充分挖掘不同数据源的互补特征与判别特征,构建多源分割模型的特征空间,是实现多模态遥感图像高精度分割结果的关键。

为提取多模态数据间的互补特征,现有模型尝试在特征融合过程中引入注意力机制 [9] 或门控机制 [10][11] 进行信息筛选,但这些方法多关注不同模态特征间的相关性,却忽略了其固有数据分布差异对融合效果的影响。研究表明,不同传感器生成的多模态数据具有显著不同的特征,例如跨模态异质性、统计特性差异及噪声水平差异,且随着不同模态数据间特征分布差异的增大,特征融合效果会随之下降 [33]。与普通场景图像(如车辆、行人)的语义分割任务不同,遥感图像目标(如水体、植被等)往往缺乏统一的边界特征;此外,下采样和多模态特征融合过程均可能导致低层特征中空间细节信息丢失,造成目标边缘部分分割不准确。同时,多模态融合模型需采用双分支架构进行多模态特征提取,导致模型参数数量庞大、计算复杂,阻碍了其部署与实际应用。

针对上述问题,本文提出一种用于遥感图像语义分割的多尺度跨模态知识迁移网络(MCKTNet)。设计跨模态迁移学习方法,实现不同模态数据间语义与几何特征的迁移,减少不同模态数据的特征分布差异;利用跨注意力机制实现跨模态特征的互补融合;为获得更精准的目标边缘,设计多尺度边缘感知优化模块,指导模型从像素级预测结果中直接优化边缘细节。MCKTNet 采用轻量级网络框架,通过知识迁移缓解不同模态间的数据分布差异,借助语义与几何信息的双向迁移减少模态间冗余。与传统基于师生网络的跨模态知识蒸馏方法不同,该方法无需预训练教师模型或网络组件,而是通过同步双向知识迁移直接增强骨干网络的特征表示能力。本文的主要贡献如下:(1)设计基于跨模态知识迁移的多模态融合方法,创新性地采用通道离散损失模块与空间离散损失模块,促进不同模态数据间几何特征与语义特征的迁移,减少各模态间冗余;(2)提出高效的多模态跨自注意力机制,实现不同模态路径交互向量间的充分信息交换;(3)设计多尺度边缘优化模块,从像素级分割预测结果中直接提取边缘信息,在不增加额外参数与计算量的前提下优化预测结果,缓解低维特征信息丢失问题,增强边缘语义特征。

在不同数据集上的实验结果验证了所提 MCKTNet 对不同模态数据的优异融合能力。与其他当前最优方法相比,MCKTNet 能高效整合不同先验知识,在建筑物、植被、水体等单类别分割任务中均实现最高精度。

本文其余部分结构如下:第二部分首先综述遥感分割、模态融合及知识蒸馏方法的相关研究;第三部分详细介绍 MCKTNet 的网络结构;第四部分阐述所开展的大量实验;最后在第五部分给出结论。

2 相关工作

2.1 遥感图像语义分割

翻译

随着卷积神经网络在计算机视觉任务中取得突破性成果,越来越多研究者开始关注基于深度学习的遥感图像语义分割技术。Xu 等人 [12] 提出轻量级双注意力模块获取图像级上下文信息,并设计特征增强特征金字塔模块,以并行结构利用局部级和图像级上下文信息;为解决类内差异问题,Zhang 等人 [13] 基于 HRNet,在高分辨率分支中聚合局部级上下文信息,在低分辨率分支中获取图像级上下文信息;Dong 等人 [14] 提出 DenseUNet 用于城市遥感图像中的小目标语义分割,该网络通过级联操作连接 CNN 特征,融合浅层细节特征与深层抽象语义特征;Ma 等人 [15] 提出基于前景激活驱动的高分辨率遥感图像(HRS)小目标语义分割框架;Li 等人 [16] 提出多注意力网络,通过多个注意力模块提取上下文依赖关系,以利用多尺度信息。此外,为实现不同类别边缘区域的精准区分,Wang 等人 [49] 提出基于自监督学习(SSL)的关键特征修复网络(KFRNet),通过计算补丁相似度识别并掩盖显著特征以进行修复,并引入图像比较分支,通过正负样本对比获取类别特征,从而提升分割精度;Li 等人 [50] 提出一种新型边界增强双流网络(BEDSN),通过高度耦合的编码器和特征提取器,将边缘检测分支流(EDBS)与复合损失函数、语义分割分支流(SSBS)相结合,并利用多尺度特征提取和混合空洞卷积模块增强 SSBS 性能。尽管这些方法均取得了较好效果,但它们均基于单源输入,在不同场景下稳定性不足,难以进一步提升性能。

2.2 遥感分割中的模态融合

翻译

近年来研究表明,多源特征(如高光谱图像(HSI)、多光谱图像(MSI)、近红外图像(NIR)、激光雷达(LiDAR)数据等)能有效提升场景解析的稳健性 [10][11][17]。其中,编码器 – 解码器架构在多模态数据融合中表现出显著有效性。根据融合发生的阶段,这类编码器 – 解码器方法可分为数据级融合、中间级融合和后期融合三类。

数据级融合方法将红、绿、蓝、近红外等光谱信息与数字表面模型(DSM)等结构信息结合,作为网络输入。例如,ResUNet-a 在将数据输入编码器前,先在数据级对 RGB 图像和 DSM 图像进行直接拼接 [18]。

中间级融合方法则将光谱信息和结构信息分别输入为各模态设计的相同编码器,在跨模态过程中,通过拼接操作或按元素求和,在不同尺度上融合两个编码器的横向特征。例如,Zhou 等人 [19] 提出门控机制,过滤多模态数据中的冗余信息,并利用模态间相似度提取互补信息以进行特征融合。

后期融合方法 [20] 将不同数据源输入两条独立的编码器 – 解码器网络路径,在最终阶段融合预测类别。当前先进的多模态融合方法多关注不同模态特征间的相关性,却忽略了其固有数据分布差异对融合效果的影响。为减少跨模态数据的分布差异,Yang 等人 [51] 提出一种融合分层特征聚合与跨模态特征对齐的多模态融合方法,用于解决遥感图像 caption(RSIC)任务中的特征表示与对齐问题,但该方法仅依靠跨模态特征对齐损失最小化特征分布差异,未考虑不同数据类型的固有特性,导致跨模态数据特征利用不充分。

1、多源特征能有效提升场景解析的稳健性,其中,编码器-解码器架构在多模态数据融合中表现出显著有效性。

2.3 知识蒸馏

翻译

知识蒸馏(KD)为实现高分割性能的轻量级模型提供了新思路,其核心是从大型复杂的教师网络中提取特定知识,并迁移到轻量级的学生网络中。Hinton 等人 [21] 首次提出知识蒸馏方法,通过在最终预测层对目标进行高效软化,提升小型网络的分割性能;随后,Adriana 等人 [22] 在此基础上提出对中间特征进行知识迁移;此后,越来越多的知识蒸馏方案被提出,大致可分为基于关系的 [23]、基于响应的 [24] 和基于特征的 [25] 三类。Chen 等人 [26] 首次提出 “从过去学习” 的概念,在蒸馏过程中不断将先前的特征信息加入 “回顾” 环节,以提升特征间的相关性;Feng 等人 [27] 利用残差注意力机制,在像素级和类别级维度捕捉师生网络间的相似度;Yang 等人 [28] 利用特征图上的全局语义关系,将结构化知识从教师模型迁移到学生模型;Zhang 等人 [29] 提出类间距离蒸馏方案,认为类间关系的准确性对分割性能至关重要。

这些方法均需先训练教师网络模型,再训练学生网络以最大限度逼近教师网络,对教师网络性能要求较高,且仅能进行单向的固定模型学习,无法充分学习跨模态特征。

3 方法原理

3.1 架构概述

翻译

本文提出轻量级多尺度跨模态知识迁移网络(MCKTNet),通过跨模态知识迁移和跨自注意力机制实现多模态数据的有效融合。

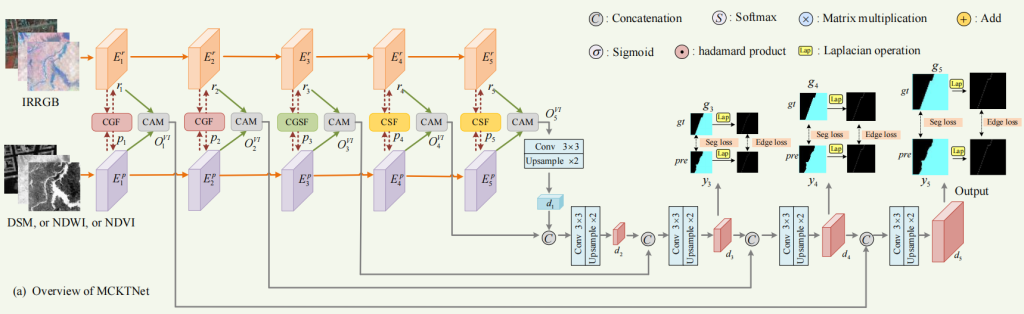

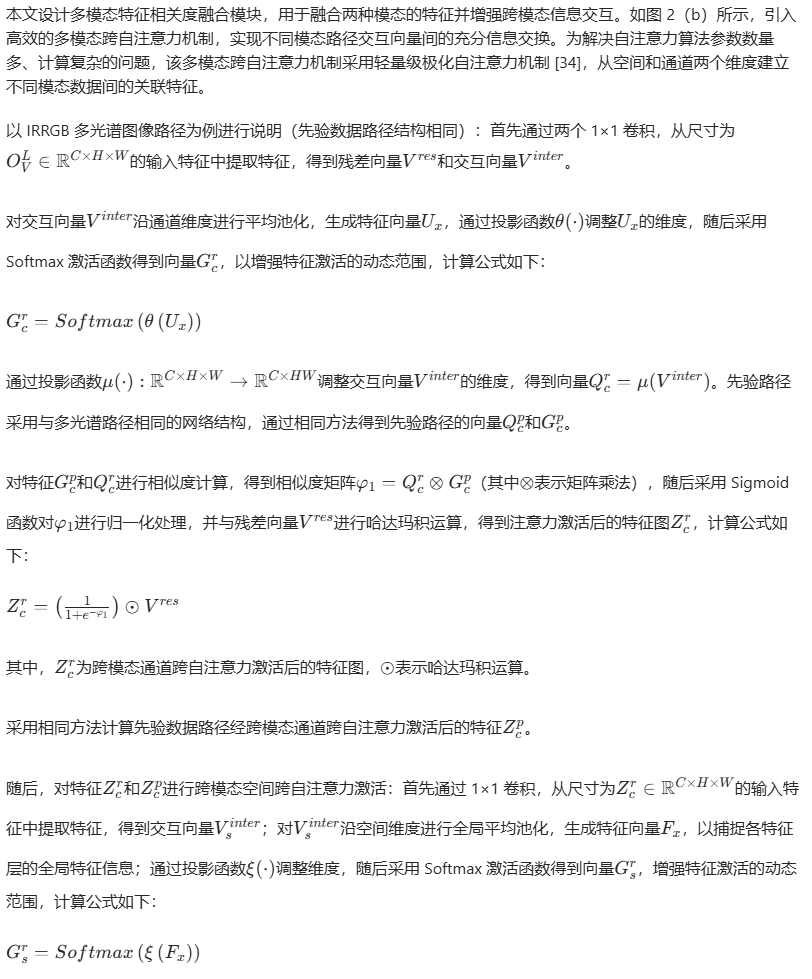

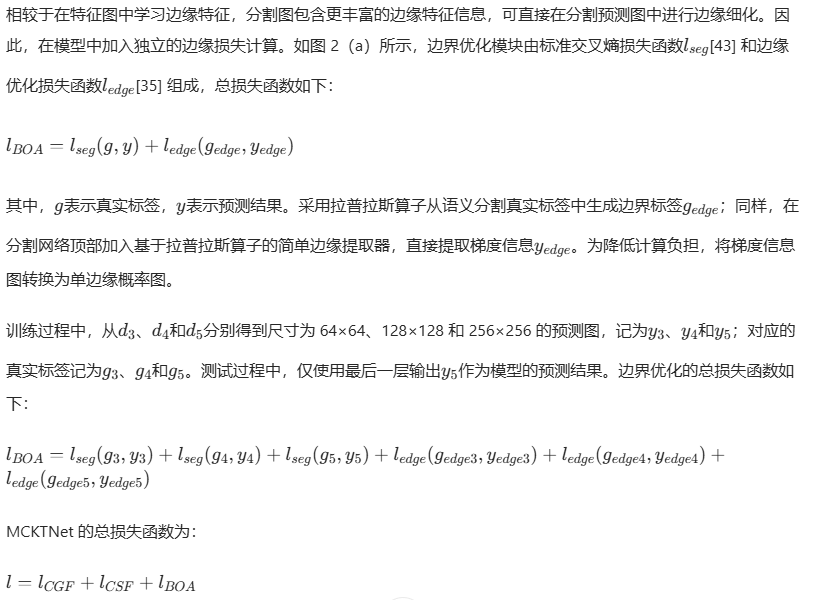

MCKTNet 的整体架构如图 2(a)所示,采用典型的编码器 – 解码器结构。在编码器部分,为使在 ImageNet 数据集上预训练的 MobileNetV2 [30] 适配遥感图像语义分割任务,移除骨干网络的全局平均池化层和最后一个全连接层,得到 5 个不同维度的输出特征图,尺寸分别为 16×128×128、24×64×64、32×32×32、96×16×16 和 320×8×8(通道数 × 高度 × 宽度)。对于这 5 个输出,IRRGB 路径和先验数据路径分别用Rs和Pa表示(其中(a=1,2,3,4,5))。如图 3 所示,跨模态几何语义特征迁移模块(CGSF)在测试阶段无需额外计算,即可利用不同模态数据的互补性实现语义与几何信息的交换。此外,MCKTNet 在解码器d3、d4和d5中引入边界优化算法,在不增加额外参数和计算量的前提下,弥补轻量级骨干网络在空间维度的局限性。

图 2:用于多模态语义分割的 MCKTNet 整体架构

输入数据为一幅 IRRGB 图像与另一模态数据(例如数字表面模型(DSM)、归一化差异水体指数(NDWI)、归一化差异植被指数(NDVI))。

图中包含MCKTNet网络架构与损失函数设计

MCKTNet网络架构包括进行特征提取的编码器分支、跨模态特征交互、特征上采样与融合的解码器分支

- 特征提取的编码器分支包含两个分支,其中一个为遥感RGB图像分支,对IRRGB图像进行特征提取,每一层编码器输出特征图,辅助模态分支即另一个模态数据的输入,对DSM、NDWI或NDVI等辅助数据进行特征提取,每层编码器输出特征图

- 跨模态特征交互1)CCF跨模态通道融合模块:在编码器早期即前两层,对RGB的特征与辅助信息的特征pi进行通道维度的融合,输出ri、pi融合后的中间特征。2)CGSF跨模态全局语义融合模块:在特征提取的中间阶段,对编码器输出的特征进行全局语义的跨模态交换。3)CSF跨模态语义融合模块:在编码器特征提取后期,对编码器输出的特征进一步强化语义层面的模态融合。4)CAM跨模态交叉自注意力模块,输出的是聚合了跨模态互补信息的特征图。

- 特征上采样与融合的解码器分支解码器通过上3×3卷积和两个上采样逐步恢复特征分辨率,并融合多尺度特征:从最深层的特征开始,通过卷积+上采样操作逐步生成特征,最终输出分割结果,在每次卷积+上采样操作之后,通过残差连接与CAM输出的聚合了多模态互补信息的特征进行融合。

损失函数设计网络在多尺度特征图上引入损失函数,同时关注分割结果和边缘细节

- 对三个尺度的特征图y1、y2、y3,分别计算分割损失和边缘损失,再综合所有尺度的损失指导网络训练。

- 边缘损失通过Laplacian 操作(∇²,拉普拉斯算子)提取边缘信息,确保分割结果的边缘清晰度。

在编码器部分,以预训练的MobileNetV2为骨干网络(移除全局平均池化和最后的全连接层),输出5个不同尺度的特征图,分别对应IRRGB多光谱图像数据与先验数据路径的特征表达,同时嵌入跨模态几何语义特征迁移模块CGSF,该模块进一步分为浅层使用的跨模态几何特征迁移子模块CGF与深层使用的跨模态语义特征迁移子模块CSF,前者通过余弦相似度计算自适应因子并结合MSE损失实现几何特征迁移,后者通过通道级余弦相似度与KL散度损失完成语义特征迁移,以此缩小不同模态特征分布差异、降低数据冗余;编码器输出的特征经过CGSF模块处理后与当前特征进行融合后再次输入到多模态交叉自注意力模块CAM,该模块基于极化自注意力机制,先通过 1×1 卷积生成残差向量与交互向量,再分别从通道维度(通过平均池化、Softmax 激活计算注意力权重)和空间维度(通过全局平均池化捕捉全局特征)建立跨模态特征关联,通过矩阵乘法与 Hadamard 乘积实现特征激活,最终输出互补融合后的特征;在解码器部分,针对三个尺度的特征图引入边界优化算法,结合交叉熵损失与边缘优化损失,在像素级直接优化分割结果的边缘细节,同时仅以解码器最后一层输出作为最终预测。

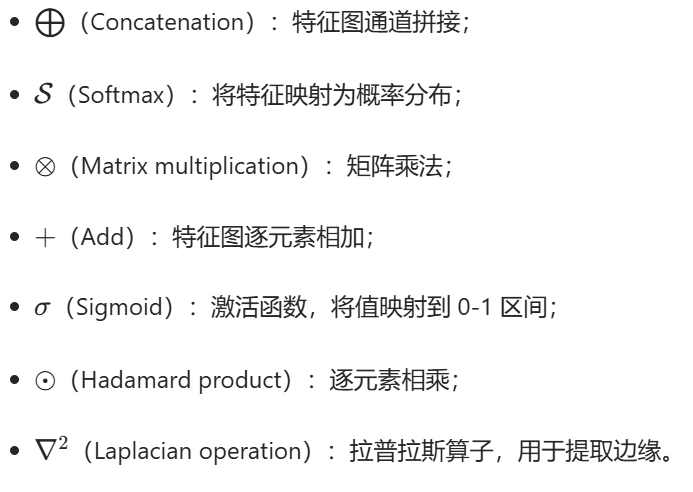

符号说明

3.2 跨模态几何语义特征迁移模块 CGSF

翻译

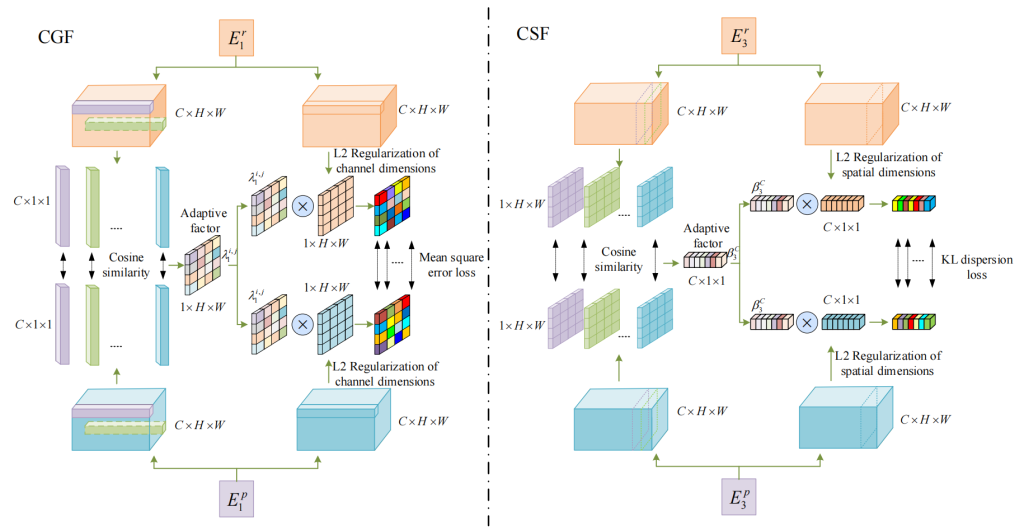

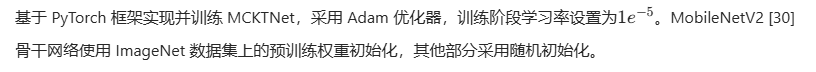

CGSF 模块可有效实现不同模态数据间的特征交换,缩小不同模态的数据分布差异,减少跨模态融合过程中的数据冗余问题。该模块分为跨模态几何特征迁移子模块(CGF)和跨模态语义特征迁移子模块(CSF)两类结构,分别用于纹理特征和语义特征的融合。

图 3:跨模态几何语义特征迁移模块(CGSF)的详细架构

该模块包含跨模态几何特征迁移子模块(CGF)与跨模态语义特征迁移子模块(CSF)。

跨模态几何意义特征迁移模块CGSF分为两个子模块:跨模态几何特征迁移模块CGF与跨模态语义特征迁移模块CSF

- 跨模态几何特征迁移模块CGFCGF聚焦于通道维度的跨模态特征交互,输入是两个模态的编码器特征。1)特征降维与相似度计算:对两个输入的特征分别进行1×1卷积降维,得到多个C×1×1的特征向量即几何级描述子,计算两组特征向量的余弦相似度生成自适应因子,衡量通道维度的特征相关性;2)自适应因子生成与特征加权:基于余弦相似度生成自适应因子用于对原特征的通道维度加权,对原特征进行通道维度的L2正则化(L2 Regularization of channel dimensions),增强特征的稳定性;3)损失函数约束:对加权后的特征计算均方误差损失(Mean square error loss),通过损失反向传播优化跨模态通道融合的效果,确保融合后的特征在通道维度上的一致性。

- 跨模态语义特征迁移模块CSFCSF聚焦于几何与语义维度的跨模态特征交互,输入的是两个模态的编码器特征。1)特征降维与相似度计算:对两个输入特征分别进行空间维度重塑,将C×H×W转换成1×H×W,聚焦于空间语义信息,得到空间级描述子,然后计算这些描述子的余弦相似度,衡量空间语义的相关性。2)自适应因子生成与特征加权:基于余弦相似度生成的自适应因子,用于对原特征的空间维度进行加权,对原特征进行空间维度的L2正则化(L2 Regularization of channel dimensions),增强空间语义特征的稳定性;3)损失函数约束:对加权后的特征计算KL散度损失,通过KL散度衡量两个模态特征在语义分布上的差异,优化跨模态语义融合的一致性。

3.2.1 跨模态几何特征迁移子模块 CGF

翻译

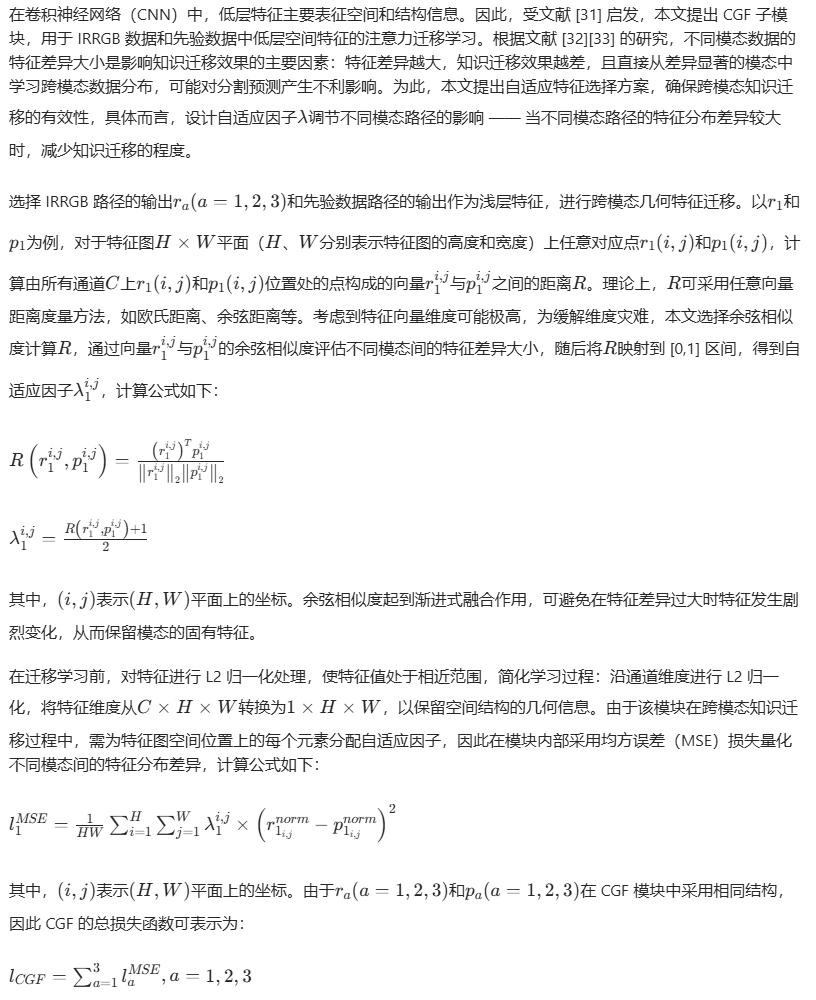

在卷积神经网络(CNN)中,低层特征主要表征空间和结构信息。因此,受文献 [31] 启发,本文提出 CGF 子模块,用于 IRRGB 数据和先验数据中低层空间特征的注意力迁移学习。根据文献 [32][33] 的研究,不同模态数据的特征差异大小是影响知识迁移效果的主要因素:特征差异越大,知识迁移效果越差,且直接从差异显著的模态中学习跨模态数据分布,可能对分割预测产生不利影响。为此,本文提出自适应特征选择方案,确保跨模态知识迁移的有效性,具体而言,设计自适应因子\(\lambda\)调节不同模态路径的影响 —— 当不同模态路径的特征分布差异较大时,减少知识迁移的程度。

选择 IRRGB 路径的输出\(r_{a}(a=1,2,3)\)和先验数据路径的输出作为浅层特征,进行跨模态几何特征迁移。以\(r_{1}\)和\(p_{1}\)为例,对于特征图\(H×W\)平面(H、W分别表示特征图的高度和宽度)上任意对应点\(r_{1}(i,j)\)和\(p_{1}(i,j)\),计算由所有通道C上\(r_{1}(i,j)\)和\(p_{1}(i,j)\)位置处的点构成的向量\(r_{1}^{i,j}\)与\(p_{1}^{i,j}\)之间的距离R。理论上,R可采用任意向量距离度量方法,如欧氏距离、余弦距离等。考虑到特征向量维度可能极高,为缓解维度灾难,本文选择余弦相似度计算R,通过向量\(r_{1}^{i,j}\)与\(p_{1}^{i,j}\)的余弦相似度评估不同模态间的特征差异大小,随后将R映射到 [0,1] 区间,得到自适应因子\(\lambda_{1}^{i,j}\),计算公式如下:

\(R\left(r_{1}^{i, j}, p_{1}^{i, j}\right)=\frac{\left(r_{1}^{i, j}\right)^{T} p_{1}^{i, j}}{\left\| r_{1}^{i, j}\right\| _{2}\left\| p_{1}^{i, j}\right\| _{2}}\)

\(\lambda_{1}^{i, j}=\frac{R\left(r_{1}^{i, j}, p_{1}^{i, j}\right)+1}{2}\)

其中,\((i,j)\)表示\((H,W)\)平面上的坐标。余弦相似度起到渐进式融合作用,可避免在特征差异过大时特征发生剧烈变化,从而保留模态的固有特征。

在迁移学习前,对特征进行 L2 归一化处理,使特征值处于相近范围,简化学习过程:沿通道维度进行 L2 归一化,将特征维度从\(C×H×W\)转换为\(1×H×W\),以保留空间结构的几何信息。由于该模块在跨模态知识迁移过程中,需为特征图空间位置上的每个元素分配自适应因子,因此在模块内部采用均方误差(MSE)损失量化不同模态间的特征分布差异,计算公式如下:

\(l_{1}^{M S E}=\frac{1}{H W} \sum_{i=1}^{H} \sum_{j=1}^{W} \lambda_{1}^{i, j} \times\left(r_{1_{i, j}}^{norm }-p_{1_{i, j}}^{norm }\right)^{2}\)

其中,\((i,j)\)表示\((H,W)\)平面上的坐标。由于\(r_{a}(a=1,2,3)\)和\(p_{a}(a=1,2,3)\)在 CGF 模块中采用相同结构,因此 CGF 的总损失函数可表示为:

\(l_{C G F}=\sum_{a=1}^{3} l_{a}^{M S E}, a=1,2,3\)

3.2.2 跨模态语义特征迁移子模块 CSF

翻译

CSF 子模块侧重于高层语义信息的迁移,选择 IRRGB 路径的输出\(r_{a}(a=3,4,5)\)和先验数据路径的输出作为深层特征,进行跨模态语义信息迁移。以\(r_{3}\)和\(p_{3}\)为例,计算\(r_{3}\)和\(p_{3}\)的特征图\(F_{r_{3}}\)和\(F_{p_{3}}\)在通道\(C_{i}\)(\(i\in C\))上的余弦相似度\(R(F_{r_{3}}^{i},F_{p_{3}}^{i})\),随后将\(R(F_{r_{3}}^{i},F_{p_{3}}^{i})\)映射到 [0,1] 区间,得到自适应因子\(\beta_{3}^{i}\),计算公式如下:

\(\beta_{3}^{i}=\left(\frac{\left(F_{r_{3}}^{i}\right)^{T} F_{p_{3}}^{i}}{\left\| F_{r_{3}}^{i}\right\| _{2}\left\| F_{p_{3}}^{i}\right\| _{2}}+1\right) / 2\)

其中,\(C_{i}\)表示通道集合C中的任意通道。通过计算\(r_{3}\)和\(p_{3}\)上所有对应通道特征图的余弦相似度,得到维度为\(C×1×1\)的通道相似度向量\(\beta_{3}^{c}\)。

同样,在空间维度对\(r_{3}\)和\(p_{3}\)进行 L2 归一化处理,得到\(r_{3}^{norm}\)和\(p_{3}^{norm}\)。沿空间维度的 L2 归一化可将特征维度从\(C×H×W\)转换为\(C×1×1\),从而保留每个通道的全局语义信息。随后,采用 KL 散度损失计算\(r_{3}^{norm}\)和\(p_{3}^{norm}\)间的特征分布差异,并为每个通道分配自适应因子\(\beta_{3}^{i}\),计算公式如下:

\(I_{p_{3}, r_{3}}^{C S F}=\beta_{3}^{C} × D_{K L}\left(p_{3}^{norm } \| r_{3}^{norm }\right)\)

由于 KL 散度计算不具有对称性,还需交换r和p的位置,计算\(p_{3}^{norm}\)和\(r_{3}^{norm}\)间的 KL 散度损失:

\(I_{r_{3}, p_{3}}^{C S F}=\beta_{3}^{C} × D_{K L}\left(r_{3}^{norm } \| p_{3}^{norm }\right)\)

由于\(r_{a}(a=3,4,5)\)和\(p_{a}(a=3,4,5)\)在 CSF 模块中采用相同结构,因此 CSF 的总损失函数可表示为:

\(l_{r, p}^{C S F}=\sum_{a=3}^{5} I_{p_{a}, r_{a}}^{C S F}, a=3,4,5\)

\(l_{p, r}^{C S F}=\sum_{a=3}^{5} I_{r_{a}, p_{a}}^{C S F}, a=3,4,5\)

\(l_{C S F}=l_{r, p}^{C S F}+l_{p, r}^{C S F}\)

3.3 多模态交叉自注意力模块 CAM

翻译

本文设计多模态特征相关度融合模块,用于融合两种模态的特征并增强跨模态信息交互。如图 2(b)所示,引入高效的多模态跨自注意力机制,实现不同模态路径交互向量间的充分信息交换。为解决自注意力算法参数数量多、计算复杂的问题,该多模态跨自注意力机制采用轻量级极化自注意力机制 [34],从空间和通道两个维度建立不同模态数据间的关联特征。以 IRRGB 多光谱图像路径为例进行说明(先验数据路径结构相同):首先通过两个 1×1 卷积,从尺寸为(O_{V}^{L}\in\mathbb{R}^{C×H×W})的输入特征中提取特征,得到残差向量(V^{res})和交互向量(V^{inter})。对交互向量(V^{inter})沿通道维度进行平均池化,生成特征向量(U_{x}),通过投影函数(\theta(\cdot))调整(U_{x})的维度,随后采用 Softmax 激活函数得到向量(G_{c}^{r}),以增强特征激活的动态范围,计算公式如下:(G_{c}^{r}=Soft max \left(\theta\left(U_{x}\right)\right))通过投影函数(\mu(\cdot):\mathbb{R}^{C×H×W}\to\mathbb{R}^{C×HW})调整交互向量(V^{inter})的维度,得到向量(Q_{c}^{r}=\mu(V^{inter}))。先验路径采用与多光谱路径相同的网络结构,通过相同方法得到先验路径的向量(Q_{c}^{p})和(G_{c}^{p})。对特征(G_{c}^{p})和(Q_{c}^{r})进行相似度计算,得到相似度矩阵(\varphi_{1}=Q_{c}^{r}\otimes G_{c}^{p})(其中(\otimes)表示矩阵乘法),随后采用 Sigmoid 函数对(\varphi_{1})进行归一化处理,并与残差向量(V^{res})进行哈达玛积运算,得到注意力激活后的特征图(Z_{c}^{r}),计算公式如下:(Z_{c}^{r}=\left(\frac{1}{1+e^{-\varphi_{1}}}\right) \odot V^{res})其中,(Z_{c}^{r})为跨模态通道跨自注意力激活后的特征图,(\odot)表示哈达玛积运算。采用相同方法计算先验数据路径经跨模态通道跨自注意力激活后的特征(Z_{c}^{p})。随后,对特征(Z_{c}^{r})和(Z_{c}^{p})进行跨模态空间跨自注意力激活:首先通过 1×1 卷积,从尺寸为(Z_{c}^{r}\in\mathbb{R}^{C×H×W})的输入特征中提取特征,得到交互向量(V_{s}^{inter});对(V_{s}^{inter})沿空间维度进行全局平均池化,生成特征向量(F_{x}),以捕捉各特征层的全局特征信息;通过投影函数(\xi(\cdot))调整维度,随后采用 Softmax 激活函数得到向量(G_{s}^{r}),增强特征激活的动态范围,计算公式如下:(G_{s}^{r}=Soft max \left(\xi\left(F_{x}\right)\right))通过投影函数(\mu(\cdot))调整交互向量(V_{s}^{inter})的维度,得到向量(Q_{s}^{r}=\mu(V_{s}^{inter}))。采用相同方法得到先验路径的向量(Q_{s}^{p})和(G_{s}^{p}),随后分别对特征(Q_{s}^{r})与(G_{s}^{p})、(Q_{s}^{p})与(G_{s}^{r})进行相似度计算,得到相似度矩阵;将这些相似度矩阵转换为权重,并分别分配给(V^{res})和(I^{res}),得到跨模态空间自注意力激活后的特征(Z_{s}^{r})和(Z_{s}^{p})。最后,通过以下公式得到最终的跨模态融合特征:(O^{VI}=Concat\left(\left(Z_{s}^{r} \oplus V^{res}\right),\left(Z_{s}^{p} \oplus I^{res}\right)\right))其中,(\oplus)表示元素级加法,Concat表示拼接操作。

(b)多模态交叉自注意力模块(Multimodal cross-self-attention module,CAM)的详细架构。

多模态交叉自注意力模块CAM,核心部分可分为:跨模态通道自注意力和跨模态空间自注意力

- 输入与分支初始化模块输入两个模态的特征,分别是IRRGB遥感多光谱遥感图像以及先验数据路径(如DSM/NDWI/NDVI等),每条路径都通过残差连接(residual)和交互模块(interactive)生成两类特征向量

- 跨模态通道交叉自注意力(通道维度交互)这一阶段聚焦通道维度的跨模态关联。1)特征降维与注意力生成:对于IRRGB分支,首先对IRRGB经过交互模块处理后的特征沿通道维度平均池化,生成特征向量,然后通过投影函数调整维度后,经softmax得到通道注意力向量,通过投影函数对经过交互模块处理后的特征进行维度调整,得到特征向量;2)先验分支的通道注意力生成:采用同样流程;3)跨模态相似度计算与特征加权:对于IRRGB分支,用先验分支中处理得到的一个特征向量(经过池化与投影函数处理的)与IRRGB分支中的一个特征向量(经过交互模块-投影函数处理的)进行矩阵乘法操作,得到相似矩阵,经过sigmod归一化后,与残差向量(经过残差模块处理的)进行哈达玛积,得到通道注意力激活后的特征,同理,在先验分支也得到一个通道注意力激活后的特征。

- 跨模态空间交叉自注意力(空间维度交互)这一阶段聚焦空间维度的跨模态关联。1)特征降维与注意力生成:对通道注意力激活后的特征经过1×1卷积得到交互向量,然后沿空间维度全局平均池化,得到特征向量,通过投影函数调整经全局平均池化后的特征的维度后,再次经过softmax函数得到空间注意力向量,另一分支通过投影函数对经过经过交互模块后的特征进行维度调整,得到特征向量;2)先验分支的空间注意力生成:先验分支采用相同流程,生成同样经过投影函数之后的特征;3)跨模态相似度计算与特征加权:与跨模态通道跨自注意力中的类似,最终得到空间注意力激活后的特征。

- 最终跨模态融合的特征输出将空间注意力激活后的特征与残差向量元素级加法,再通过通道拼接,得到最终的跨模态融合特征。

3.4 边界优化算法

翻译

相较于在特征图中学习边缘特征,分割图包含更丰富的边缘特征信息,可直接在分割预测图中进行边缘细化。因此,在模型中加入独立的边缘损失计算。如图 2(a)所示,边界优化模块由标准交叉熵损失函数\(l_{seg}\)[43] 和边缘优化损失函数\(l_{edge}\)[35] 组成,总损失函数如下:

\(l_{BOA}=l_{seg}(g,y)+l_{edge}(g_{edge},y_{edge})\)

其中,g表示真实标签,y表示预测结果。采用拉普拉斯算子从语义分割真实标签中生成边界标签\(g_{edge}\);同样,在分割网络顶部加入基于拉普拉斯算子的简单边缘提取器,直接提取梯度信息\(y_{edge}\)。为降低计算负担,将梯度信息图转换为单边缘概率图。

训练过程中,从\(d_{3}\)、\(d_{4}\)和\(d_{5}\)分别得到尺寸为 64×64、128×128 和 256×256 的预测图,记为\(y_{3}\)、\(y_{4}\)和\(y_{5}\);对应的真实标签记为\(g_{3}\)、\(g_{4}\)和\(g_{5}\)。测试过程中,仅使用最后一层输出\(y_{5}\)作为模型的预测结果。边界优化的总损失函数如下:

\(l_{BOA}=l_{seg}(g_{3},y_{3})+l_{seg}(g_{4},y_{4})+l_{seg}(g_{5},y_{5})+l_{edge}(g_{edge3},y_{edge3})+l_{edge}(g_{edge4},y_{edge4})+l_{edge}(g_{edge5},y_{edge5})\)

MCKTNet 的总损失函数为:

\(l=l_{CGF}+l_{CSF}+l_{BOA}\)

4 实验对比与讨论

翻译

本节通过不同数据源组合,分别对水体、植被、建筑物三类目标进行遥感图像语义分割实验;对所提方法的各模块进行消融实验;最后通过与其他方法的对比,进一步验证所提方法的有效性与泛化能力。

4.1 数据集

4.1.1 ISPRS Potsdam 数据集与 Vaihingen 数据集

翻译

Potsdam 数据集包含 38 幅高分辨率航空遥感图像及其对应的数字表面模型(DSM),随机选取 24 幅作为训练集,剩余作为测试集。图像与 DSM 的空间分辨率均为 5cm,尺寸为 6000×6000 像素。Vaihingen 数据集包含 33 幅高分辨率航空遥感图像及其对应的 DSM,高分辨率图像包含红(R)、绿(G)、蓝(B)、近红外(NIR)四个波段,原始标注数据涵盖 6 个主要土地覆盖类别。在本研究中,将建筑物定义为前景,其他目标定义为背景。

1、Potsdam 数据集包含 38 幅高分辨率航空遥感图像及其对应的数字表面模型(DSM),随机选取 24 幅作为训练集,剩余作为测试集。

2、Vaihingen 数据集包含 33 幅高分辨率航空遥感图像及其对应的 DSM。

4.1.2 GID 数据集

翻译

高分图像数据集(GID)是开源卫星遥感数据集,包含 10 幅精细标注的土地覆盖图像和 150 幅粗略标注的土地覆盖图像。所有图像均由高分二号(GF-2)卫星拍摄,像素分辨率为 4 米,每幅图像包含 R、G、B、NIR 四个波段。通过波段计算得到与 IRRGB 图像对应的 NDWI 和 NDVI 数据。选取 150 幅大尺寸图像验证所提方法,其中 80 幅多光谱图像(IRRGB)及其对应的归一化指数数据(NDVI、NDWI)作为训练集,剩余 70 幅作为测试集。

在水体检测实验中,对原始数据集重新定义:将河流、湖泊、池塘归为水体类,其他类别归为背景类,并与 NDWI 结合构建多模态 GID(水体)数据集;在植被检测实验中,将森林、草地、旱地归为植被类,其他类别归为背景类,并与 NDVI 结合构建多模态 GID(植被)数据集。

1、GID数据集包含 10 幅精细标注的土地覆盖图像和 150 幅粗略标注的土地覆盖图像。

2、每幅图像包含 R、G、B、NIR 四个波段。通过波段计算得到与 IRRGB 图像对应的 NDWI 和 NDVI 数据。

3、选取 150 幅大尺寸图像验证所提方法,其中 80 幅多光谱图像(IRRGB)及其对应的归一化指数数据(NDVI、NDWI)作为训练集,剩余 70 幅作为测试集。

4.2 实验细节

翻译

基于 PyTorch 框架实现并训练 MCKTNet,采用 Adam 优化器,训练阶段学习率设置为1×e的-5次方MobileNetV2 [30] 骨干网络使用 ImageNet 数据集上的预训练权重初始化,其他部分采用随机初始化。

1、框架基于PyTorch,采用Adam优化器,骨干网络MobileNetV2使用ImageNet数据集上的预训练权重初始化,其他部分采用随机初始化。

4.3 评价指标

翻译

采用总体准确率(OA)、F1 分数(F1)、平均交并比(mIoU)三个指标评价实验结果,计算公式如下:

\(OA=\frac{\sum_{k=1}^{N} TP_{k}}{\sum_{k=1}^{N} (TP_{k}+FP_{k}+TN_{k}+FN_{k})}\)

\(Precision_{k}=\frac{TP_{k}}{TP_{k}+FP_{k}}\)

\(Recall_{k}=\frac{TP_{k}}{TP_{k}+FN_{k}}\)

\(F1Score_{k}=\frac{2\times(Precision_{k}\times Recall_{k})}{Precision_{k}+Recall_{k}}\)

\(mIoU=\frac{1}{N}\sum_{k=1}^{N}\frac{TP_{k}}{TP_{k}+FP_{k}+FN_{k}}\)

其中,\(TP_{k}\)、\(FP_{k}\)、\(TN_{k}\)、\(FN_{k}\)分别表示第k类目标的真阳性、假阳性、真阴性、假阴性样本数量,N表示类别总数。

1、采用总体准确率(OA)、F1 分数(F1)、平均交并比(mIoU)三个指标评价实验结果。

4.4 消融试验

翻译

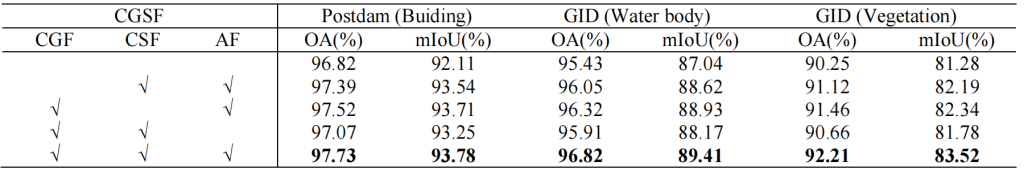

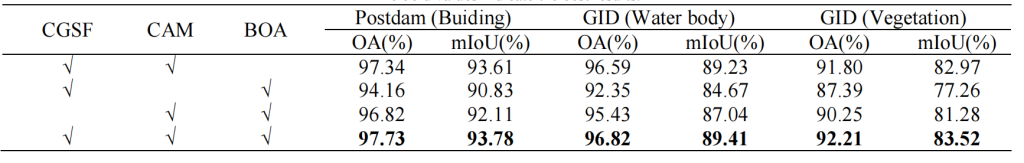

通过消融实验验证 MCKTNet 关键组件的有效性,表 1 至表 6 详细记录了实验过程与结果。表中 “√” 表示保留对应模块,无 “√” 表示移除该模块;除模块有无差异外,损失函数、优化器等其他设置均与完整 MCKTNet 保持一致。

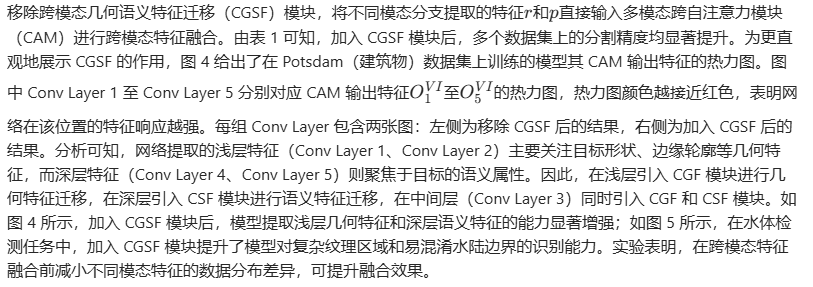

4.4.1 CGSF 模块的有效性

翻译

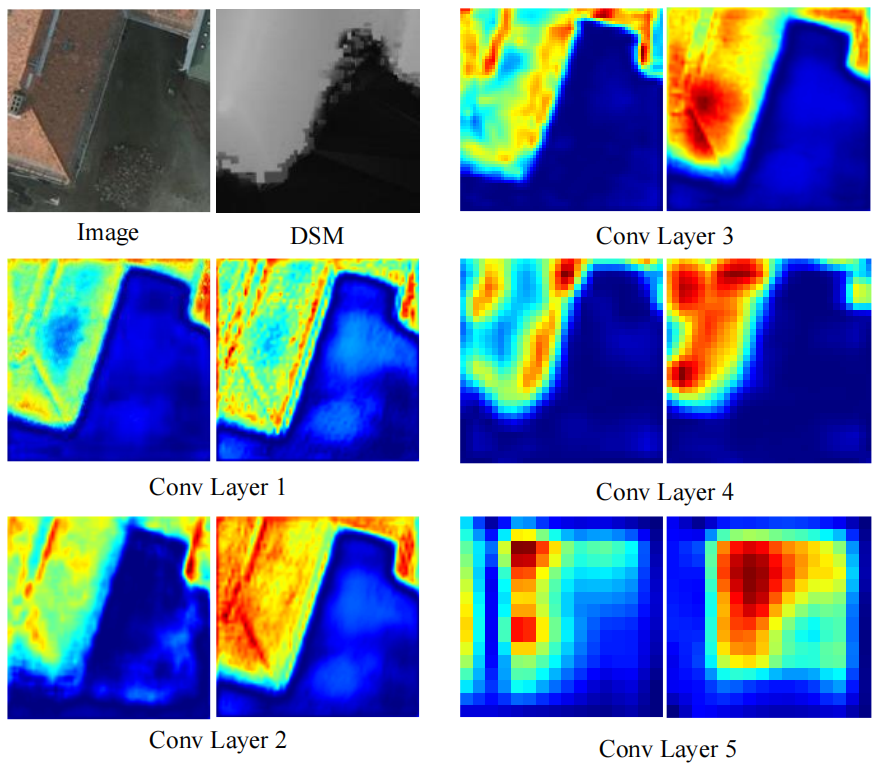

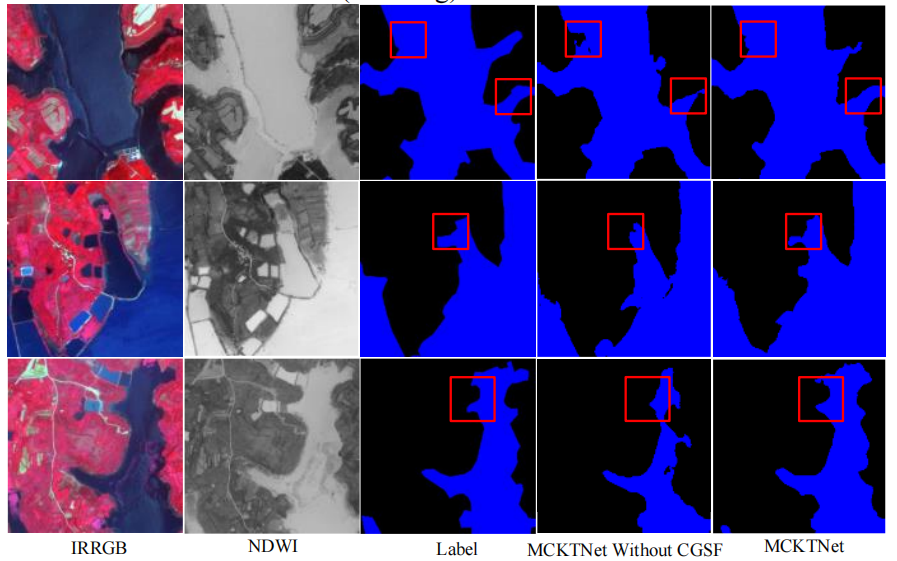

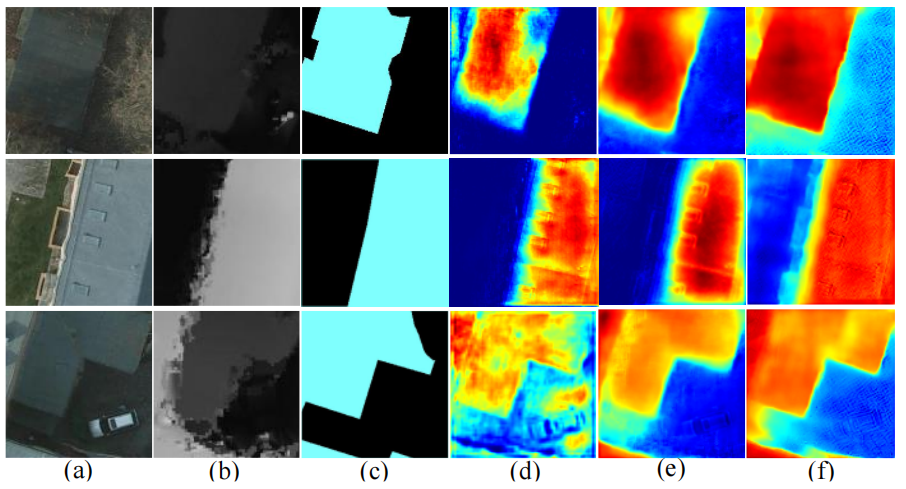

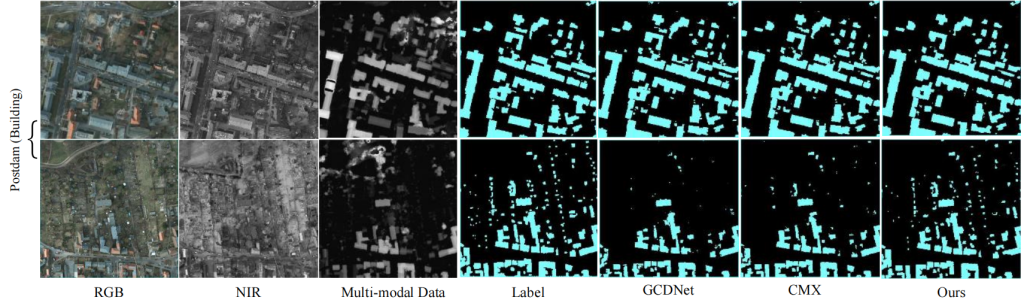

移除跨模态几何语义特征迁移(CGSF)模块,将不同模态分支提取的特征r和p直接输入多模态跨自注意力模块(CAM)进行跨模态特征融合。由表 1 可知,加入 CGSF 模块后,多个数据集上的分割精度均显著提升。为更直观地展示 CGSF 的作用,图 4 给出了在 Potsdam(建筑物)数据集上训练的模型其 CAM 输出特征的热力图。图中 Conv Layer 1 至 Conv Layer 5 分别对应 CAM 输出特征\(O_{1}^{VI}\)至\(O_{5}^{VI}\)的热力图,热力图颜色越接近红色,表明网络在该位置的特征响应越强。每组 Conv Layer 包含两张图:左侧为移除 CGSF 后的结果,右侧为加入 CGSF 后的结果。分析可知,网络提取的浅层特征(Conv Layer 1、Conv Layer 2)主要关注目标形状、边缘轮廓等几何特征,而深层特征(Conv Layer 4、Conv Layer 5)则聚焦于目标的语义属性。因此,在浅层引入 CGF 模块进行几何特征迁移,在深层引入 CSF 模块进行语义特征迁移,在中间层(Conv Layer 3)同时引入 CGF 和 CSF 模块。如图 4 所示,加入 CGSF 模块后,模型提取浅层几何特征和深层语义特征的能力显著增强;如图 5 所示,在水体检测任务中,加入 CGSF 模块提升了模型对复杂纹理区域和易混淆水陆边界的识别能力。实验表明,在跨模态特征融合前减小不同模态特征的数据分布差异,可提升融合效果。

表 1:考虑 MCKTNet 不同模块的消融实验结果。粗体数值代表最优结果

图 4:在 Potsdam(建筑物)数据集上训练的模型其跨自注意力模块(CAM)输出特征的热力图

图 5:MCKTNet 与不含 CGSF 模块的 MCKTNet 在 GID(水体)数据集上的语义分割结果对比

4.4.2 移除CGF模块的实验

翻译

为验证跨模态几何特征迁移的有效性,将网络浅层的跨模态几何特征迁移(CGF)模块替换为跨模态语义特征迁移(CSF)模块,使整个网络采用统一的 CSF 模块进行跨模态数据分布学习。由表 1 可知,移除 CGF 模块后,模型分割精度下降,证明在网络浅层进行几何特征迁移更合适。

4.4.3 移除CSF模块的实验

翻译

类似地,将网络深层的 CSF 模块替换为 CGF 模块,使整个网络采用统一的 CGF 模块进行跨模态数据分布学习。由表 1 可知,移除 CSF 模块后,模型分割精度下降,表明在网络深层进行语义特征迁移更合适。

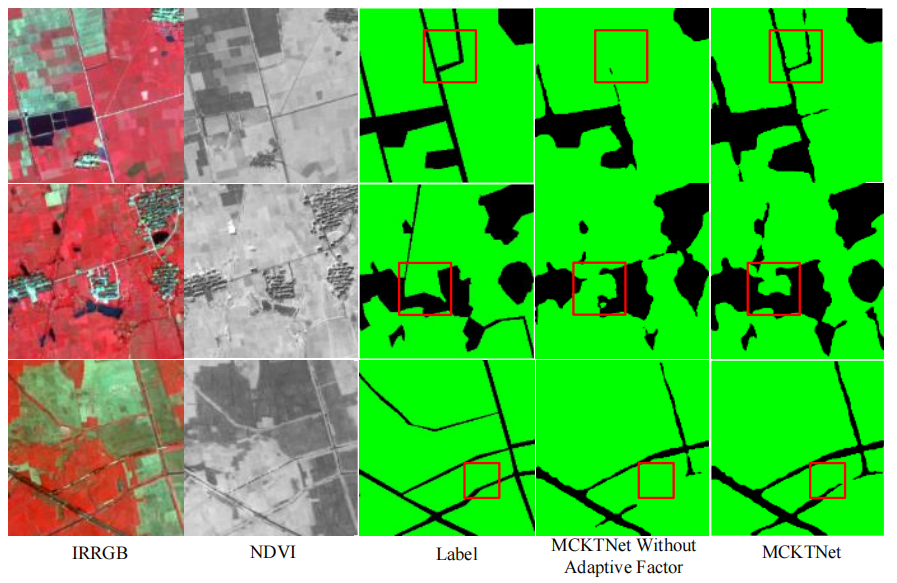

4.4.4 移除自适应因子(AF)的实验

翻译

为验证 CGSF 模块中自适应因子(AF)的有效性,测试了不含 AF 的模型性能。如图 6 所示,加入 AF 后,模型对细节特征的识别能力显著增强,这表明在跨模态特征迁移过程中,AF 可有效缓解不同数据源因数据分布差异大而导致的知识冗余和固有特征丢失问题。AF 起到 “控制器” 作用,实现跨模态知识的渐进式迁移,有助于保留不同数据源的细节特征。由表 1 可知,加入 AF 后,模型的语义分割性能得到有效提升。

图 6:MCKTNet 与不含自适应因子(AF)的 MCKTNet 在 GID(植被)数据集上的语义分割结果对比

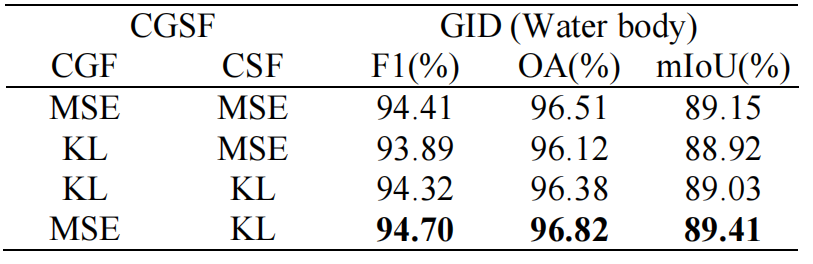

4.4.5 特征分布损失的选择

翻译

均方误差(MSE)损失和 KL 散度损失均可实现跨模态知识迁移。通过在 CGF 模块和 CSF 模块中使用不同损失函数,确定各模块最适合的跨模态特征分布损失计算方法。以表 2 中的水体检测任务为例,CGF 模块使用 MSE 损失比使用 KL 损失的 mIoU 提升 0.38%;CSF 模块使用 KL 损失比使用 MSE 损失的 mIoU 提升 0.26%。MSE 损失与 KL 散度损失在跨模态知识迁移中特征迁移能力的差异在于:MSE 损失通过最小化预测值与真实值的平方误差,更关注数值准确性和局部细节,适合迁移几何等浅层特征;而 KL 散度损失通过衡量两个概率分布间的距离,强调分布的整体相似性和结构,能捕捉数据中的深层语义信息,因此更适合迁移语义等深层特征。

表 2:不同特征分布损失的消融实验结果。粗体数值代表最优结果

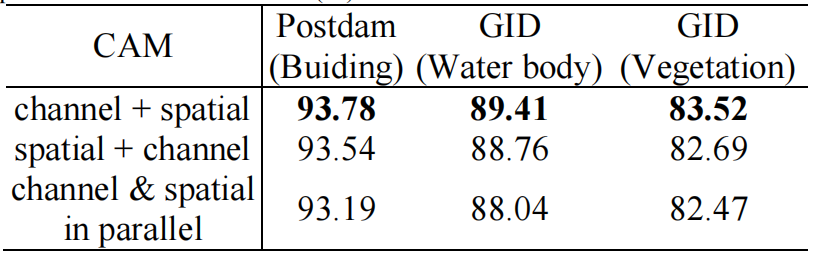

4.4.6 CAM模块的有效性

翻译

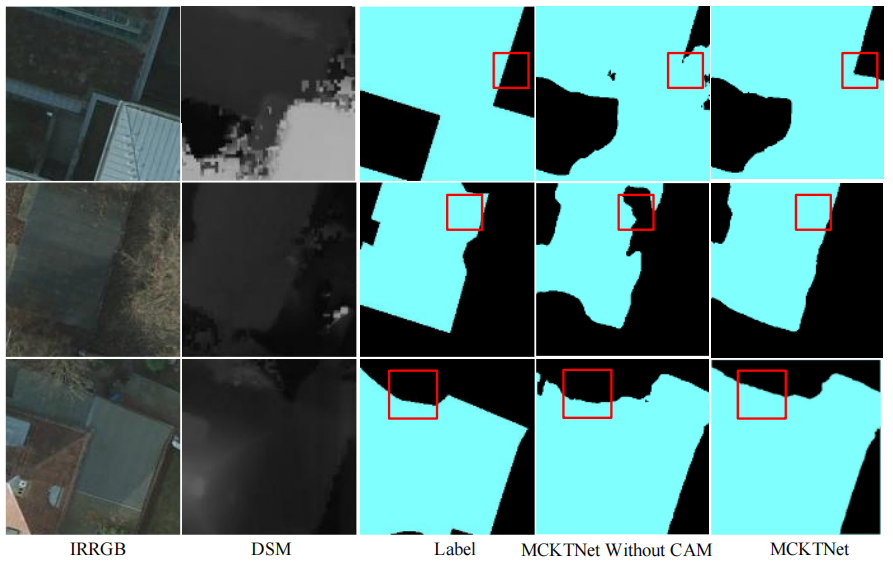

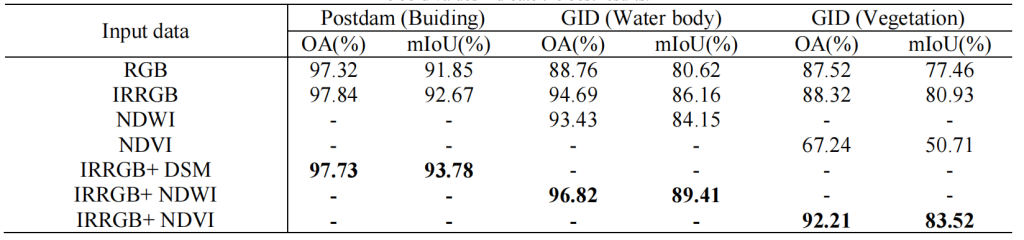

为验证 CAM 模块的有效性,测试了不使用 CAM、直接拼接不同模态分支提取特征进行融合的模型。为更直观展示不同模块的有效性,图 7 可视化了建筑物检测实验中模型最终输出层d5生成的特征热力图:图 7(d)为不含 CAM 模块的热力图,图 7(f)为含 CAM 模块的 MCKTNet 热力图。结果显示,加入 CAM 模块的模型对形态差异显著的建筑物目标具有更强且更均衡的响应。如图 8 所示,在建筑物分割实验中,加入 CAM 模块提升了模型对易混淆目标的识别能力,尤其缓解了树木遮挡问题,增强了模型抗干扰能力。由表 3 可知,不使用 CAM 模块会导致语义分割精度显著下降,这表明仅靠跨模态特征迁移不足以实现有效的多模态特征融合 ——CGSF 模块虽能减小数据分布差异以实现多模态数据融合,但无法有效识别不同模态间的互补特征。此外,表 3 还表明,跨模态特征迁移是多模态特征融合前的有效预处理步骤,因为模态间分布差异越小,跨模态数据融合的难度越低。

CAM 模块从通道和空间两个维度建立不同模态间的关联,由于各子模块功能不同,通道注意力子模块与空间注意力子模块的顺序会影响整体性能。本文对比了三种子模块排列方式:通道 – 空间顺序、空间 – 通道顺序、通道与空间注意力模块并行使用。表 4 总结了三种方式在三个数据集上的 mIoU 值,结果显示通道 – 空间顺序排列的性能略优于其他两种。从特征角度看,通道注意力强调全局语义特征,空间注意力聚焦局部细节,因此先通过通道注意力筛选重要全局语义特征,再通过空间注意力在更精细层面聚焦局部区域,符合人类视觉系统从整体到细节的渐进式关注过程,这种逐步细化的方式可有效提升特征的表示能力。

图 7:在 Potsdam(建筑物)数据集上训练的模型特征热力图可视化

(a)表示输入图像(IRRGB 多光谱图像),(b)表示输入的 DSM 数据(数字表面模型),(c)表示真实标签,(d)表示不含 CAM 模块的模型,(e)表示不含 BOA 模块的模型,(f)表示同时包含 CAM 和 BOA 模块的完整 MCKTNet。

表 3:考虑 MCKTNet 三个核心模块的消融实验结果。粗体数值数值代表最优结果

表 4:通道注意力与空间注意力子模块不同组合的平均交并比(mIoU)对比(单位:%)

粗体数值代表最优结果

图 8:MCKTNet 与不含 CAM 模块的 MCKTNet 在 Potsdam(建筑物)数据集上的语义分割结果对比

4.4.7 BOA模块的有效性

翻译

为验证 BOA 模块的有效性,测试了仅使用交叉熵损失函数\(l_{seg}\)计算模型预测损失、不使用边缘优化损失函数\(l_{edge}\)的模型。图 7(e)为移除 BOA 模块后的热力图,图 7(f)为含 BOA 模块的 MCKTNet 热力图,结果显示含 BOA 模块的热力图对目标边缘区域的响应更强。由表 3 可知,在基准网络中加入 BOA 模块后,Potsdam(建筑物)数据集上的 OA 提升了 0.39%。

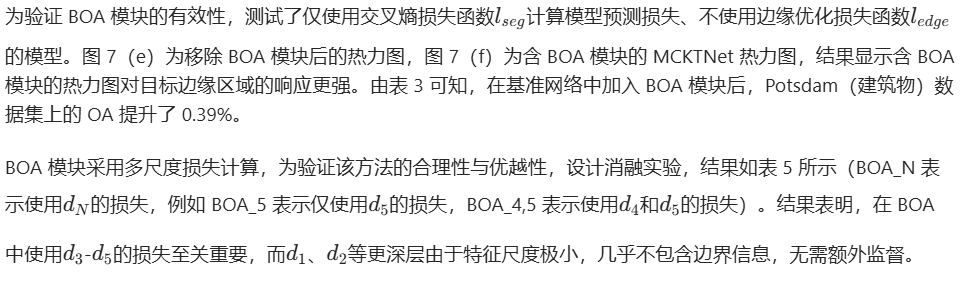

BOA 模块采用多尺度损失计算,为验证该方法的合理性与优越性,设计消融实验,结果如表 5 所示(BOA_N 表示使用\(d_N\)的损失,例如 BOA_5 表示仅使用\(d_5\)的损失,BOA_4,5 表示使用\(d_4\)和\(d_5\)的损失)。结果表明,在 BOA 中使用\(d_3\)-\(d_5\)的损失至关重要,而\(d_1\)、\(d_2\)等更深层由于特征尺度极小,几乎不包含边界信息,无需额外监督。

表 5:边缘优化(BOA)应用于不同尺度特征图的平均交并比(mIoU)对比(单位:%)

粗体数值代表最优结果

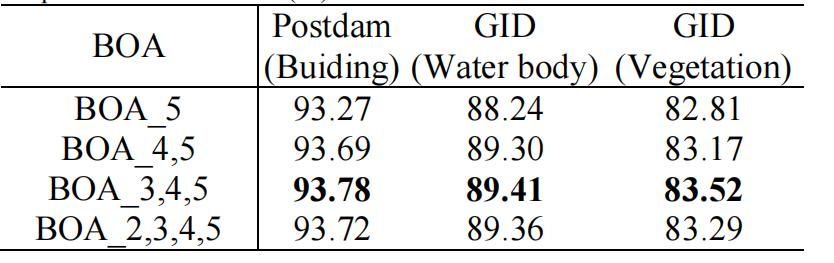

4.4.8 不同模态输入数据的影响

翻译

为验证不同模态数据对分割精度的影响,对不同模态的输入数据进行大量消融实验。由表 6 可知,在 Potsdam(建筑物)、GID(水体)、GID(植被)三个数据集上,分别使用 RGB 和 IRRGB 图像作为单一数据源进行模型训练与测试。RGB 图像包含丰富的颜色和纹理特征,但易受环境等因素影响,对易混淆目标的识别能力不足;与 RGB 数据相比,IRRGB 数据增加了近红外波段,提升了模型对不同地物的识别能力,三个数据集的 mIoU 分别提升 0.82%、5.54%、3.47%。NDWI 和 NDVI 数据分别能突出水体和植被特征,基于 NDWI 和 NDVI 数据的阈值分割是水体和植被检测的常用算法,但单一 NDWI 或 NDVI 数据无法获取目标的纹理特征和语义信息,且对算法参数设置依赖性强,稳健性不足。如图 9 所示,基于 NDVI 数据阈值分割的植被检测方法虽能识别较小植被区域,但无法有效检测发黄植被;基于 RGB 图像的植被分割方法难以识别空间细节特征,分割结果边缘模糊。本文方法通过融合不同模态数据,充分利用各模态优势,提升了语义分割精度。

表 6:使用不同模态输入数据的消融实验对比结果。粗体数值代表最优结果

图 9:使用不同模态数据的植被检测结果

4.5 与现有方法的定量对比

翻译

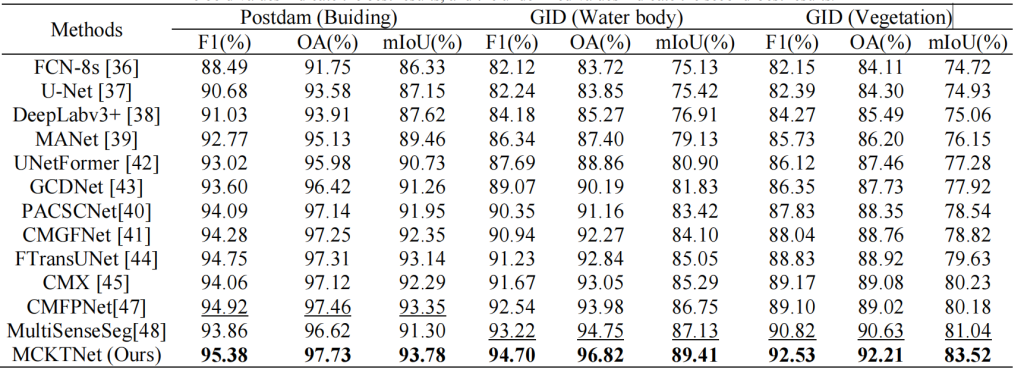

将本文方法与当前最优语义分割方法进行对比,包括 FCN [36]、U-Net [37]、Deeplabv3+[38] 等经典多尺度上下文特征融合方法,以及 MANet [39]、UNetFormer [42]、CMTFNet [46]、GCDNet [43] 等基于 Transformer 进行全局特征提取的先进遥感图像分割方法(这些方法仅使用 RGB 图像信息,可用于体现多模态先验数据带来的性能提升);此外,还与 PACSCNet [40]、CMGFNet [41]、FTransUNet [34]、CMX [45]、CMFPNet [47]、MultiSenseSeg [48] 等当前最优多模态特征融合网络进行对比。测试结果如表 7 所示。

UNetFormer 采用轻量级 ResNet18 编码器和基于 Transformer 的解码器,建立长距离依赖关系,提升全局与局部信息的利用率;CMGFNet 采用端到端跨模态门控融合和多层次特征融合技术,提升从超高分辨率遥感图像和 DSM 数据中提取建筑物轮廓的能力;PACSCNet 利用双金字塔对称级联解码器和多尺度特征提取模块,通过有效利用多模态上下文特征提升分割精度;CMFPNet 采用两个独立特征提取分支,从不同遥感图像模态中提取近海养殖区的语义信息,并设计局部 – 全局特征聚合块(LGPB)捕捉局部和全局特征信息,增强模型在复杂多变背景干扰下的识别能力;为解决多模态语义分割模型参数多、计算成本高的问题,MultiSenseSeg 采用多个轻量级模态专用专家网络(MSEs)、自适应多模态匹配(AMM)模块和单一特征提取管道,高效建模模态内和模态间关系。

由表 7 可知,在 ISPRS Potsdam(建筑物)、GID(水体)、GID(植被)三个数据集上,MCKTNet 的各项指标均显著优于其他网络,F1、OA、mIoU 均达到最高值。其中,在 Potsdam(建筑物)数据集上,MCKTNet 的 F1 为 95.38%、OA 为 97.73%、mIoU 为 93.78%;在 GID(水体)数据集上,F1 为 94.70%、OA 为 96.82%、mIoU 为 89.41%;在 GID(植被)数据集上,F1 为 92.53%、OA 为 92.21%、mIoU 为 83.52%。从测试指标可以看出,MCKTNet 在不同语义分割任务中均实现最高分割精度,表明该方法不仅能从多模态特征中有效提取互补信息,还具有较强的泛化能力。

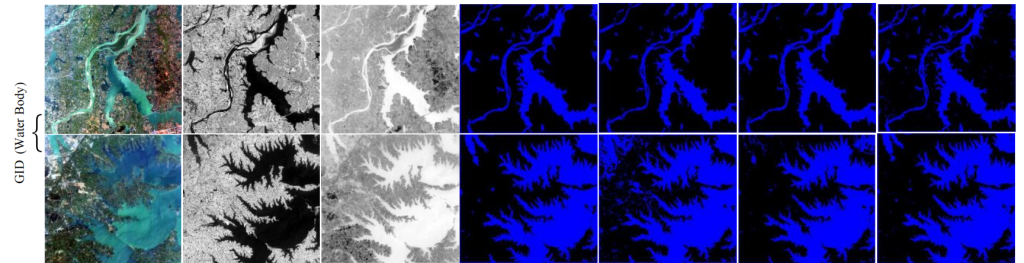

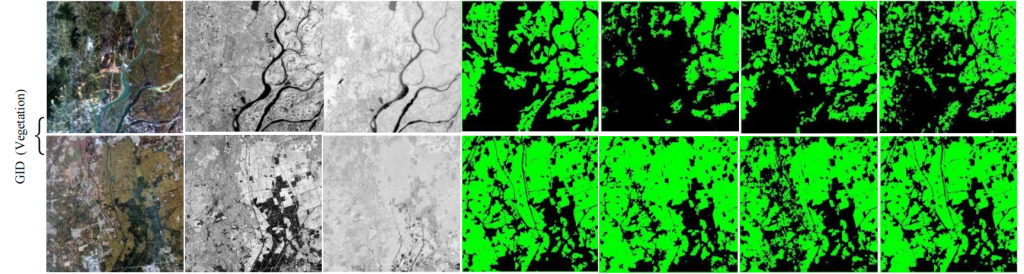

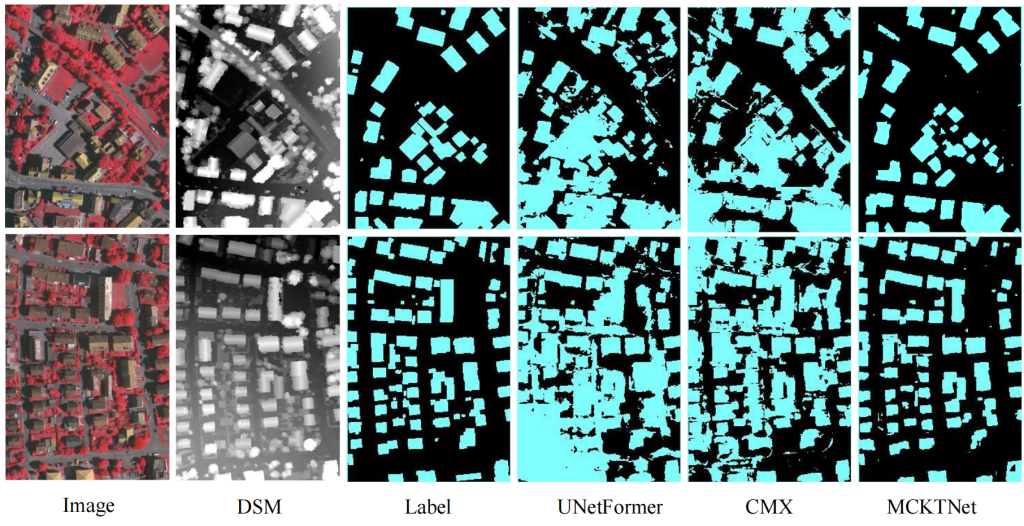

图 10 展示了 MCKTNet 与当前最优单模态遥感图像语义分割网络(GCDNet)、当前最优多模态遥感图像语义分割网络(CMX)的实验结果对比。在分割性能方面,MCKTNet 对稻田与旱地、不同颜色河流等易混淆目标具有较强的识别能力,能有效分割隐藏在森林中的小型建筑物等小目标,且对目标复杂边缘轮廓的分割效果优异。

实验结果表明,MCKTNet 在有效提取图像复杂特征、精准识别目标位置与边界、泛化能力等方面均优于其他模型,成功缓解了噪声干扰、不同模态数据细节特征丢失导致的目标定位不准确和边界像素分割误差问题,解决了多模态遥感图像语义分割任务中模型稳健性不足的问题。该方法在不同数据集上均表现出色,分割结果优于其他网络。

表 7:在 Potsdam(建筑物)数据集、GID(水体)数据集与 GID(植被)数据集上的实验结果

粗体数值代表最优结果,下划线数值代表次优结果

图 10:不同方法的完整分割结果

前两行是 GID(水体)数据集的测试结果,使用的多模态数据为 NDWI;中间两行是 GID(植被)数据集的测试结果,使用的多模态数据为 NDVI;最后两行是 Potsdam(建筑物)数据集的测试结果,使用的多模态数据为 DSM。

4.6 模型参数与计算复杂度分析

翻译

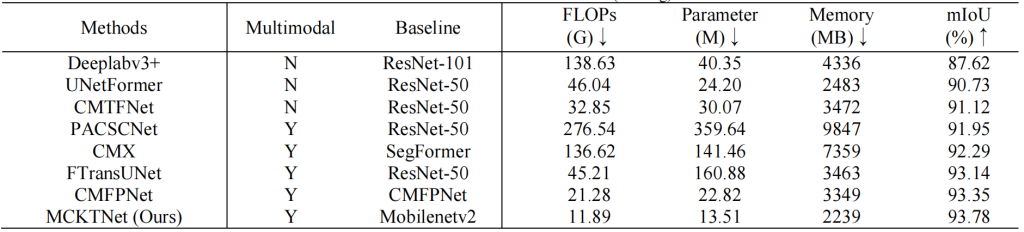

采用浮点运算次数(FLOP)、模型参数数量、内存占用三个指标评估 MCKTNet 的计算复杂度。将 512×512 尺寸的输入数据输入所有模型,在相同运行环境下评估各方法的计算复杂度与参数规模,结果如表 8 所示。由表 8 可知,多模态模型的计算复杂度通常高于单模态模型;而 MCKTNet 的 FLOP 为 11.89G、参数数量为 13.51M、内存占用为 2239MB,远低于其他多模态融合方法,且实现了最优分割精度,充分体现了 MCKTNet 的优越性能。

表 8:在单张 NVIDIA GeForce RTX 3090Ti GPU 上对 512×512 图像的计算复杂度分析

(mIoU 值为在 ISPRS Potsdam(建筑物)数据集上的结果)

4.7 泛化能力测试

翻译

由于多光谱图像的纹理和语义特征丰富,基于其设计的目标识别算法易受不同场景和环境因素影响,在跨数据集泛化时往往表现不佳。而多模态先验数据通常强调目标的基本物理属性,受场景和环境因素影响较小,因此若模型能有效从先验数据中学习特征,可提升跨数据集泛化能力。

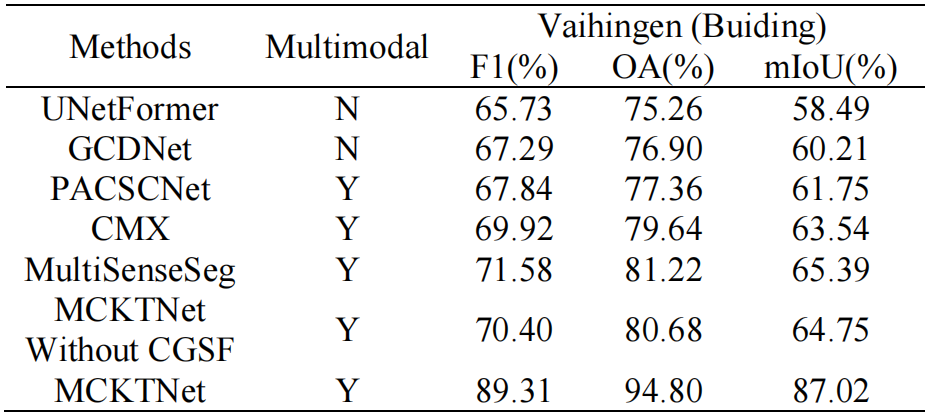

为验证 MCKTNet 的跨数据集泛化能力,在 Potsdam(建筑物)数据集上训练 MCKTNet,不进行任何调试或重训练,直接将训练得到的模型用于 Vaihingen(建筑物)数据集的零样本建筑物检测实验。如图 11 所示,MCKTNet 在零样本条件下仍能有效检测 Vaihingen(建筑物)数据集上的建筑物。表 9 表明,CGSF 模块可显著提升模型的跨模态特征学习能力;与其他当前最优语义分割算法相比,MCKTNet 具有最强的领域泛化能力。

表 9:基于 Potsdam(建筑物)数据集训练的模型在 Vaihingen(建筑物)数据集上的零样本建筑物检测结果定量对比

图 11:基于 Potsdam(建筑物)数据集训练的模型在 Vaihingen(建筑物)数据集上的零样本建筑物检测结果

5 结论

翻译

本文提出一种用于遥感图像语义分割的多尺度跨模态知识迁移网络(MCKTNet)。首先,设计跨模态知识迁移网络,实现不同模态间语义与几何特征的迁移,旨在减小模态间的特征分布差异;其次,利用跨注意力机制实现跨模态特征的互补融合;最后,为获得更精准的目标边界,设计多尺度边缘感知优化模块,可基于像素级预测结果直接细化边缘细节。该方法通过迁移学习显著减少不同模态数据间的冗余,实现语义与几何信息的双向迁移;重点在于增强骨干网络的特征表示能力,而非网络预测,方法更简洁;且无需预训练网络或组件,可实现同步双向训练。大量实验表明,MCKTNet 性能优异、稳健性强且泛化能力好,在多个遥感图像语义分割任务中均实现最优分割精度,且计算复杂度远低于其他多模态融合模型。

1、本文提出一种用于遥感图像语义分割的多尺度跨模态知识迁移网络(MCKTNet)。

2、关键设计:

- 设计跨模态知识迁移网络,实现不同模态间语义与几何特征的迁移,旨在减小模态间的特征分布差异;

- 利用跨注意力机制实现跨模态特征的互补融合;

- 为获得更精准的目标边界,设计多尺度边缘感知优化模块,可基于像素级预测结果直接细化边缘细节。